Berget AI, startup svedese specializzata in intelligenza artificiale, ha annunciato un finanziamento di 2,1 milioni di euro (24 milioni di corone svedesi). Questo investimento arriva in un momento cruciale, in cui l'AI sta diventando un'infrastruttura critica e le normative, le tensioni geopolitiche e la nuova legislazione europea sull'AI spingono la domanda di controllo locale sui dati e sui flussi di lavoro AI.

La piattaforma di Berget AI

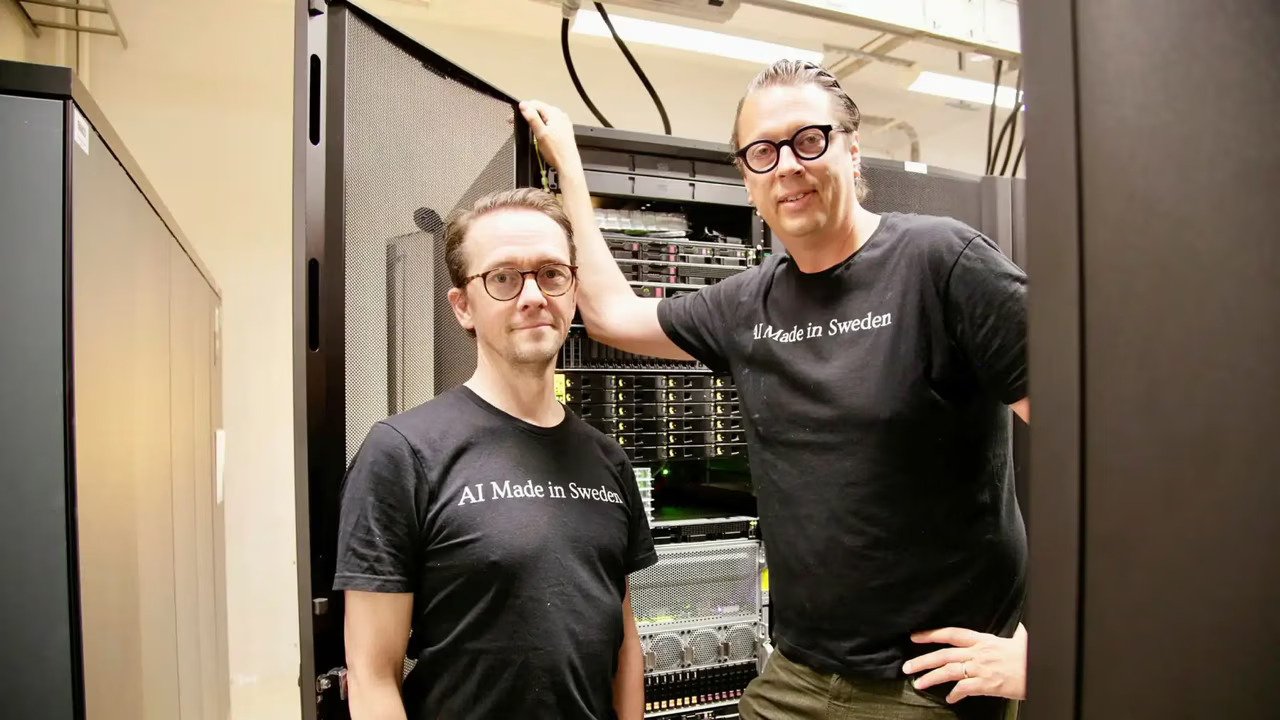

Fondata da Christian Landgren e Andreas Lundmark, Berget AI sta sviluppando un servizio che consente alle organizzazioni di sviluppare applicazioni AI utilizzando modelli linguistici open source operanti su infrastrutture sovrane in Svezia. Questo approccio garantisce che i dati sensibili non escano dai confini nazionali e rimangano sotto la giurisdizione europea.

Berget AI si rivolge agli sviluppatori che desiderano iniziare rapidamente senza doversi occupare della gestione dell'infrastruttura, offrendo un'alternativa moderna agli hyperscaler statunitensi e alle complesse soluzioni on-premise. La piattaforma full-stack combina facilità d'uso con sovranità dei dati, tecnicia aperta e operazioni sostenibili.

Sovranità dei dati e conformità normativa

Secondo Andreas Lundmark, sempre più organizzazioni non desiderano collocare dati sensibili su piattaforme cloud globali. L'azienda offre un'alternativa accessibile che fornisce il pieno controllo senza richiedere ai clienti di costruire e gestire la propria infrastruttura.

Con l'EU AI Act e requisiti più severi in materia di trasparenza, tracciabilità e governance dei dati, le condizioni per la creazione e la distribuzione dell'AI in Europa stanno cambiando. Le organizzazioni del settore pubblico e le industrie regolamentate richiedono sempre più soluzioni che mantengano dati e modelli all'interno della giurisdizione dell'UE.

Il round di finanziamento è stato guidato da Luminar Ventures, Wellstreet e Norrsken Evolve. Il capitale raccolto sarà utilizzato principalmente per accelerare lo sviluppo del prodotto e ampliare le operazioni di vendita.

Per chi valuta deployment on-premise, esistono trade-off significativi da considerare. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi aspetti.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!