ByteDance Doubao entra nel mercato degli abbonamenti AI

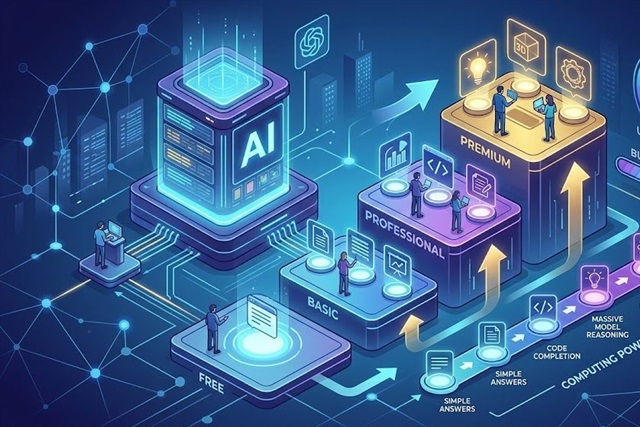

ByteDance, il gigante tecnicico dietro TikTok, sta esplorando nuove strategie per monetizzare le sue capacità di intelligenza artificiale. Con il suo modello Doubao, l'azienda ha avviato la fase di test per l'introduzione di piani di abbonamento a pagamento, un chiaro segnale della sua ambizione di competere direttamente con servizi AI già affermati, come le offerte di ChatGPT di OpenAI. Questa mossa posiziona ByteDance in un segmento di mercato in rapida crescita, dove la differenziazione e il valore aggiunto per gli utenti diventano fattori critici.

L'iniziativa di Doubao sottolinea una tendenza più ampia nel settore tech: la transizione da modelli di AI gratuiti o freemium verso servizi a pagamento. Per le aziende, questo scenario implica una valutazione più attenta delle opzioni disponibili, considerando non solo le funzionalità offerte, ma anche il modello di costo e le implicazioni a lungo termine per l'infrastruttura e la gestione dei dati.

Le implicazioni tecniche della competizione AI

Dietro ogni servizio di intelligenza artificiale, come Doubao, si cela una complessa infrastruttura hardware e software. L'espressione “Powered by AI” racchiude la necessità di risorse computazionali significative, in particolare per l'inference di Large Language Models (LLM). Questo richiede un'attenta gestione di GPU ad alte prestazioni, con ampie quantità di VRAM e un elevato throughput per elaborare milioni di token al secondo. La sfida tecnica non risiede solo nella capacità di addestrare modelli complessi, ma anche nell'ottimizzare il loro deployment per garantire bassa latenza e scalabilità, aspetti cruciali per un servizio a pagamento.

Per le aziende che considerano l'adozione di LLM, la scelta tra un servizio gestito in cloud e un deployment self-hosted on-premise è fondamentale. Le soluzioni on-premise offrono un controllo maggiore sulla sovranità dei dati e sulla compliance, aspetti particolarmente rilevanti per settori regolamentati. Tuttavia, richiedono un investimento iniziale (CapEx) in hardware e competenze, oltre a una gestione continua dell'infrastruttura. La competizione tra fornitori di servizi AI come ByteDance e OpenAI spinge verso l'innovazione anche in questi ambiti, offrendo spunti su come ottimizzare l'efficienza e il costo dell'inference su larga scala.

Modelli di business e strategie di deployment per le aziende

L'introduzione di piani di abbonamento da parte di Doubao evidenzia la crescente maturità del mercato dell'AI. Per le aziende, questo significa avere a disposizione un ventaglio più ampio di opzioni per integrare l'AI nelle proprie operazioni. La decisione di sottoscrivere un servizio cloud o di investire in un deployment on-premise dipende da una serie di fattori, tra cui il Total Cost of Ownership (TCO), i requisiti di sicurezza e privacy, e la necessità di personalizzazione del modello. I servizi in abbonamento offrono un modello di costo OpEx prevedibile e una minore complessità gestionale, ma possono comportare vincoli sulla personalizzazione e sulla localizzazione dei dati.

Al contrario, un'infrastruttura self-hosted permette un controllo granulare su ogni aspetto, dalla scelta dell'hardware (es. GPU con specifiche VRAM precise) alla configurazione del software e alla gestione della pipeline di dati. Questo approccio è spesso preferito da organizzazioni con esigenze specifiche di performance, sicurezza o compliance air-gapped. La capacità di ByteDance di offrire un servizio competitivo potrebbe anche influenzare le aspettative di prezzo e performance per le soluzioni on-premise, spingendo verso una maggiore efficienza e innovazione nell'intero ecosistema AI.

Prospettive future e decisioni strategiche per i CTO

La crescente competizione nel mercato dei servizi AI, esemplificata dalla mossa di ByteDance con Doubao, rende le decisioni strategiche per CTO e architetti dell'infrastruttura sempre più complesse. La valutazione tra l'utilizzo di un servizio AI di terze parti e lo sviluppo di capacità interne richiede un'analisi approfondita dei trade-off. Fattori come la sovranità dei dati, la conformità normativa (es. GDPR), la prevedibilità dei costi e la flessibilità architetturale sono al centro di queste scelte.

Per chi valuta deployment on-premise, esistono framework analitici che possono aiutare a quantificare il TCO e a confrontare le prestazioni di diverse configurazioni hardware e software. La capacità di un'azienda di gestire i propri LLM in un ambiente controllato può rappresentare un vantaggio competitivo significativo, soprattutto in termini di sicurezza e differenziazione del prodotto. Il mercato continuerà a evolversi rapidamente, e la capacità di adattarsi a questi cambiamenti, bilanciando innovazione e controllo, sarà cruciale per il successo a lungo termine.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!