La crescente complessità nel testing dei chip AI

Il settore dell'intelligenza artificiale sta vivendo una fase di rapida evoluzione, con una domanda sempre maggiore di potenza di calcolo. Al centro di questa rivoluzione ci sono i chip AI, componenti fondamentali per l'addestramento e l'Inference dei Large Language Models (LLM) e di altre applicazioni avanzate. Tuttavia, la produzione di questi processori non è priva di sfide. Una delle più significative, e spesso sottovalutate, è la crescente complessità del loro testing.

Questa complessità non è solo un dettaglio tecnico, ma un fattore che sta già influenzando la domanda di componenti specifici, come le "probe card", e l'intera catena di fornitura a monte. Per le aziende che valutano il Deployment di LLM on-premise, comprendere queste dinamiche è cruciale, poiché impattano direttamente sulla disponibilità, sui costi e, in ultima analisi, sul TCO dell'infrastruttura.

Dettagli tecnici e impatto sulla supply chain

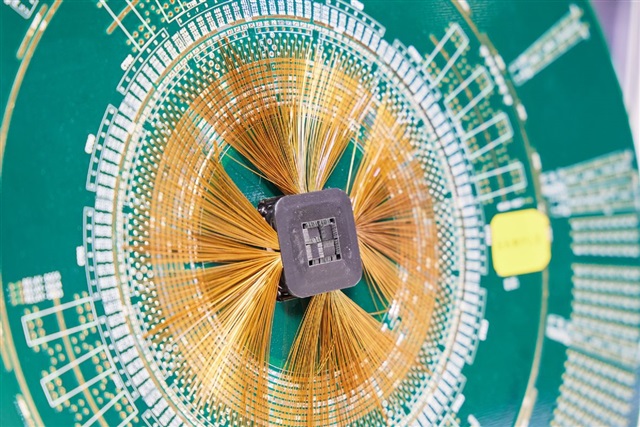

La complessità del testing dei chip AI deriva da molteplici fattori. Le architetture moderne, spesso basate su integrazione eterogenea, includono core di calcolo specializzati, memorie ad alta larghezza di banda (HBM) e interconnessioni avanzate come NVLink. Testare ogni singolo componente di questo complesso silicio e la loro interazione richiede strumenti di precisione estrema. Le "probe card" sono un esempio lampante: si tratta di interfacce critiche che collegano il chip (ancora a livello di wafer) alle apparecchiature di test, verificandone la funzionalità e le prestazioni. Con l'aumento della densità dei transistor e la miniaturizzazione, la precisione e la durata di queste card diventano requisiti sempre più stringenti.

L'impatto si estende a tutta la "upstream supply chain". Ciò include i fornitori di materiali semiconduttori, i produttori di macchinari per la litografia e il packaging, e le aziende specializzate in soluzioni di test e misurazione. La necessità di attrezzature più sofisticate e processi di produzione più rigorosi per garantire l'affidabilità dei chip AI si traduce in una maggiore domanda e, potenzialmente, in tempi di consegna più lunghi e costi più elevati per questi componenti essenziali.

Implicazioni per i deployment on-premise

Per le organizzazioni che scelgono di implementare LLM e altre soluzioni AI in ambienti self-hosted, le dinamiche della supply chain dei chip AI sono di primaria importanza. La disponibilità e il costo dell'hardware, in particolare delle GPU con VRAM elevata, sono fattori determinanti per il successo e la sostenibilità di un Deployment on-premise. Se la complessità del testing rallenta la produzione o ne aumenta i costi, le aziende potrebbero affrontare sfide significative.

Questo scenario può tradursi in un aumento del CapEx iniziale per l'acquisto di server e GPU, o in tempi di attesa prolungati per l'approvvigionamento dei componenti. La pianificazione del TCO diventa quindi ancora più complessa, richiedendo un'attenta valutazione dei rischi legati alla supply chain. La scelta del Deployment on-premise è spesso motivata da esigenze di sovranità dei dati, compliance normativa o la necessità di ambienti air-gapped, rendendo l'accesso affidabile all'hardware un vincolo non negoziabile. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off e supportare le decisioni infrastrutturali.

Prospettive e strategie per i decision-maker

Di fronte a queste sfide, i CTO, i responsabili DevOps e gli architetti infrastrutturali devono adottare un approccio strategico. Monitorare attentamente il mercato dei semiconduttori e le tendenze della supply chain diventa essenziale per anticipare potenziali interruzioni o aumenti di costo. La diversificazione dei fornitori, dove possibile, e la valutazione di architetture hardware alternative possono contribuire a mitigare i rischi.

La capacità di un'azienda di sviluppare e mantenere una solida infrastruttura AI on-premise dipenderà sempre più dalla sua comprensione delle dinamiche di produzione e testing dei chip. Investire in una pianificazione a lungo termine e in una profonda conoscenza del mercato hardware è fondamentale per garantire la resilienza e l'efficacia delle proprie strategie AI, mantenendo il controllo sui dati e sui costi operativi.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!