La Pressione sui Margini degli ODM di Server AI

La crescente domanda di intelligenza artificiale, in particolare per i carichi di lavoro intensivi legati ai Large Language Models (LLM), sta mettendo sotto pressione l'intera catena di approvvigionamento hardware. Un aspetto critico di questa dinamica di mercato, come evidenziato da DIGITIMES, riguarda l'aumento dei costi della memoria, che sta erodendo i margini degli Original Design Manufacturers (ODM) di server AI. Questa situazione non solo impatta direttamente la redditività degli ODM, ma ha anche ripercussioni significative sul mercato più ampio dell'infrastruttura AI e sulle strategie di deployment per le aziende.

Gli ODM svolgono un ruolo fondamentale nella produzione di server personalizzati per le esigenze specifiche dell'AI, spesso lavorando a stretto contatto con i fornitori di chip e i clienti finali. La loro capacità di mantenere margini sani è essenziale per l'innovazione e la stabilità della catena di fornitura. L'incremento dei costi dei componenti chiave, come la memoria, si traduce in una sfida diretta per questi attori, che devono bilanciare la competitività dei prezzi con la necessità di coprire i costi di produzione.

L'Impatto della Memoria sull'Framework AI On-Premise

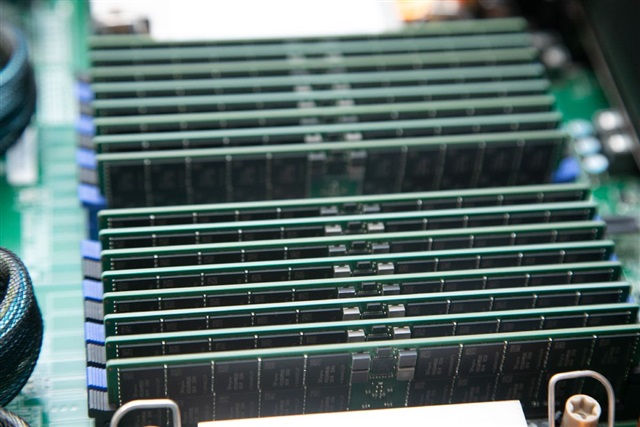

I server AI, specialmente quelli dedicati all'addestramento e all'inference di LLM, richiedono quantità significative di memoria ad alta larghezza di banda, come la VRAM presente nelle GPU di fascia alta. L'escalation dei prezzi di questi componenti essenziali si traduce direttamente in un aumento dei costi di produzione per gli ODM. Per le aziende che considerano un deployment self-hosted o on-premise di infrastrutture AI, ciò significa un CapEx iniziale più elevato per l'acquisizione dell'hardware necessario.

Questo fattore diventa cruciale nella valutazione del Total Cost of Ownership (TCO) a lungo termine. Sebbene le soluzioni on-premise possano offrire vantaggi in termini di sovranità dei dati, controllo e costi operativi prevedibili nel tempo, un aumento significativo del costo iniziale dell'hardware può alterare l'equazione economica. Le organizzazioni devono bilanciare attentamente il costo iniziale con i benefici a lungo termine, considerando anche i costi energetici, di raffreddamento e di manutenzione associati all'infrastruttura locale.

Dinamiche di Mercato e Strategie di Procurement

La pressione sui margini degli ODM può portare a diverse conseguenze per il mercato, tra cui potenziali ritardi nelle consegne di server AI o una minore flessibilità nelle configurazioni hardware offerte. Le aziende che pianificano investimenti in infrastruttura AI devono monitorare attentamente queste dinamiche di mercato per pianificare efficacemente gli acquisti e mitigare i rischi legati alla disponibilità e al costo dei componenti. La volatilità dei costi può rendere più complessa la scelta tra soluzioni cloud e on-premise, richiedendo un'analisi più approfondita dei trade-off.

La capacità di scalare l'infrastruttura, mantenere il controllo sui dati sensibili e garantire la compliance normativa sono fattori che devono essere ponderati attentamente rispetto al costo iniziale e alla disponibilità dei componenti. In un contesto di costi crescenti, l'ottimizzazione dell'utilizzo dell'hardware esistente, ad esempio attraverso tecniche di quantization per i modelli LLM o l'adozione di architetture più efficienti, diventa ancora più rilevante per massimizzare il ritorno sull'investimento.

Considerazioni Strategiche per il Deployment di LLM

Per CTO, responsabili DevOps e architetti di infrastruttura, la volatilità dei costi della memoria sottolinea l'importanza di una pianificazione strategica robusta per i deployment di LLM. Valutare alternative self-hosted richiede un'analisi approfondita del TCO, considerando non solo l'acquisto iniziale ma anche i costi operativi continui. La capacità di prevedere e gestire questi costi è fondamentale per la sostenibilità dei progetti AI.

In questo scenario, la scelta dell'hardware, la configurazione dei server e le strategie di procurement diventano decisioni critiche. AI-RADAR offre framework analitici su /llm-onpremise per aiutare le organizzazioni a valutare questi trade-off complessi, fornendo una base solida per decisioni informate sul deployment di carichi di lavoro AI/LLM che prioritizzano la sovranità dei dati, il controllo e un TCO ottimizzato. Comprendere le dinamiche della catena di approvvigionamento è un passo essenziale per costruire un'infrastruttura AI resiliente e performante.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!