La Danimarca frena lo sviluppo dei data center per l'AI

La Danimarca ha annunciato una sospensione delle nuove connessioni alla rete elettrica per i data center, un segnale chiaro delle crescenti pressioni infrastrutturali generate dall'espansione dell'intelligenza artificiale. Le richieste totali per nuove connessioni hanno raggiunto la cifra impressionante di 60 GW, mettendo in evidenza la domanda energetica senza precedenti che i moderni carichi di lavoro AI richiedono. Questa decisione posiziona la Danimarca come l'ultima nazione nordica a imporre un freno alla rapida espansione delle infrastrutture dedicate all'AI.

Il fenomeno non è isolato e riflette una tendenza più ampia in Europa e nel mondo, dove la corsa alla costruzione di data center per supportare l'addestramento e l'inference di Large Language Models (LLM) sta mettendo sotto stress le reti elettriche esistenti. La necessità di alimentare migliaia di GPU ad alte prestazioni, insieme ai relativi sistemi di raffreddamento, si traduce in un fabbisogno energetico che può superare la capacità di generazione e distribuzione locale, portando a situazioni come quella danese, dove la stabilità della rete diventa una preoccupazione primaria.

Le sfide energetiche dei carichi di lavoro AI

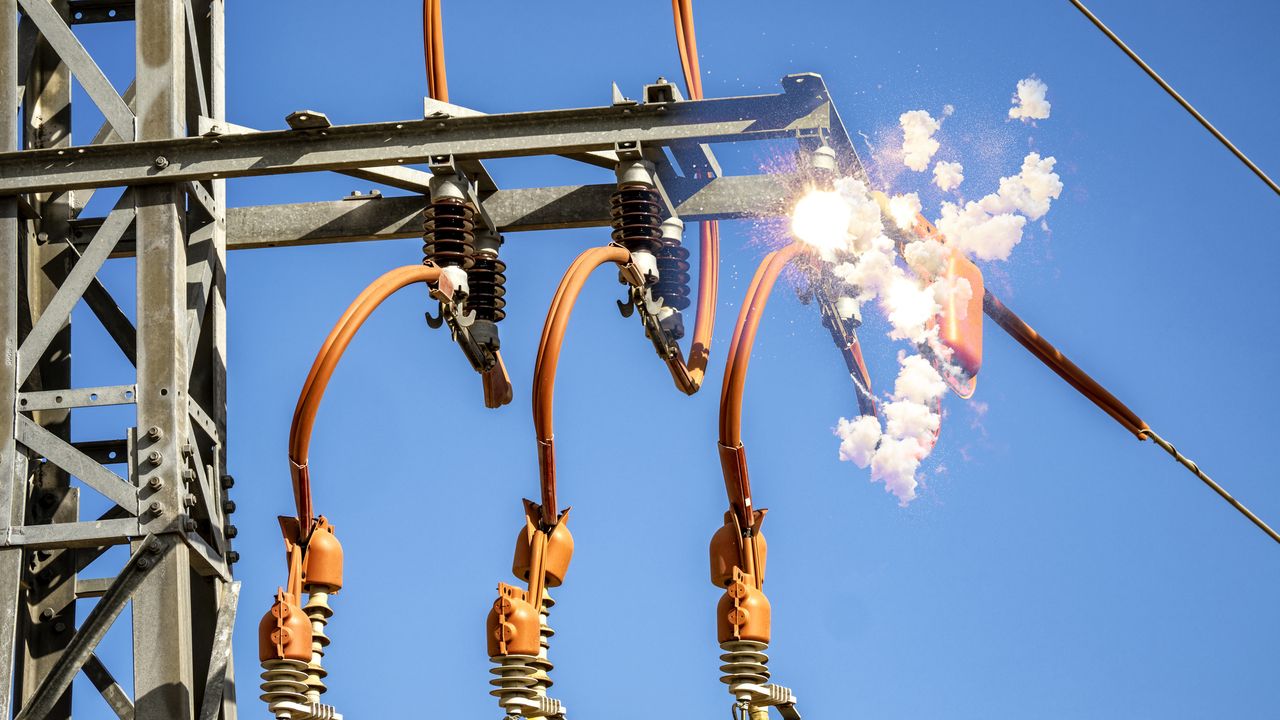

Il blocco delle connessioni in Danimarca è direttamente collegato alle problematiche di “high voltage sparking”, un'indicazione di come l'infrastruttura elettrica esistente stia lottando per gestire picchi di domanda e carichi costanti elevati. I data center moderni, in particolare quelli ottimizzati per l'AI, sono veri e propri divoratori di energia. Un singolo rack di server equipaggiato con GPU di ultima generazione, come le NVIDIA H100 o le A100, può richiedere decine di kilowatt, e un intero data center può facilmente superare i 100 MW di consumo.

Questi requisiti energetici non riguardano solo l'alimentazione diretta dei server, ma anche i sistemi ausiliari critici come il raffreddamento. L'elevata densità di calore generata dalle GPU richiede soluzioni di raffreddamento avanzate, spesso basate su liquidi, che a loro volta consumano energia significativa. Per i CTO e gli architetti di infrastruttura che valutano deployment on-premise di LLM, la disponibilità di energia affidabile e scalabile è un fattore determinante nel Total Cost of Ownership (TCO) e nella fattibilità del progetto. La pianificazione deve includere non solo l'acquisto di hardware, ma anche l'adeguamento dell'infrastruttura elettrica e di raffreddamento, spesso con costi e tempi di realizzazione considerevoli.

Implicazioni per il deployment on-premise e la sovranità dei dati

La situazione danese evidenzia un vincolo fisico che impatta direttamente le strategie di deployment, sia cloud che self-hosted. Per le aziende che considerano un deployment on-premise per ragioni di sovranità dei dati, compliance o controllo sui propri stack tecnicici, la disponibilità di potenza elettrica diventa un fattore limitante critico. La scelta di un sito per un data center locale non può più prescindere da un'analisi approfondita della capacità della rete elettrica locale e delle tempistiche per eventuali upgrade.

Questo scenario rafforza l'importanza di valutare attentamente i trade-off tra l'agilità offerta dal cloud e il controllo e la sicurezza dei deployment on-premise. Mentre il cloud può offrire una scalabilità apparentemente illimitata, anche i grandi provider devono fare i conti con le capacità infrastrutturali delle regioni in cui operano. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra CapEx, OpEx, consumo energetico e requisiti di infrastruttura, fornendo una guida per decisioni informate senza raccomandazioni dirette.

Prospettive future e pianificazione strategica

La pausa imposta dalla Danimarca è un campanello d'allarme per l'intero settore. Man mano che la domanda di capacità computazionale per l'AI continua a crescere esponenzialmente, la disponibilità di energia e la robustezza delle infrastrutture di rete diventeranno fattori sempre più critici. Le nazioni e le aziende dovranno investire massicciamente in nuove fonti di energia e nell'aggiornamento delle reti per sostenere questa crescita.

Per i decision-maker tecnicici, ciò significa che la pianificazione strategica per i carichi di lavoro AI non può limitarsi alla selezione di LLM o GPU, ma deve estendersi all'analisi approfondita dell'infrastruttura fisica sottostante. La capacità di un'azienda di implementare e scalare soluzioni AI dipenderà sempre più dalla sua capacità di accedere a risorse energetiche adeguate e di gestire i costi e le complessità associate. La sostenibilità a lungo termine dell'espansione dell'AI richiederà un approccio olistico che integri innovazione tecnicica e sviluppo infrastrutturale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!