GPT-5.3 velocizzato da Cerebras

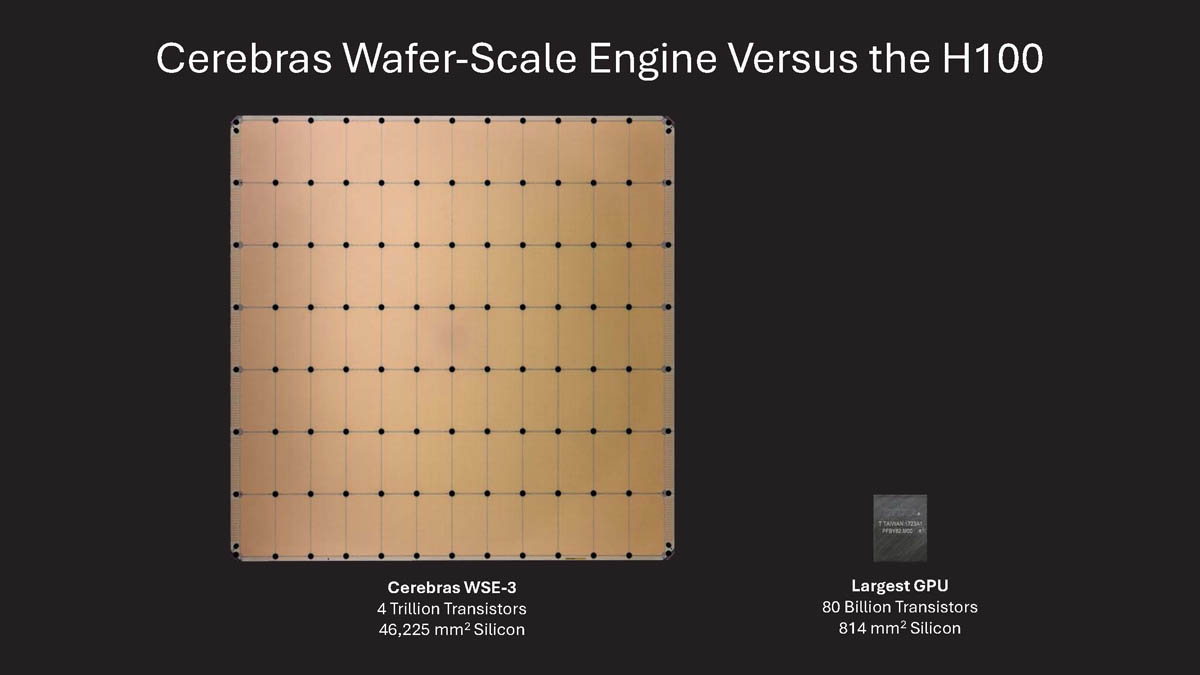

Il modello GPT-5.3-Codex-Spark di OpenAI ora beneficia della potenza di calcolo dei chip Cerebras WSE-3. L'ottimizzazione ha permesso di raggiungere una velocità di inference superiore a 1000 token al secondo.

Questa accelerazione è significativa per applicazioni che necessitano di risposte in tempo reale, come chatbot, assistenti virtuali e sistemi di generazione di testo automatizzati. La capacità di elaborare un elevato numero di token al secondo si traduce in una minore latenza e in un'esperienza utente più fluida.

Per chi valuta deployment on-premise, esistono trade-off da considerare attentamente. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi aspetti.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!