L'Innovazione "Fai-da-te" nel Data Center

Nel panorama dell'intelligenza artificiale, dove i costi dell'hardware possono essere proibitivi, emergono soluzioni ingegnose che sfidano lo status quo. Un recente progetto ha catturato l'attenzione della comunità tech, dimostrando come una GPU Nvidia Tesla V100 SMX, basata sul chip GV100, possa essere riadattata per l'uso in server PCIe con un investimento iniziale sorprendentemente basso, stimato intorno ai 200 dollari per la sola GPU.

Questa iniziativa evidenzia una tendenza crescente: la ricerca di alternative economicamente vantaggiose per l'inference di Large Language Models (LLM) in ambienti self-hosted. Per CTO e architetti di infrastruttura, la possibilità di sfruttare hardware di precedente generazione con modifiche mirate rappresenta un'opportunità per ottimizzare il Total Cost of Ownership (TCO) e mantenere il controllo sui propri dati.

Dettagli Tecnici e Implicazioni Hardware

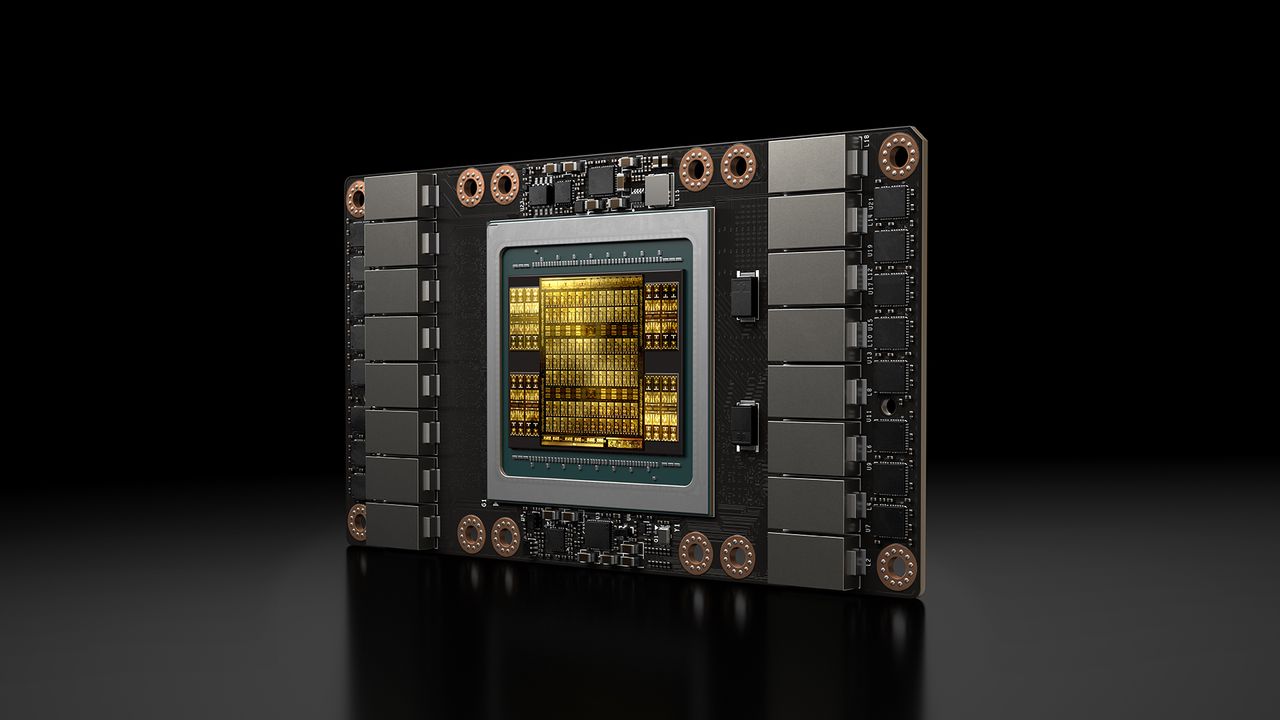

La GPU Nvidia Tesla V100, alimentata dal processore GV100, è stata una pietra miliare nel calcolo accelerato per data center. Originariamente progettata per formati proprietari come SMX, che richiedono infrastrutture server specifiche, la sua rielaborazione in una scheda PCIe standard è un'impresa tecnica non banale. Il progetto prevede l'uso di un PCB (Printed Circuit Board) personalizzato e un sistema di raffreddamento realizzato tramite stampa 3D, elementi cruciali per adattare la GPU a un fattore di forma più comune e gestirne la dissipazione termica.

Nonostante non sia l'ultima generazione di silicio, questa V100 modificata si è dimostrata capace di eseguire LLM con un'efficienza superiore a molte offerte di fascia media più recenti, specificamente per i carichi di lavoro di inference. Questa performance è significativa per chi cerca di massimizzare il valore dell'hardware esistente o di acquisire componenti a costi ridotti per sperimentare o implementare soluzioni AI in contesti on-premise.

Il Contesto del Deployment On-Premise e il TCO

La rilevanza di un simile progetto per i deployment on-premise è evidente. Le organizzazioni che prioritizzano la sovranità dei dati, la compliance normativa o che operano in ambienti air-gapped, spesso si trovano a dover affrontare costi elevati per l'acquisto e la gestione di hardware AI all'avanguardia. Soluzioni come questa offrono un percorso alternativo per costruire infrastrutture locali, riducendo la dipendenza da servizi cloud esterni e mantenendo i dati all'interno del proprio perimetro.

Tuttavia, è fondamentale considerare i trade-off. Se da un lato il costo iniziale di circa 200 dollari per la GPU è estremamente competitivo, dall'altro lato la realizzazione di un PCB personalizzato e di un sistema di raffreddamento richiede competenze ingegneristiche specifiche e tempo. Per chi valuta deployment on-premise, esistono framework analitici su /llm-onpremise che possono aiutare a ponderare questi aspetti, confrontando i costi iniziali (CapEx) con i costi operativi (OpEx) e la complessità di gestione di soluzioni custom rispetto a quelle commerciali.

Prospettive Future e Considerazioni per i CTO

Questo esempio di ingegneria 'fai-da-te' sottolinea la vivacità e l'innovazione che caratterizzano il settore dell'AI. Per i CTO e i decision-maker tecnici, rappresenta un promemoria che l'ottimizzazione delle risorse e la creatività possono sbloccare nuove possibilità per l'implementazione di carichi di lavoro AI. Sebbene le soluzioni modificate possano presentare sfide in termini di supporto, scalabilità e affidabilità a lungo termine rispetto a prodotti enterprise standard, la loro esistenza stimola il dibattito su come rendere l'AI più accessibile e controllabile.

La ricerca di un equilibrio tra performance, costo e controllo rimane una priorità per le aziende che desiderano integrare l'AI nelle proprie operazioni, specialmente quando la sovranità dei dati e la gestione del TCO sono fattori critici. Progetti come la V100 modificata dimostrano che il percorso verso un'infrastruttura AI efficiente e self-hosted è costellato di innovazioni sia convenzionali che non convenzionali.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!