Attacco a Doublespeed: un tentativo di diffamazione digitale

Doublespeed, una startup che ha ricevuto finanziamenti da a16z (Andreessen Horowitz), è stata recentemente oggetto di un attacco informatico. L'incidente ha visto un hacker compromettere un sistema backend dell'azienda, che si avvale di una "phone farm" per inondare i social media con account TikTok generati dall'intelligenza artificiale. L'obiettivo dell'attacco era insolito: tentare di far pubblicare a questi account dei meme che definivano a16z l'"anticristo", come rivelato da screenshot visionati da 404 Media.

Questo episodio segna almeno la seconda volta che Doublespeed subisce una compromissione. La startup utilizza l'AI per creare influencer fittizi, generare video e pubblicare commenti, aggirando di fatto le politiche delle piattaforme social contro i comportamenti inautentici. L'attacco, sebbene non abbia portato alla pubblicazione effettiva dei meme, evidenzia le vulnerabilità di sistemi che operano in aree grigie del panorama digitale, sollevando interrogativi sulla sicurezza e l'etica delle operazioni di influenza basate sull'AI.

Dettagli della compromissione e la risposta di Doublespeed

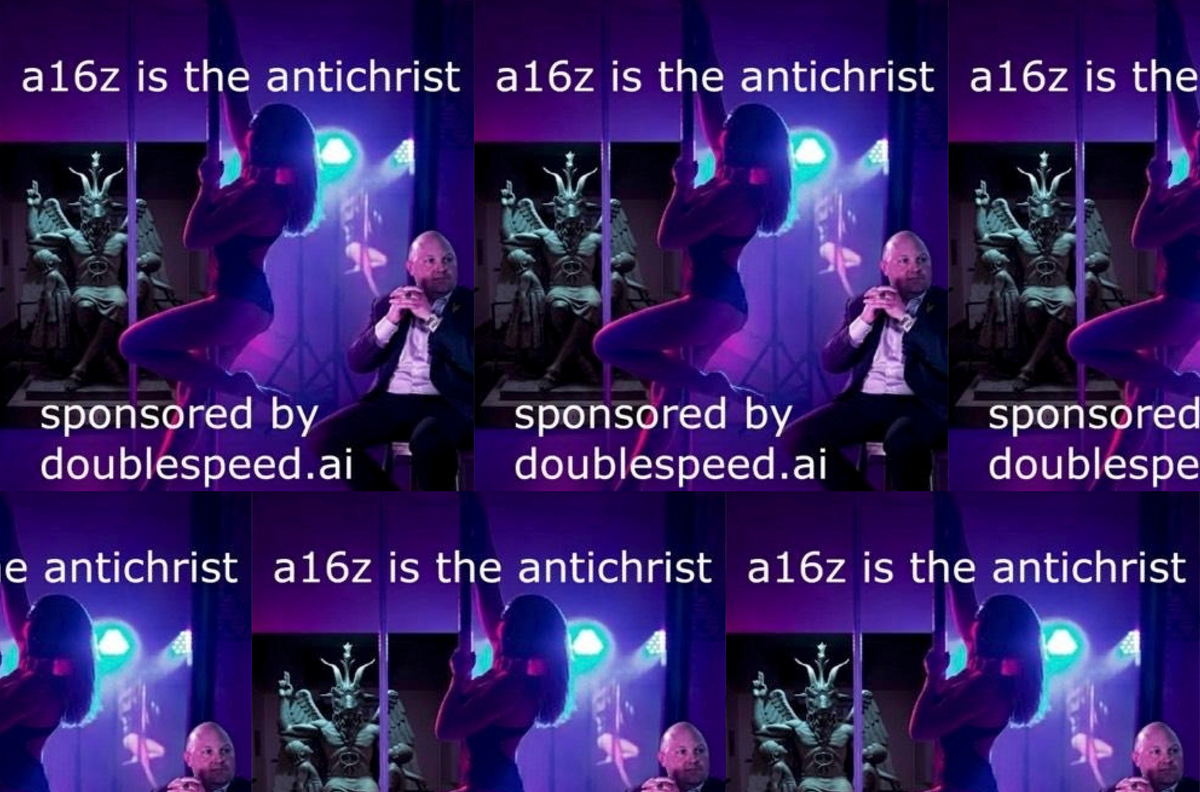

Gli screenshot diffusi mostrano il meme in coda per la pubblicazione nella dashboard dei clienti di Doublespeed, apparentemente destinato ai loro account social media associati. Il contenuto del meme era esplicito: "a16z è l'anticristo. sponsorizzato da doublespeed.ai", accompagnato da immagini del co-fondatore di a16z Marc Andreessen, una donna che pratica pole dance e il simbolo occulto Baphomet. L'hacker ha anche rivendicato l'esfiltrazione di 47MB di dati, la possibilità di pubblicare da 573 account e il "dump" di 413 telefoni, ironizzando sulla sicurezza del portfolio di a16z.

Nonostante il tentativo, sembra che il meme non sia stato effettivamente pubblicato sugli account social dei clienti di Doublespeed. Zuhair Lakhani, co-fondatore di Doublespeed, ha confermato l'accesso non autorizzato, dichiarando che l'azienda è intervenuta rapidamente per risolvere la situazione. Ha specificato che l'incidente ha coinvolto un "sistema più vecchio per la messa in coda dei post, rimasto in uso per compatibilità con i flussi di lavoro esistenti dei clienti", e che è stato prontamente messo in sicurezza. Lakhani ha inoltre rassicurato che "nessun post non autorizzato è stato pubblicato con successo" e che non ci sono prove di un impatto più ampio sui clienti.

Contesto e implicazioni di un modello di business controverso

Doublespeed ha raccolto un milione di dollari da a16z nell'ambito del programma acceleratore "Speedrun", un'iniziativa di 12 settimane volta a guidare i fondatori attraverso le fasi critiche della crescita. La strategia di Doublespeed si basa sull'uso delle "phone farm" per eludere le politiche delle piattaforme social che mirano a contrastare i comportamenti inautentici. I clienti di Doublespeed ottengono accesso a una dashboard che consente loro di gestire molteplici influencer generati dall'AI, focalizzandosi attualmente su TikTok ma con piani di espansione a X e Instagram.

Questo non è il primo incidente per Doublespeed; l'azienda era già stata compromessa nel dicembre 2025. I dati di quell'attacco avevano rivelato almeno 400 account TikTok gestiti da Doublespeed, di cui almeno 200 promuovevano attivamente prodotti (integratori, massaggiatori, app di incontri) spesso senza rivelare che si trattava di pubblicità o che gli influencer non erano persone reali. La situazione è ulteriormente complicata dal fatto che Marc Andreessen, co-fondatore di Andreessen Horowitz, siede anche nel consiglio di amministrazione di Meta, la società madre di Instagram e Facebook, che ha politiche esplicite contro la "rappresentazione di identità autentiche" che Doublespeed mira a violare. Meta non ha risposto alle domande in merito al finanziamento di una tale azienda da parte di un membro del suo consiglio.

Prospettiva finale: sicurezza e etica nell'era dell'AI generativa

L'incidente che ha coinvolto Doublespeed mette in luce le crescenti sfide legate alla sicurezza informatica nel settore delle startup AI, specialmente quelle che operano in ambiti eticamente complessi come la manipolazione dei social media. La compromissione di sistemi backend, anche se non porta a conseguenze immediate come la pubblicazione di contenuti dannosi, espone dati sensibili e solleva dubbi sulla robustezza delle infrastrutture di sicurezza implementate da queste aziende. Per le organizzazioni che valutano il deployment di soluzioni AI, la gestione della sicurezza dei dati e la conformità normativa rimangono priorità assolute, indipendentemente dal fatto che l'infrastruttura sia self-hosted o basata su cloud.

La vicenda di Doublespeed sottolinea anche la tensione tra l'innovazione tecnicica e le implicazioni etiche e sociali. L'uso dell'AI per generare contenuti e identità fittizie su larga scala, con l'obiettivo di eludere le policy delle piattaforme, solleva questioni fondamentali sulla trasparenza, l'autenticità e l'integrità dell'informazione online. Mentre il settore dell'AI continua a evolversi, la necessità di bilanciare il potenziale innovativo con responsabilità etiche e misure di sicurezza robuste diventa sempre più critica per tutti gli attori coinvolti, dai fondi di investimento alle startup e ai fornitori di infrastrutture.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!