Il Nuovo Scenario dell'AI Inference

Il panorama dell'AI inference è in costante evoluzione, caratterizzato da dinamiche di mercato che stanno ridefinendo le catene di approvvigionamento per i componenti hardware critici. La crescente domanda di capacità di intelligenza artificiale, in particolare per i carichi di lavoro di inference, sta guidando questa trasformazione in diversi settori industriali. Questo contesto evidenzia l'importanza strategica delle scelte hardware per le organizzazioni che mirano a implementare soluzioni AI robuste ed efficienti.

Tradizionalmente, il mercato è stato dominato da pochi attori consolidati, ma le recenti tensioni e le sfide nella supply chain stanno aprendo la strada a nuovi protagonisti. La capacità di adattarsi a queste mutevoli condizioni e di garantire la disponibilità di silicio è diventata un fattore competitivo cruciale per i fornitori e per le aziende che dipendono da queste tecnicie.

Dettagli Tecnici e Contesto di Mercato

L'AI inference, ovvero il processo di esecuzione di un modello di intelligenza artificiale per generare previsioni o risposte, rappresenta una componente fondamentale in molte applicazioni aziendali, dalla visione artificiale all'elaborazione del linguaggio naturale. Sebbene le GPU siano spesso la scelta preferita per le loro eccezionali capacità di calcolo parallelo, le CPU continuano a svolgere un ruolo significativo, specialmente per carichi di lavoro meno intensivi, per l'esecuzione di LLM quantizzati o dove la latenza è un vincolo primario.

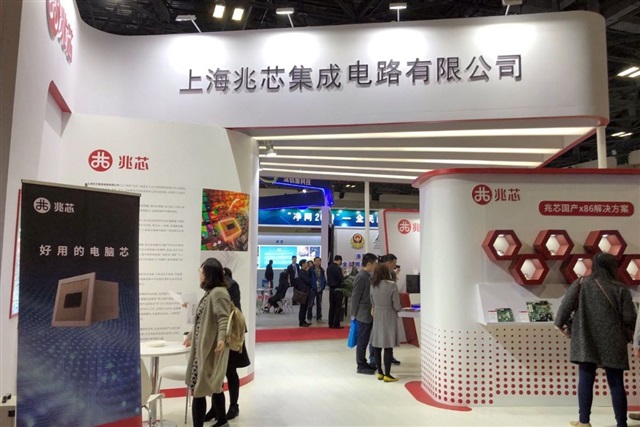

Le attuali difficoltà nelle catene di approvvigionamento di chip, in particolare quelle che coinvolgono fornitori storici come Intel e AMD, stanno creando un vuoto che altri attori stanno attivamente cercando di colmare. In questo scenario, i fornitori cinesi di CPU, come Shanghai Zhaoxin Semiconductor, stanno cogliendo l'opportunità di espandere la loro quota di mercato, offrendo alternative che possono mitigare i rischi legati alla dipendenza da un numero limitato di fonti.

Implicazioni per i Deployment On-Premise

Per le organizzazioni che privilegiano i deployment on-premise, la disponibilità e la diversificazione dei fornitori hardware sono fattori determinanti. La scelta di soluzioni self-hosted è spesso motivata dalla necessità di garantire la sovranità dei dati, rispettare stringenti requisiti di compliance e mantenere un controllo diretto sull'infrastruttura. In un ambiente dove le forniture tradizionali si stringono, l'emergere di nuovi fornitori offre opzioni vitali per mantenere la continuità operativa e la flessibilità strategica.

Queste alternative possono influenzare significativamente il Total Cost of Ownership (TCO) e la resilienza della supply chain. Valutare l'hardware di nuovi attori richiede un'analisi approfondita delle performance, del supporto software, della compatibilità con gli stack esistenti e della roadmap tecnicica a lungo termine. La capacità di integrare diverse architetture hardware diventa quindi un vantaggio competitivo per le aziende che operano in ambienti complessi e con vincoli specifici.

Prospettive Future e Trade-off Strategici

La dinamica attuale del mercato del silicio suggerisce una crescente frammentazione e una maggiore complessità nella pianificazione infrastrutturale. Le aziende devono valutare attentamente i trade-off tra performance, costo, disponibilità e supporto a lungo termine quando selezionano l'hardware per i loro carichi di lavoro AI. Questo include la considerazione di fattori come la VRAM disponibile, il throughput per token e la latenza, tutti elementi cruciali per l'efficienza dell'inference.

L'apertura a nuovi fornitori può offrire vantaggi in termini di diversificazione del rischio e accesso a tecnicie emergenti, ma richiede anche un'attenta due diligence. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per supportare le decisioni relative all'infrastruttura, enfatizzando l'importanza di un'analisi approfondita dei vincoli e delle opportunità. La capacità di navigare in questo scenario complesso sarà fondamentale per il successo delle strategie AI aziendali.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!