Benvenuti a un'altra edizione dell'Editoriale AI-Radar. Oggi vogliamo parlare della tecnica apparentemente non affascinante, altamente matematica e, in effetti, cruciale della rivoluzione dell'intelligenza artificiale: la quantization dei Large Language Model (LLM).

Come ha giustamente affermato Tim Dettmers, “La ricerca sulla quantization è come le stampanti. A nessuno importa delle stampanti. A nessuno piacciono le stampanti. Ma tutti sono felici se le stampanti fanno il loro lavoro”. Eppure, in un settore ossessionato da conteggi di parametri che sembrano PIL nazionali, la quantization è l'unica ragione per cui l'intera casa di carte non è crollata sotto il peso fisico dei propri requisiti hardware. Stiamo spingendo modelli con centinaia di miliardi di parametri, ma la realtà fisica del silicio e della larghezza di banda della memoria si rifiuta di piegarsi all'hype del software.

Quindi, cosa facciamo? Comprimiamo la matematica. Prendiamo i "cervelli" ad alta precisione di questi modelli e li comprimiamo. La chiamiamo quantization, ma siamo onesti: è arrotondamento avanzato. Ecco la storia senza fronzoli, la situazione attuale caotica, i vantaggi innegabili, gli svantaggi nascosti e una domanda persistente e scomoda sulle realtà commerciali che guidano il tutto.

La Storia: Dai Floating Point alle Aspettative in Picchiata

Per capire dove siamo, dobbiamo guardare a come ci siamo arrivati. La linea concettuale della quantization è radicata nell'elaborazione digitale dei segnali della metà del XX secolo. Nei primi giorni del deep learning, il floating-point a 32 bit (FP32) era lo standard aureo indiscusso. Avevamo bisogno di 32 bit—un bit di segno, otto bit di esponente e 23 bit di mantissa—per rappresentare ogni peso per mantenere i delicati gradienti necessari per la backpropagation.

Ma quando l'architettura Transformer ha innescato l'"esplosione dei parametri", FP32 è diventata una grave responsabilità. Un modello da 7 miliardi di parametri in FP32 richiede 28 GB di memoria; un modello da 70B richiede oltre 280 GB. Il primo compromesso del settore è stato la migrazione a formati a 16 bit (FP16 e BFloat16 di Google), che hanno immediatamente dimezzato l'ingombro della memoria con una perdita trascurabile di accuratezza.

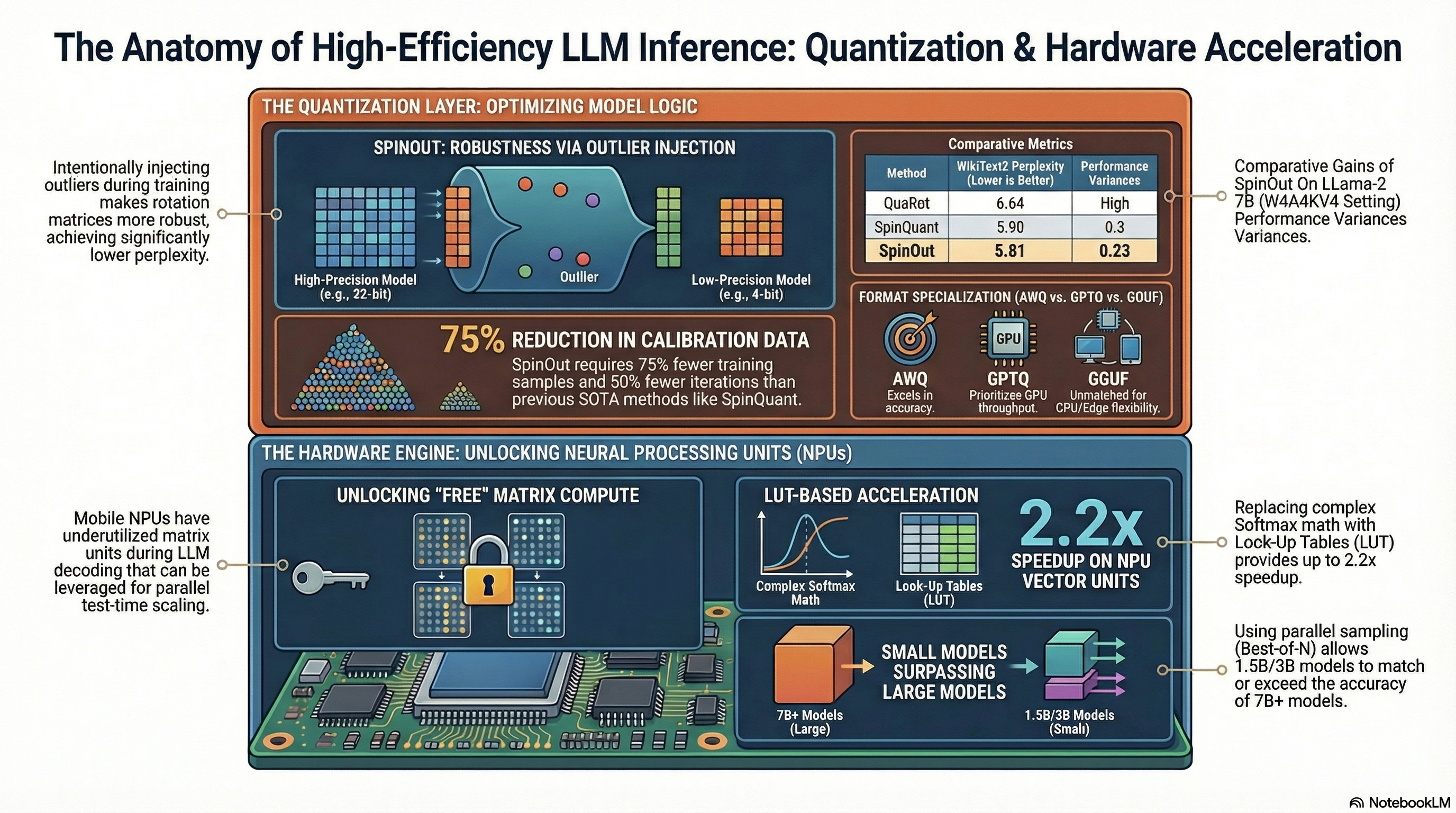

Tuttavia, anche 16 bit erano troppo pesanti per la distribuzione su larga scala. Il momento spartiacque è arrivato nel 2022 con l'introduzione di General Pre-trained Transformer Quantization (GPTQ), un metodo post-training che ha dimostrato che i pesi a 4 bit erano effettivamente fattibili. Improvvisamente, la corsa è iniziata. Nel 2023, framework come Activation-aware Weight Quantization (AWQ) e SmoothQuant hanno rivelato che la difficoltà nella compressione non erano i pesi, ma le attivazioni "outlier"—valori estremi in canali specifici che rompevano gli schemi di arrotondamento naive. Scalando dinamicamente questi outlier, i ricercatori sono riusciti a comprimere i modelli in formati a 4 bit e 8 bit senza praticare una lobotomia digitale all'IA.

La Situazione Attuale: Il Selvaggio West dei 4-Bit

Oggi, la precisione a 4 bit è la ricetta di implementazione predefinita. Siamo passati dalla compressione sperimentale a un'era di co-design hardware-software.

Il panorama attuale è diviso da paradigmi algoritmici concorrenti e formati frammentati. Per l'inference locale su CPU e Apple Silicio (che vanta un enorme vantaggio dell'architettura di memoria unificata, offrendo fino a 546 GB/s di larghezza di banda sull'M4 Max), il formato GGUF regna sovrano. GGUF impiega "K-Quants", dividendo i pesi in super-blocchi e utilizzando la doppia quantization per spremere ogni goccia di efficienza. Nel frattempo, per le GPU NVIDIA, formati come GPTQ, AWQ e EXL2 dominano, ottimizzando per operazioni CUDA ad alta velocità.

Al livello aziendale, le linee di battaglia sono tracciate tra Post-Training Quantization (PTQ) e Quantization-Aware Training (QAT). PTQ è l'opzione veloce ed economica: si prende un modello completamente addestrato, si esegue un piccolo dataset di calibrazione attraverso di esso e si quantizzano i pesi. Il lato negativo? Perdita di accuratezza. Quando PTQ fallisce—specialmente a profondità aggressive di 2 bit o 3 bit—gli ingegneri implementano QAT. QAT integra nodi di quantization fittizi direttamente nel ciclo di addestramento, costringendo il modello a "imparare a convivere con il rumore di quantization" attraverso un trucco Straight-Through Estimator. QAT preserva l'accuratezza quasi-FP32 anche a 4 bit, ma richiede le stesse ore di GPU che la quantization doveva salvare.

Simultaneamente, il mercato dell'edge AI è esploso. Le Neural Processing Unit (NPU) mobili come il Qualcomm Snapdragon 8 Elite Gen 5 (che spinge 80-85 TOPS) e Ryzen AI 400 di AMD stanno spostando gli LLM direttamente su smartphone e laptop. Tuttavia, l'implementazione di NPU rivela una dura verità: la larghezza di banda della memoria, non la potenza di calcolo grezza (TOPS), è il vero collo di bottiglia. Poiché la decodifica LLM è vincolata alla memoria—trasmettendo in streaming i pesi dell'intero modello per ogni token generato—la larghezza di banda di 50-90 GB/s di un dispositivo mobile richiede assolutamente la quantization a 4 bit per funzionare senza fondere lo chassis.

Ma la vera frontiera risiede nel paradigma ternario a 1,58 bit, guidato da BitNet di Microsoft. BitNet limita i pesi a {-1, 0, 1}, eliminando completamente le moltiplicazioni di matrici in virgola mobile ad alta intensità energetica a favore di semplici addizioni e sottrazioni. A 3 miliardi di parametri, BitNet b1.58 corrisponde alle baseline FP16 pur funzionando 2,71 volte più velocemente e utilizzando 3,55 volte meno memoria. È uno sguardo a un futuro nativamente privo di moltiplicazioni.

I Pro: Fare di Più con Meno

I vantaggi della quantization sono matematicamente indiscutibili e commercialmente vitali.

1. Massiccia Riduzione della Memoria: Passare da FP32 a un formato INT4 riduce un modello dell'87,5%. Un modello da 70B di parametri che in precedenza richiedeva un rack di server A100 può ora essere inserito in una singola GPU workstation da 96 GB o in un Mac Studio di fascia alta.

2. Velocità e Throughput: Poiché l'inference è vincolata alla larghezza di banda della memoria, leggere meno byte per token si traduce direttamente in una maggiore generazione di token al secondo. Inoltre, l'aritmetica intera è computazionalmente più semplice, consentendo ai moderni Tensor Core di elaborare i dati a velocità notevolmente accelerate.

3. Efficienza Energetica e Costi: La quantization può ridurre il consumo di energia per l'inference fino al 79-80%. Nei data center cloud, servire un modello quantizzato a 8 bit o 4 bit si traduce in un risparmio del 30-50% sulle bollette dell'infrastruttura.

4. Implementazione Edge e Privacy: La quantization rende realtà l'"AI on-device". Eseguire modelli localmente su smartphone o NPU edge IoT significa zero latenza di rete e privacy assoluta. I dati dell'utente non lasciano mai il dispositivo, eludendo le vulnerabilità del cloud e rispettando i rigidi framework GDPR.

I Contro: Il Prezzo della Compressione

Naturalmente, non esiste un pranzo gratis nell'informatica. Non si può scartare l'87,5% della precisione numerica di una rete neurale senza indurre un certo livello di danno cerebrale.

1. La Scogliera dell'Accuratezza e del Ragionamento: Mentre la quantization a 8 bit è praticamente senza perdite, quella a 4 bit fa scendere la perplexity dell'1-2% e scendere a 3 bit o 2 bit innesca un degrado catastrofico. In compiti logici complessi, matematica e ragionamento multi-turno (come il benchmark GSM8K), i modelli quantizzati grossolanamente subiscono gravi cali di prestazioni e allucinano selvaggiamente. Il modello potrebbe parlare fluentemente, ma la sua logica sottostante è distrutta.

2. Il Mostro della Cache KV: Celebriamo la riduzione dei pesi statici del modello, ma durante l'inference, la cache Key-Value (KV)—la memoria necessaria per tracciare il contesto conversazionale—cresce linearmente con la lunghezza della sequenza. Per applicazioni a contesto lungo, la cache KV può facilmente superare le dimensioni dei pesi del modello compresso, annullando i vantaggi della quantization a meno che la cache stessa non sia quantizzata in modo aggressivo.

3. Inefficienze NPU e Hardware: Le moderne NPU vantano TOPS elevati, ma le loro unità vettoriali per scopi generali hanno una larghezza di banda della memoria abissale rispetto alle loro unità matriciali specializzate. Operazioni chiave come Softmax o la dequantization a precisione mista spesso diventano colli di bottiglia devastanti sui dispositivi edge a meno che gli ingegneri non ricorrano a complesse soluzioni alternative come le Look-Up Table (LUT).

4. Vulnerabilità Avversarie: I modelli quantizzati sono statisticamente più fragili. La perdita di precisione li rende altamente suscettibili alle iniezioni di prompt avversarie e agli attacchi bit-flip, spesso esibendo un Attack Success Rate (ASR) superiore del 10-20% rispetto alle loro controparti a precisione completa.

La Grande Illusione: Un Dubbio Conclusivo

Questo ci porta all'ironia della nostra attuale traiettoria tecnicica. Possediamo l'alchimia matematica per eseguire LLM incredibilmente capaci su hardware di livello consumer. Ricerche come BitNet dimostrano che i modelli ternari a 1 bit e 1,58 bit possono corrispondere all'accuratezza FP16 su larga scala, abbandonando completamente la moltiplicazione di matrici ad alta intensità energetica. Sappiamo che attraverso un Quantization-Aware Training intelligente, possiamo sintetizzare un'intelligenza altamente compressa e altamente capace che non richiede un reattore nucleare dedicato per funzionare.

Tuttavia, la stragrande maggioranza del capitale, della ricerca e dello slancio aziendale rimane ostinatamente fissata sull'aumento di cluster massicci e ad alta precisione.

Ci si deve chiedere, da un punto di vista puramente editoriale: i grandi laboratori di IA stanno trascurando massicci investimenti in architetture native a 1 bit e quantization estrema a causa degli interessi commerciali dei grandi produttori di chip? L'attuale boom dell'IA ha creato una capitalizzazione di mercato di trilioni di dollari per le aziende che vendono VRAM e massicci acceleratori GPU. Se il settore dovesse improvvisamente passare ad architetture quantizzate nativamente e prive di moltiplicazione—modelli così efficienti da poter funzionare perfettamente su CPU di base e NPU di base—il mercato premium per le GPU da datacenter da 40.000 dollari affronterebbe una minaccia esistenziale.

In un ecosistema in cui i venditori di pale sono le entità più redditizie nella corsa all'oro, creare una pala che costa pochi centesimi e dura per sempre è un male per gli affari. Forse la quantization LLM non è solo una sfida algoritmica; forse è una minaccia commerciale che i titani del silicio preferirebbero mantenere relegata agli hobbisti e all'edge, lontano dai redditizi rack del cloud.

Forse suona un po' estremo come pensiero, ma rimango convinto che il geniale concetto di Quantization e i relativi progressi futuri potrebbero essere rallentati per garantire gli interessi commerciali dei grandi pesi massimi. Spero di sbagliarmi.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!