Il divario crescente tra ottimismo e ansia nell'era AI

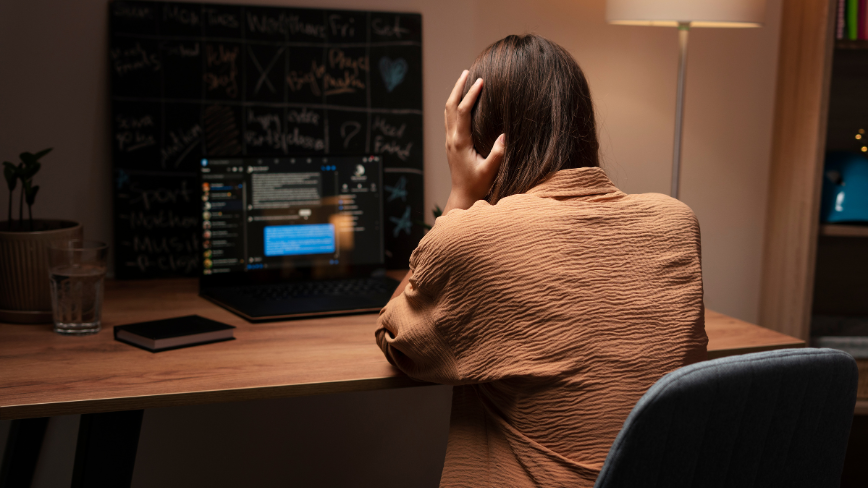

Il panorama dell'intelligenza artificiale continua a evolversi a ritmi serrati, ma la percezione pubblica e quella degli addetti ai lavori sembrano divergere sempre più. È quanto emerge dal rapporto annuale AI Index 2026, pubblicato dallo Stanford Institute for Human-Centered AI. Il documento evidenzia un profondo disallineamento tra l'ottimismo che pervade gli ambienti esperti e una crescente ansia manifestata dal pubblico generale.

Questa polarizzazione della percezione non è un fenomeno isolato, ma un indicatore di come la rapida progressione tecnicica stia generando reazioni complesse a livello sociale. Per le aziende e i team tecnici che si occupano del deployment di Large Language Models (LLM) e altre soluzioni AI, comprendere questo divario è cruciale per navigare un ambiente in cui l'accettazione e la fiducia giocano un ruolo sempre più determinante.

Preoccupazioni generazionali e impatto sull'occupazione

Il rapporto di Stanford mette in luce alcune tendenze preoccupanti, in particolare tra le fasce più giovani della popolazione. L'analisi indica un rapido aumento della "rabbia" o frustrazione della Generazione Z nei confronti dell'intelligenza artificiale. Questo sentimento, se non affrontato, potrebbe avere ripercussioni significative sull'adozione e sull'integrazione delle tecnicie AI nella società e nel mercato del lavoro.

Parallelamente, il documento segnala un declino nell'occupazione dei lavoratori più giovani in settori considerati "esposti" all'AI. Questo dato solleva interrogativi importanti sulle dinamiche del mercato del lavoro e sulla necessità di strategie di riqualificazione e adattamento. Per i CTO e i responsabili DevOps, ciò significa non solo gestire l'infrastruttura e i Framework tecnicici, ma anche considerare l'impatto sociale e la percezione dei propri progetti AI, specialmente quando si tratta di automazione e ottimizzazione dei processi.

Fiducia nella regolamentazione e sovranità dei dati

Un altro aspetto critico evidenziato dal rapporto riguarda la fiducia nella capacità dei governi di regolamentare l'AI. Negli Stati Uniti, in particolare, la fiducia del pubblico nella propria amministrazione per la regolamentazione dell'intelligenza artificiale è la più bassa tra tutti i paesi esaminati. Questo dato è particolarmente rilevante per le aziende che operano in contesti internazionali o che gestiscono dati sensibili.

La mancanza di fiducia nella regolamentazione governativa può spingere le organizzazioni a cercare maggiore controllo e autonomia sui propri stack AI. Questo si traduce spesso nella valutazione di opzioni di deployment self-hosted o on-premise, dove la sovranità dei dati, la compliance e la sicurezza possono essere gestite direttamente, anche in ambienti air-gapped. La scelta tra cloud e infrastruttura bare metal diventa quindi non solo una questione di TCO o Throughput, ma anche di mitigazione del rischio reputazionale e normativo.

Prospettive per il deployment di LLM e l'etica dell'AI

Le scoperte del rapporto AI Index 2026 sottolineano l'importanza di un approccio olistico al deployment dell'intelligenza artificiale. Per i decision-maker tecnici, non è più sufficiente concentrarsi solo sulle prestazioni degli LLM o sull'efficienza dell'Inference. È fondamentale integrare considerazioni etiche, sociali e di governance fin dalle prime fasi della Pipeline di sviluppo e rilascio.

La crescente ansia pubblica e la sfiducia nella regolamentazione impongono alle aziende di essere proattive nella dimostrazione di un uso responsabile dell'AI. Questo può includere la trasparenza sui modelli, l'implementazione di robusti controlli di sicurezza e privacy, e la scelta di architetture che garantiscano il massimo controllo sui dati e sui processi. Per chi valuta deployment on-premise, esistono framework analitici su /llm-onpremise che possono aiutare a valutare i trade-off tra controllo, costi e scalabilità, in un contesto dove la fiducia e la compliance sono sempre più centrali.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!