L'AI locale per la caccia ai bug: il caso del kernel Linux

Greg Kroah-Hartman, una delle figure più influenti e il "secondo in comando" nello sviluppo del kernel Linux, sta esplorando nuove frontiere nell'ottimizzazione del codice. La sua ultima iniziativa lo vede impiegare un bot di intelligenza artificiale locale, progettato specificamente per identificare e segnalare bug all'interno del vasto codebase del kernel. Questo approccio innovativo sottolinea un crescente interesse verso l'adozione di soluzioni AI self-hosted per compiti critici, dove la sovranità dei dati e il controllo diretto sull'infrastruttura sono prioritari.

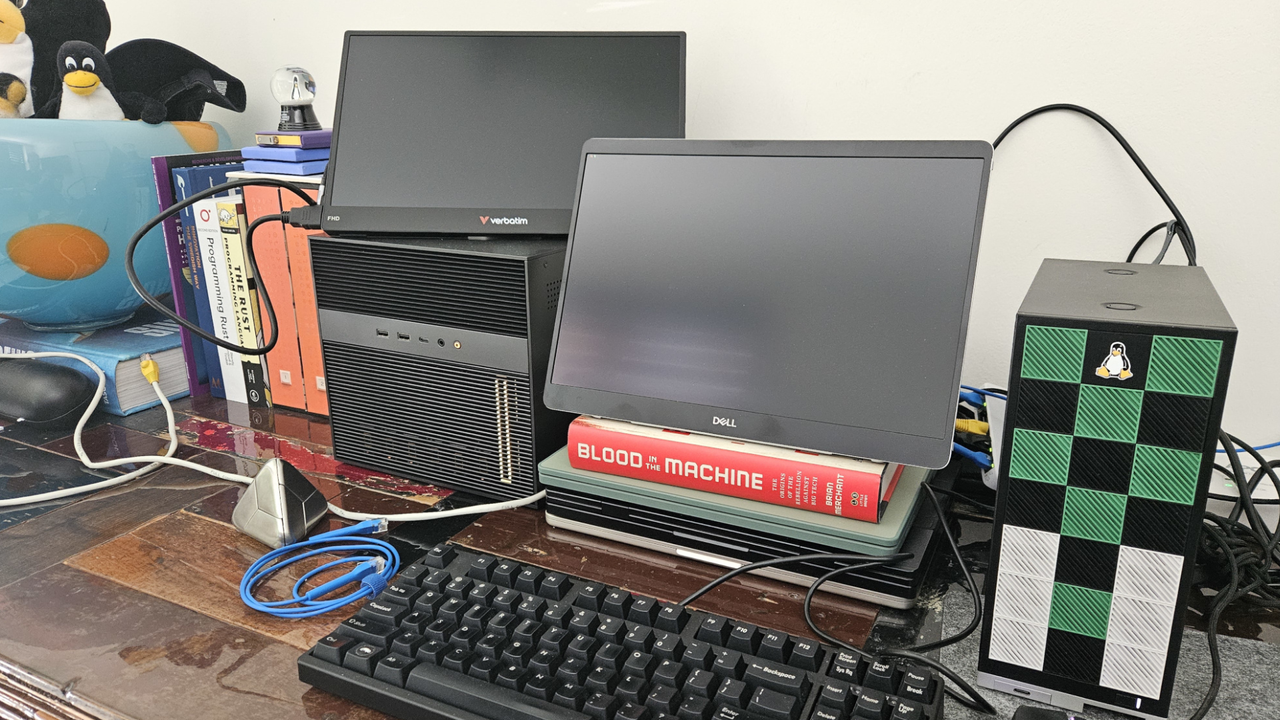

Il sistema, battezzato "Clanker T1000", non è una soluzione cloud-based, ma un'implementazione on-premise che sfrutta hardware consumer di ultima generazione. Questa scelta riflette una tendenza emergente nel settore tecnicico, dove le capacità di calcolo distribuite e l'inference AI locale stanno diventando sempre più accessibili e performanti. L'obiettivo è chiaro: migliorare la qualità del codice e la stabilità del sistema operativo più diffuso al mondo, utilizzando strumenti all'avanguardia in un ambiente controllato.

Il "Clanker T1000": hardware e implicazioni tecniche

Al centro del "Clanker T1000" si trova un Framework Desktop, una piattaforma nota per la sua modularità e la facilità di aggiornamento, equipaggiata con un processore AMD Ryzen AI Max+. Questa combinazione hardware è significativa. I processori AMD Ryzen AI Max+ integrano una Neural Processing Unit (NPU) dedicata, progettata per accelerare i carichi di lavoro di intelligenza artificiale direttamente sul dispositivo, riducendo la dipendenza da risorse cloud esterne.

L'adozione di un Framework Desktop, abbinata a un processore con capacità AI integrate, evidenzia una strategia di deployment che privilegia l'efficienza energetica e la latenza ridotta per l'inference AI. Per compiti come l'analisi del codice, dove la privacy dei dati e la rapidità di elaborazione sono cruciali, un setup self-hosted offre vantaggi distinti. Permette di mantenere il codice sorgente sensibile all'interno dell'ambiente locale, evitando trasferimenti verso servizi cloud esterni e garantendo un controllo completo sul processo di analisi.

Impatto e considerazioni per i deployment on-premise

I risultati preliminari dell'iniziativa di Kroah-Hartman sono già tangibili: il bot AI ha contribuito alla scoperta e alla risoluzione di quasi due dozzine di patch per il kernel Linux. Questo dato concreto dimostra l'efficacia dell'AI nel supportare compiti complessi di ingegneria del software, anche con risorse locali. Per CTO, DevOps lead e architetti di infrastruttura, questo caso studio offre spunti importanti sulla fattibilità e i benefici dei deployment di LLM e AI in ambienti on-premise.

La scelta di un sistema locale per la caccia ai bug nel kernel Linux evidenzia i trade-off tra soluzioni cloud e self-hosted. Mentre il cloud offre scalabilità immediata e costi operativi flessibili, le implementazioni on-premise garantiscono maggiore controllo sui dati, prevedibilità dei costi a lungo termine (TCO) e la possibilità di operare in ambienti air-gapped o con stringenti requisiti di compliance. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off, considerando fattori come la sovranità dei dati, le specifiche hardware e le esigenze di throughput.

Prospettive future dell'AI nel ciclo di sviluppo

L'esperimento di Greg Kroah-Hartman non è solo un aneddoto tecnicico, ma un indicatore della direzione che l'intelligenza artificiale sta prendendo nel ciclo di sviluppo software. L'integrazione di capacità AI direttamente nell'hardware client e server, come dimostrato dall'AMD Ryzen AI Max+, sta democratizzando l'accesso a potenti strumenti di analisi e automazione. Ciò apre la strada a scenari in cui gli sviluppatori possono sfruttare l'AI per migliorare la qualità del codice, accelerare i processi di testing e rafforzare la sicurezza, il tutto mantenendo i dati sensibili all'interno dei propri confini infrastrutturali.

Questo approccio "AI-first" e "on-premise-first" per la manutenzione del kernel Linux potrebbe servire da modello per altre organizzazioni che cercano di implementare soluzioni AI per la gestione del codice, la documentazione o la knowledge base interna. La capacità di eseguire l'inference localmente, con hardware dedicato, offre un percorso per bilanciare innovazione, sicurezza e controllo dei costi, aspetti fondamentali per le decisioni strategiche in ambito IT.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!