Il Calcolo AI: Da Costo a Centro di Profitto

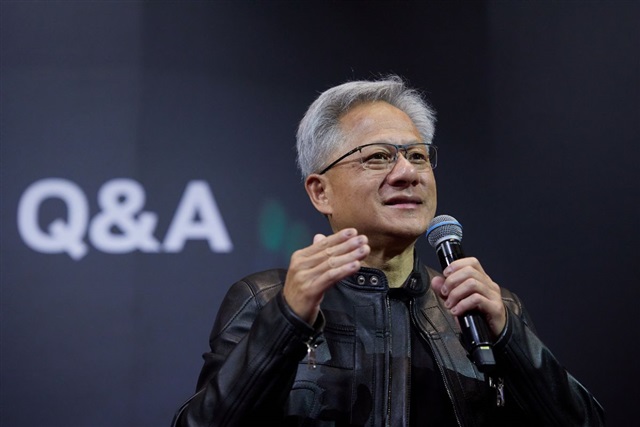

Jensen Huang, CEO di Nvidia, ha recentemente offerto una prospettiva innovativa sul futuro del calcolo AI, ridefinendo i computer come vere e proprie "fabbriche" direttamente connesse alla generazione di ricavi aziendali. Questa dichiarazione, riportata da DIGITIMES, segna un cambiamento significativo nel modo in cui l'industria percepisce e valorizza l'infrastruttura computazionale dedicata all'intelligenza artificiale. Non più semplici strumenti di supporto, ma asset strategici capaci di produrre valore tangibile.

La metafora della "fabbrica" suggerisce un processo produttivo ben definito, dove l'input è costituito da dati e modelli, e l'output è rappresentato da insight, decisioni automatizzate o, nel contesto dei Large Language Models (LLM), la generazione di "token" che si traducono in servizi e applicazioni a valore aggiunto. Questa visione spinge le organizzazioni a considerare l'investimento in capacità di calcolo AI non come una spesa operativa, ma come un capitale produttivo con un ritorno sull'investimento misurabile.

La "Fabbrica di Token" e l'Inference

Il concetto di "fabbrica di token" è particolarmente rilevante nel panorama degli LLM. Ogni interazione con un modello generativo, che sia per la creazione di contenuti, l'assistenza clienti o l'analisi di dati, comporta la generazione di token. La capacità di un'azienda di produrre questi token in modo efficiente e su larga scala diventa quindi un fattore critico per la sua competitività e per la monetizzazione dei propri servizi basati sull'AI.

Per costruire e gestire queste "fabbriche", le aziende devono affrontare sfide complesse legate all'hardware e al software. L'Inference di LLM richiede GPU con elevata VRAM e throughput, capaci di elaborare grandi volumi di richieste con bassa latenza. La scelta tra diverse architetture di silicio, la gestione della Quantization dei modelli e l'ottimizzazione delle pipeline di deployment sono tutti elementi che influenzano direttamente l'efficienza e il TCO di questa "produzione" di token.

Implicazioni per il Deployment On-Premise

La visione di Huang rafforza l'argomento a favore dei deployment self-hosted e on-premise per i carichi di lavoro AI. Se il calcolo AI è una "fabbrica" che genera ricavi, allora il controllo diretto su questa fabbrica diventa un vantaggio strategico. Le aziende possono così ottimizzare l'hardware per le proprie esigenze specifiche, garantendo la sovranità dei dati e la conformità normativa, aspetti cruciali in settori come la finanza o la sanità.

Un deployment on-premise permette inoltre un controllo più granulare sul TCO, bilanciando il CapEx iniziale con i costi operativi a lungo termine, inclusi quelli energetici. La possibilità di operare in ambienti air-gapped offre un livello di sicurezza e isolamento che le soluzioni cloud difficilmente possono eguagliare per determinate applicazioni critiche. Per chi valuta deployment on-premise, esistono framework analitici su /llm-onpremise che aiutano a valutare i trade-off tra controllo, costo e scalabilità.

Prospettive Future e Decisioni Strategiche

La ridefinizione del calcolo AI come "fabbrica di ricavi" sposta l'attenzione dalla semplice adozione tecnicica alla sua integrazione strategica nel modello di business. Le decisioni relative all'infrastruttura AI, che si tratti di investire in nuove GPU, ottimizzare i Framework esistenti o scegliere tra soluzioni bare metal e containerizzate, diventano decisioni di investimento con un impatto diretto sui profitti.

Questo scenario impone ai CTO, ai responsabili DevOps e agli architetti di infrastruttura di valutare attentamente non solo le capacità tecniche, ma anche le implicazioni economiche e strategiche di ogni scelta. La capacità di costruire e gestire efficientemente la propria "fabbrica di token" sarà un fattore distintivo per le aziende che intendono capitalizzare appieno il potenziale trasformativo dell'intelligenza artificiale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!