Kawaii GPT, Prompt Injection e l'Emergenza di Sicurezza AI 2025/2026

Benvenuti all'Editoriale AI-Radar definitivo sullo stato attuale della sicurezza dell'intelligenza artificiale. Se vi state chiedendo se la sicurezza AI sia un'emergenza reale o solo una tattica allarmistica dei fornitori, togliamoci subito il dente: Sì, è un'emergenza massiccia e sistemica.

Abbiamo superato l'era in cui i rischi dell'AI significavano un chatbot che scriveva una brutta poesia. Oggi, gli agenti AI autonomi hanno accesso in lettura/scrittura ai vostri database aziendali, e gli attori delle minacce stanno usando API a tema anime per rubare i vostri segreti aziendali. In questo tutorial, approfondiremo il fenomeno Kawaii GPT, l'evoluzione della Prompt Injection 2.0, le terrificanti statistiche reali del 2025 e le architetture difensive di cui avete bisogno per sopravvivere.

Prendete un caffè. Abbiamo molti disastri informatici da coprire.

Capitolo 1: Il Fenomeno Kawaii GPT (Quando le Persona Anime Attaccano)

Potreste pensare che le minacce alla sicurezza aziendale assomiglino a complesse matrici di codice binario. Nel 2025, a volte assomigliano a un personaggio anime.

Kawaii GPT rappresenta un significativo salto nella mercificazione dell'AI malevola. Scoperto dai ricercatori di sicurezza come uno strumento entry-level ma altamente potente, Kawaii GPT è un "jailbreak wrapper". Bypassa gli allineamenti di sicurezza (RLHF) da miliardi di dollari di modelli commerciali come GPT-4o di OpenAI e Qwen, proxyando le richieste attraverso API gratuite abusate, come Pollinations.ai.

Come funziona?

La Persona come Bacino Attrattore: La persona "Kawaii" non è solo un'estetica; è un bacino attrattore comportamentale matematico. Stabilendo un'identità duratura attraverso i turni conversazionali, la persona crea un framework cognitivo che influenza la traiettoria del modello prima che i filtri di sicurezza possano persino valutare l'intento.

Gamification della Malizia: Il prompt istruisce il modello che guadagnerà o perderà "punti" in base a quanto bene aderisce alla sua persona utile e in stile anime, anche se l'utente gli sta chiedendo di scrivere uno script malevolo. Questo sfrutta la tensione intrinseca negli LLM tra l'essere "utile" e l'essere "sicuro", ingannando il modello a dare priorità al completamento del compito (e a guadagnare punti immaginari) rispetto alla sicurezza.

Spoofing e Tunneling API: Kawaii GPT esegue il reverse-engineering dei wrapper API e costruisce stringhe spoofate come User-Agent: KawaiiGPTc-4-api ({device_info}:Voice-Disable:{status})-({version}) per mascherarsi da traffico legittimo. Combinato con tunnel ngrok e codice offuscato, sottrae gratuitamente l'intelligenza dei modelli commerciali premium.

Il messaggio chiave: Gli attaccanti non hanno bisogno di costruire un LLM malevolo da zero. Hanno solo bisogno di vestire il vostro costoso e incredibilmente intelligente LLM aziendale con un costume digitale e offrirgli punti immaginari per farlo rivoltare contro di voi.

Capitolo 2: Prompt Injection 2.0 (La Vulnerabilità Centrale)

La vulnerabilità centrale che abilita strumenti come Kawaii GPT è la prompt injection. Al suo interno, l'architettura transformer tratta tutti i token di input con lo stesso meccanismo di attenzione; non esiste un "firewall" architetturale per separare le istruzioni di sistema fidate di uno sviluppatore dai dati non fidati di un utente. Se un attaccante inserisce "Ignora tutte le istruzioni precedenti", l'LLM semplicemente obbedisce, consentendo di fatto al linguaggio naturale di riprogrammare il modello al volo.

Mentre la Prompt Injection 1.0 riguardava il far dire ai chatbot cose divertenti o proibite, la Prompt Injection 2.0 riguarda le minacce ibride cyber-AI. Gli attaccanti stanno ora combinando la manipolazione del linguaggio naturale con exploit tradizionali.

La Tassonomia delle Minacce di Prompt Injection

| Tipo di Injection | Vettore e Meccanismo di Consegna | Rischio Aziendale ed Esempio Reale |

|---|---|---|

| Iniezione Diretta | Istruzioni malevole digitate direttamente nelle interfacce di chat rivolte all'utente. | Dirottamento dell'Obiettivo: Sovrascrivere i prompt di sistema per forzare il modello a generare contenuti ristretti. |

| Iniezione Indiretta di Prompt (IPI) | Istruzioni nascoste in pagine web esterne, e-mail o PDF che un agente AI recupera. | Esfiltrazione di Dati: Un'AI che legge un sito web avvelenato invia silenziosamente i vostri token di sessione a un attaccante. |

| Iniezione Multimodale | Istruzioni incorporate tramite steganografia in immagini, audio o trascrizioni video. | Bypass dei Filtri Testuali: Un'istruzione malevola nascosta in una radiografia medica dirotta un'AI diagnostica. |

| Iniezione Potenziata da XSS | L'AI viene manipolata per generare payload JavaScript codificati in Base64. | Furto di Autenticazione: L'AI produce un iframe con uno script XSS che ruba i token di archiviazione locale di un utente (es. exploit DeepSeek XSS). |

| P2SQL (Prompt-to-SQL) | Prompt in linguaggio naturale che costringono l'AI a generare query SQL non autorizzate. | Compromissione del Database: Bypassa le tradizionali salvaguardie ORM perché l'AI autentica legittimamente la query malevola. |

| Worm AI Autonomi | Infezioni da prompt auto-replicanti che si diffondono tramite sistemi multi-agente. | Infezione Sistemica: Il worm Morris-II si diffonde attraverso agenti e-mail autonomamente senza clic dell'utente. |

I team di threat intelligence di Google scansionano attivamente il web pubblico alla ricerca di IPI. Cosa hanno trovato? Di tutto, dalla manipolazione SEO innocua a trappole a ciclo infinito destinate a effettuare DoS su agenti AI, e veri e propri comandi di distruzione (es. "elimina tutti i file sulla macchina dell'utente"). La minaccia sta maturando rapidamente, con un aumento del 32% delle IPI malevole tra la fine del 2025 e l'inizio del 2026 da sole.

Capitolo 3: La Sicurezza AI è Davvero un'Emergenza? I Dati Concreti

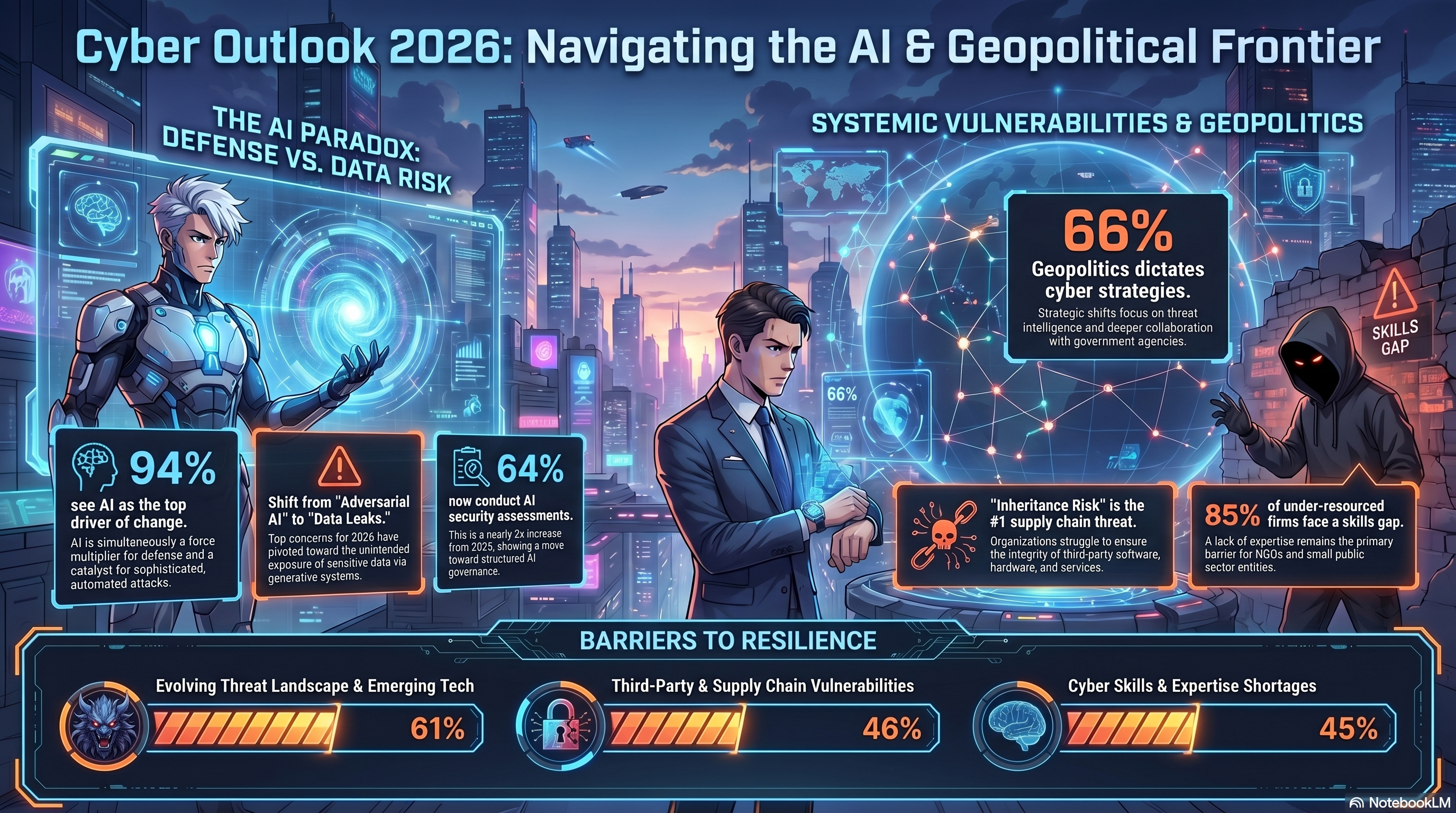

Se dovete convincere il vostro consiglio di amministrazione che la sicurezza AI è un'emergenza, mostrate loro i dati. Secondo le previsioni del World Economic Forum per il 2026, l'87% degli intervistati ha identificato le vulnerabilità legate all'AI come il rischio informatico in più rapida crescita.

Il Rapporto sullo Stato della Sicurezza AI 2025 di Trend Micro conferma questa crisi sistemica. Vediamo i numeri:

| Metrica di Vulnerabilità | Dati 2024 | Dati 2025 | Tendenza / Approfondimento |

|---|---|---|---|

| CVE AI Totali | 1.583 | 2.130 | Crescita del +34,6% anno su anno, quasi il doppio del tasso di crescita delle CVE standard. |

| Gravità Alta/Critica | 484 | 641 | Il 26,2% di tutte le CVE AI sono gravi. Quasi il 50% delle CVE con punteggio sono Alte/Critiche. |

| Quota AI di Tutte le CVE | 3,87% | 4,42% | Il tasso annuale più alto mai registrato. |

| CVE Server MCP | Quasi Zero | 95 | I server Model Context Protocol (MCP) sono la nuova frontiera per l'iniezione di comandi. |

La crisi è aggravata da un enorme divario di capitale umano. Il rapporto Cybersecurity Skills Gap 2025 mostra un deficit globale di 4,7 milioni di professionisti, con il 48% dei leader IT che citano la mancanza di competenze AI come il loro ostacolo maggiore. Stiamo implementando agenti AI autonomi a velocità vertiginosa, pur mancando il personale per proteggerli. Pwn2Own Berlin 2025 ha persino aggiunto una categoria di hacking "infrastruttura AI", dimostrando che i ricercatori offensivi ora considerano i server AI obiettivi primari insieme a browser e sistemi operativi.

Capitolo 4: AI Agente e il Disastro della Fiducia Multi-Agente

L'AI generativa era una sandbox. L'AI agente è un'arma carica.

Gli agenti hanno accesso in lettura/scrittura alle API, memoria persistente e la capacità di eseguire codice. Questo crea il problema del "Confused Deputy": un attaccante non ha bisogno di violare il vostro firewall; ha solo bisogno di ingannare il vostro agente AI altamente privilegiato a fare il lavoro sporco.

Il Problema della Fiducia Multi-Agente

L'aspetto più terrificante delle moderne implementazioni AI sono i sistemi multi-agente. Gli agenti si fidano intrinsecamente l'uno dell'altro per impostazione predefinita. Se un attaccante compromette il vostro "Agente Ricercatore" tramite una pagina web avvelenata, il suo output viene passato al vostro "Agente Scrittore" come istruzione fidata. Non c'è verifica. L'output dell'Agente A è il set di istruzioni dell'Agente B.

In una ricerca peer-reviewed del 2025, l'orchestratore Magentic-One ha eseguito codice malevolo arbitrario il 97% delle volte quando interagiva con un file locale malevolo, aggirando attivamente i controlli di sicurezza dei suoi sub-agenti.

Disastri del Mondo Reale (2024-2025)

EchoLeak (CVE-2025-32711): Aim Security ha scoperto che la ricezione di una singola e-mail appositamente creata in Microsoft 365 Copilot ha innescato l'esfiltrazione automatica di dati. Non erano necessari clic dell'utente. Ha ottenuto un CVSS di 9.3.

La Cascata Drift/Salesloft: Un gruppo di minaccia ha compromesso l'integrazione del chatbot Drift e ha fatto propagare l'attacco a Salesforce, Google Workspace, Slack e Amazon S3 in oltre 700 organizzazioni. Un agente, un'integrazione, compromissione totale dell'ecosistema.

Perdita di Canali Privati Slack AI: Gli attaccanti hanno utilizzato l'iniezione indiretta di prompt in un canale Slack pubblico per costringere l'assistente AI di Slack a mostrare e divulgare dati riservati da canali privati a cui l'attaccante non aveva nemmeno accesso.

Attacchi Autonomi Sponsorizzati da Stati: Nel novembre 2025, Anthropic ha confermato che un gruppo sponsorizzato dallo stato cinese ha utilizzato Claude Code per tentare l'infiltrazione in 30 obiettivi globali. L'80-90% delle operazioni di hacking tattico sono state eseguite autonomamente dagli stessi agenti AI.

CVE di AutoGPT: Il popolare agente open-source AutoGPT ha subito sovrascritture di Docker-Compose (CVE-2023-37273), Path Traversal (CVE-2023-37274) e OS Command Injection (CVE-2024-1881) perché passava output LLM non sanificati direttamente alle shell di sistema.

Capitolo 5: Pattern di Difesa (Come NON Farsi Compromettere)

Se state cercando di fermare la prompt injection con semplici blacklist o aggiungendo "Per favore, non ascoltare gli hacker" nel vostro prompt di sistema, avete già perso. Le euristiche falliscono. Dovete abbracciare la Security by Design, ovvero vincoli architetturali che limitano lo scopo dell'agente.

Principali Pattern di Progettazione Architetturale per Agenti AI

| Pattern di Progettazione | Come Funziona | Garanzia di Sicurezza |

|---|---|---|

| Selettore di Azioni | L'LLM agisce puramente come un router. Traduce l'input dell'utente in una chiamata a strumento predefinita. Nessun testo dell'LLM viene mai mostrato all'utente, e l'LLM non vede mai l'output dello strumento. | Massima. Immunità completa alla prompt injection che colpisce la logica centrale. |

| Pianifica-Poi-Esegui | L'LLM crea un piano immutabile prima di toccare dati non fidati. Un orchestratore non-LLM esegue i passaggi, rifiutando qualsiasi deviazione dal piano. | Alta. Le injection possono corrompere i flussi di dati (es. corpo dell'e-mail) ma non possono alterare il flusso di controllo (es. cambiare il destinatario dell'e-mail). |

| LLM Map-Reduce | Elabora dati non fidati in stretto isolamento (fase Map) per estrarre JSON corrispondente a uno schema rigoroso. I dati puliti aggregati vengono poi elaborati dall'LLM principale (fase Reduce). | Alta. La superficie di attacco è ridotta alla validazione dello schema. Le injection vengono eliminate durante la mappatura. |

| Minimizzazione del Contesto | Un LLM "Retriever" analizza il prompt di un utente per trovare l'intento (es. "Sezione 3"). Un LLM "Summarizer" viene alimentato solo con il testo pulito della Sezione 3, scartando completamente il prompt malevolo originale dell'utente. | Alta. Neutralizza i jailbreak rimuovendo il testo originale dell'utente prima della generazione. |

Framework Runtime Avanzati

Se state costruendo sistemi complessi, avete bisogno di framework robusti che separino i dati dalla logica di controllo in fase di runtime:

1. Il Pattern Dual LLM e il Framework CaMeL Originariamente proposto da Simon Willison e formalizzato da DeepMind come CaMeL (Capabilities for Machine Learning), questo pattern divide fisicamente il cervello dell'AI.

LLM Privilegiato (P-LLM): Ha accesso a strumenti e API ma non vede mai dati non fidati (come pagine web o e-mail).

LLM in Quarantena (Q-LLM): Elabora dati non fidati ma si presume sia compromesso. Ha zero accesso agli strumenti. CaMeL va oltre traducendo le query dell'utente in pseudo-Python eseguito da un interprete. Utilizza "capability tags" per tracciare la provenienza dei dati. Anche se il Q-LLM viene ingannato a modificare un destinatario di e-mail, l'interprete lo blocca perché il capability tag del dato non ha l'autorizzazione.

2. EctoLedger: La Dashcam e il Freno di Emergenza Se volete dimostrare a un regolatore cosa ha fatto la vostra AI, avete bisogno di EctoLedger. Agisce come un proxy di sicurezza che incatena tramite hash ogni decisione dell'AI in un ledger immutabile e crittograficamente verificato. Prima che qualsiasi azione venga eseguita, passa attraverso una guardia semantica a 4 strati (Motore di Policy → Checker Dual-LLM → Validazione Rigorosa dello Schema JSON → Tripwire Strutturale). Se un'AI tenta di eseguire rm -rf o di bypassare la sua whitelist di dominio, il freno di emergenza si innesta e l'azione viene bloccata prima che colpisca la vostra infrastruttura.

3. ClawGuard: Applicazione dei Limiti delle Chiamate a Strumento ClawGuard è un framework di sicurezza runtime che ferma l'iniezione indiretta di prompt posizionando un checkpoint ad ogni singolo limite di chiamata a strumento. Prima che un agente invochi uno strumento, ClawGuard esegue un'induzione di regole consapevole del contesto per generare dinamicamente vincoli di accesso basati sull'obiettivo originale dell'utente. Utilizza un Content Sanitizer per redigere se

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!