L'ingegneria inversa incontra la storia dell'hardware

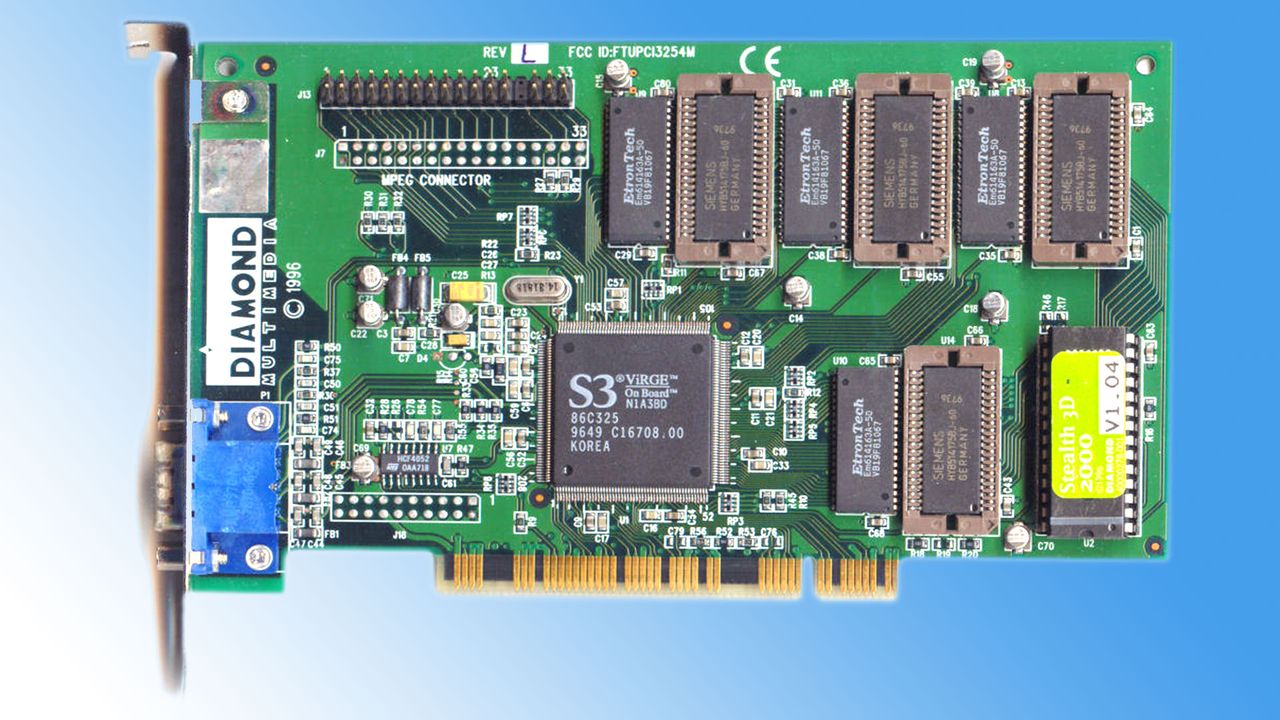

Nel panorama tecnicico odierno, dominato da architetture complesse e astrazioni software, la notizia di un appassionato che risolve un problema hardware trentennale su una scheda grafica S3 Virge offre una prospettiva affascinante. L'intervento ha riguardato una delle prime schede grafiche 3D consumer, la S3 Virge, afflitta da un difetto nei livelli di nero che ne comprometteva la qualità visiva. La soluzione non è arrivata da un aggiornamento software o da un driver, ma da un'operazione di ingegneria inversa sul VBIOS (Video Basic Input/Output System) della scheda stessa.

Questo tipo di risoluzione, che affonda le radici nella modifica diretta del firmware, è un promemoria potente della profondità di controllo che si può esercitare sull'hardware. Per chi opera con infrastrutture critiche, specialmente nel campo dell'intelligenza artificiale, la capacità di intervenire a un livello così basso può rappresentare un vantaggio strategico significativo, garantendo non solo prestazioni ottimali ma anche una maggiore resilienza e sicurezza.

Il dettaglio tecnico del 'pedestal bit'

Il cuore della soluzione risiede nella modifica di quello che è stato definito un 'pedestal bit' all'interno del VBIOS della S3 Virge DX. Il VBIOS è il firmware che inizializza e controlla la scheda grafica al momento dell'avvio del sistema, gestendo parametri fondamentali come le modalità video, le frequenze e, in questo caso, la calibrazione dei livelli di colore e luminosità. Il 'pedestal bit' in questione era responsabile di un'errata impostazione dei livelli di nero, che risultavano troppo alti, compromettendo il contrasto e la fedeltà cromatica dell'immagine.

L'intervento ha richiesto non solo una profonda conoscenza dell'architettura hardware della S3 Virge, ma anche la capacità di disassemblare e modificare il codice binario del VBIOS. Questo approccio, che potremmo definire 'chirurgico', ha permesso di eliminare la causa del problema alla radice, ripristinando i livelli di nero corretti. È un esempio lampante di come la comprensione dettagliata del funzionamento interno dell'hardware possa sbloccare potenzialità e risolvere problemi che altrimenti rimarrebbero irrisolti a livello di driver o sistema operativo.

Implicazioni per i deployment on-premise di LLM

Sebbene il caso della S3 Virge sia legato a un hardware storico, il principio di controllo granulare che esso incarna è estremamente rilevante per le moderne infrastrutture dedicate ai Large Language Models (LLM), specialmente in contesti di deployment on-premise o self-hosted. In questi ambienti, CTO, DevOps lead e architetti infrastrutturali cercano il massimo controllo su ogni componente dello stack, dal silicio al software applicativo.

La capacità di intervenire a livello di firmware, come nel caso del VBIOS, o di ottimizzare i driver e le configurazioni hardware, è cruciale per massimizzare il throughput, minimizzare la latenza e gestire in modo efficiente la VRAM delle GPU. Questo controllo profondo è fondamentale per ottimizzare il Total Cost of Ownership (TCO), garantire la sovranità dei dati in ambienti air-gapped o con stringenti requisiti di compliance, e personalizzare l'infrastruttura per carichi di lavoro AI specifici. A differenza degli ambienti cloud, dove il controllo hardware è spesso limitato, i deployment on-premise offrono la flessibilità necessaria per tali ottimizzazioni. Per chi valuta i trade-off tra cloud e on-premise, AI-RADAR offre framework analitici su /llm-onpremise per supportare decisioni informate.

Oltre la nostalgia: la lezione per l'AI

La storia del fix per la S3 Virge trascende la mera nostalgia per l'hardware vintage. Essa offre una lezione preziosa sull'importanza del controllo e della comprensione profonda dell'infrastruttura sottostante. Per i carichi di lavoro AI, dove le performance sono misurate in tokens al secondo e la memoria GPU è una risorsa preziosa, ogni ottimizzazione a livello hardware, firmware o driver può tradursi in vantaggi significativi in termini di efficienza e costo.

In un'epoca in cui la complessità dei sistemi AI continua a crescere, la capacità di diagnosticare e risolvere problemi a basso livello, o di ottimizzare le prestazioni attraverso modifiche mirate, rimane una competenza inestimabile. Questo approccio 'bare metal' alla gestione dell'infrastruttura è un pilastro per le organizzazioni che mirano a costruire piattaforme AI robuste, sicure e performanti, mantenendo al contempo il pieno controllo sui propri dati e sulle proprie operazioni.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!