L'esplosione dell'AI e la sfida del calore

L'adozione massiva di Large Language Models (LLM) e altre applicazioni di intelligenza artificiale ha generato una domanda senza precedenti di potenza computazionale. Questa esigenza si traduce in un'enorme produzione di calore all'interno dei data center, rendendo il raffreddamento un fattore critico per la stabilità e l'efficienza delle infrastrutture.

In questo scenario, la fonte evidenzia una vera e propria "corsa ai brevetti" nel settore del raffreddamento server. Le aziende taiwanesi, in particolare, si stanno posizionando tra i leader globali in questa competizione, segno della loro centralità nella catena di fornitura tecnicica e della crescente importanza strategica di queste soluzioni.

Il ruolo critico del raffreddamento nell'era AI

Le moderne GPU, come le NVIDIA H100 o A100, sono componenti ad altissima densità di transistor e con consumi energetici elevati, che generano quantità significative di calore. Il calore eccessivo non solo riduce l'efficienza energetica complessiva del data center, ma può anche compromettere la stabilità e la durata dell'hardware, influenzando direttamente il throughput e la latenza dei carichi di lavoro AI.

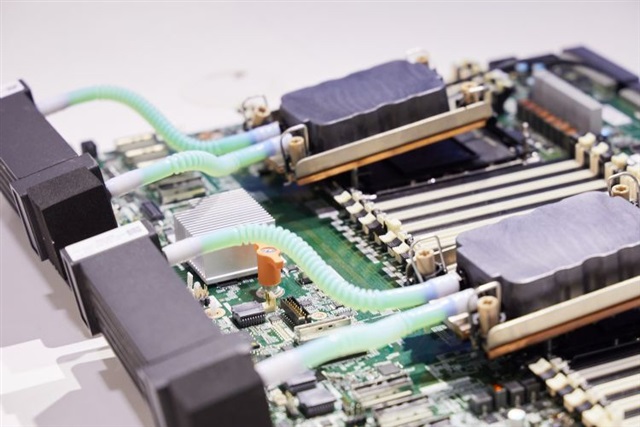

Le soluzioni di raffreddamento ad aria tradizionali faticano sempre più a gestire queste densità di potenza, spingendo verso l'adozione di sistemi più avanzati. Tra questi, il raffreddamento a liquido diretto al chip o l'immersione completa dei server in fluidi dielettrici stanno diventando opzioni sempre più considerate. Queste tecnicie sono fondamentali per mantenere le performance ottimali delle infrastrutture AI e garantire la continuità operativa in ambienti sempre più esigenti.

Implicazioni per i deployment on-premise

Per le organizzazioni che scelgono deployment self-hosted o air-gapped per i loro LLM, la gestione termica diventa un elemento centrale del Total Cost of Ownership (TCO). I costi energetici associati al raffreddamento possono rappresentare una quota significativa delle spese operative, influenzando direttamente la sostenibilità economica dell'infrastruttura.

Un'infrastruttura di raffreddamento efficiente è cruciale per massimizzare la densità dei rack e ottimizzare lo spazio nel data center, aspetti vitali per chi cerca sovranità dei dati e controllo completo sull'hardware. Mentre i provider cloud possono assorbire e distribuire questi costi su larga scala, le realtà on-premise devono affrontare direttamente queste sfide infrastrutturali. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra costi iniziali, operativi e requisiti di raffreddamento.

Prospettive future e innovazione strategica

La leadership delle aziende taiwanesi in questa corsa ai brevetti non sorprende, data la loro posizione centrale nella catena di fornitura globale dell'hardware e la loro esperienza nella produzione di componenti ad alte prestazioni. L'innovazione nel raffreddamento non è solo una questione di efficienza, ma un fattore abilitante per la prossima generazione di hardware AI. Senza soluzioni di raffreddamento adeguate, i progressi nella potenza di calcolo sarebbero limitati dalla fisica.

Questo settore, spesso sottovalutato, è in realtà un pilastro strategico per l'evoluzione dell'intelligenza artificiale. Garantisce che l'infrastruttura possa tenere il passo con le esigenze dei modelli sempre più complessi, assicurando che le promesse dell'AI possano essere mantenute anche a livello di deployment fisico.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!