Il Nuovo Scenario Normativo UE e la Sicurezza AI

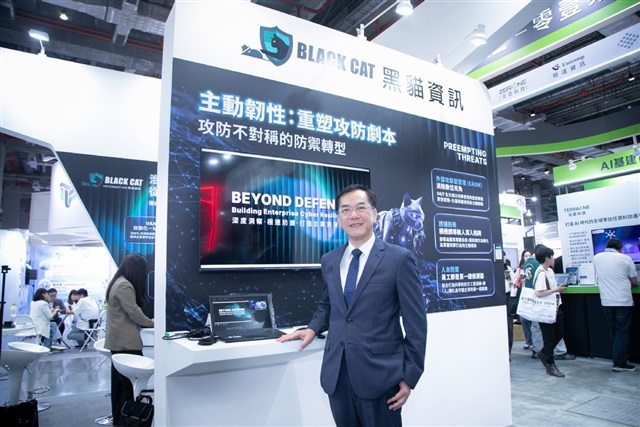

Le nuove normative europee in materia di sicurezza informatica stanno delineando un cambiamento significativo nel modo in cui le organizzazioni approcciano la protezione dei propri asset digitali, in particolare quelli legati all'intelligenza artificiale. Questo framework regolatorio emergente spinge le aziende a superare la fase dell'"AI hype", concentrandosi invece su strategie di difesa più concrete e, soprattutto, guidate dall'intervento umano. Edward Yu, Chief Information Security Officer di Zyxel Group e General Manager di Black Cat Information, ha evidenziato come questa evoluzione stia spostando il focus verso una maggiore responsabilità e un controllo più stringente.

Il passaggio da una fiducia quasi cieca nelle capacità autonome dell'AI a un modello di "human-led defense" non è solo una questione tecnicica, ma strategica. Richiede che le aziende rivedano le proprie pipeline di sviluppo e deployment, integrando controlli umani e processi di verifica robusti. Per i CTO e i responsabili DevOps, ciò significa valutare attentamente come gli LLM e altri sistemi AI vengano integrati nell'infrastruttura, assicurandosi che la sicurezza sia intrinseca e non un ripensamento.

Implicazioni per i Deployment di LLM: Sicurezza e Sovranità dei Dati

L'adozione di Large Language Models (LLM) comporta una serie di sfide intrinseche, specialmente in contesti regolamentati. Le nuove regole cyber UE sottolineano l'importanza della sovranità dei dati e della compliance, aspetti cruciali per le aziende che gestiscono informazioni sensibili. Un approccio di "human-led defense" implica la necessità di garantire che gli operatori umani possano monitorare, intervenire e auditare efficacemente le operazioni degli LLM, mitigando rischi come bias, allucinazioni o fughe di dati.

Per molte organizzazioni, questo si traduce in una crescente preferenza per i deployment self-hosted o in ambienti air-gapped, dove il controllo sui dati e sull'infrastruttura è massimo. Sebbene le soluzioni cloud offrano scalabilità e flessibilità, la gestione della compliance e la garanzia della sovranità dei dati possono diventare complesse. La capacità di mantenere i dati all'interno dei confini nazionali o aziendali, in conformità con normative come il GDPR, diventa un fattore determinante nelle decisioni di deployment, spingendo verso architetture on-premise o ibride che offrono maggiore trasparenza e controllo.

TCO e Trade-off nelle Strategie di Sicurezza AI

La transizione verso un modello di sicurezza AI più robusto e guidato dall'uomo ha implicazioni significative sul Total Cost of Ownership (TCO). Se da un lato l'investimento in tecnicie AI può ridurre i costi operativi a lungo termine, dall'altro la necessità di implementare controlli umani, formazione specifica e processi di audit aggiunge complessità e costi iniziali. Le aziende devono bilanciare l'automazione offerta dagli LLM con la necessità di personale qualificato in grado di supervisionare e gestire i sistemi di sicurezza basati sull'AI.

Le decisioni relative al deployment, che siano on-premise, cloud o ibride, influenzano direttamente il TCO. Un deployment on-premise, ad esempio, può richiedere un CapEx maggiore per l'acquisto di hardware (come GPU con VRAM adeguata per l'inference locale) e per la gestione dell'infrastruttura, ma può offrire un controllo superiore sulla sicurezza e sulla compliance, riducendo potenzialmente i rischi legali e reputazionali. Per chi valuta deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per valutare i trade-off tra costi, performance e requisiti normativi.

Prospettive Future: L'Equilibrio tra Automazione e Controllo Umano

Il futuro della sicurezza nell'era dell'AI risiede in un equilibrio dinamico tra l'efficienza dell'automazione e la saggezza del controllo umano. Le nuove regole cyber UE non mirano a frenare l'innovazione nell'AI, ma a garantire che il suo sviluppo e deployment avvengano in modo responsabile e sicuro. Questo significa che le aziende dovranno investire non solo in tecnicie all'avanguardia, ma anche nello sviluppo di competenze umane per la gestione della sicurezza AI, la data governance e la risposta agli incidenti.

L'integrazione di LLM e altri sistemi AI nelle operazioni aziendali richiederà un approccio olistico che consideri l'interazione tra persone, processi e tecnicia. La "human-led defense" non è un ritorno al passato, ma un'evoluzione che riconosce il ruolo insostituibile dell'intelligenza umana nel navigare le complessità e le incertezze del panorama cyber, specialmente quando si tratta di sistemi autonomi e complessi come gli LLM. La sicurezza non è più solo una funzione IT, ma un pilastro strategico per la continuità e la reputazione aziendale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!