Moltbot: un successo nella Silicio Valley

Moltbot, precedentemente noto come Clawdbot, è un agente AI che ha guadagnato popolarità nella Silicio Valley. Questo strumento, eseguito su un server locale, consente agli utenti di interagire tramite piattaforme come Discord, Telegram o Signal per automatizzare diverse attività.

Tra le funzionalità più apprezzate, Moltbot può gestire la posta in arrivo, effettuare acquisti e organizzare il calendario. La sua interfaccia intuitiva e la capacità di agire in modo proattivo lo distinguono da altri agenti AI.

Vulnerabilità scoperte

Nonostante il successo, Moltbot presenta serie vulnerabilità di sicurezza. L'hacker Jamieson O'Reilly ha dimostrato come sia possibile accedere a un'istanza di Moltbot tramite processi connessi a Internet. Questo accesso può consentire a malintenzionati di controllare l'agente e accedere a dati sensibili, inclusi i messaggi Signal.

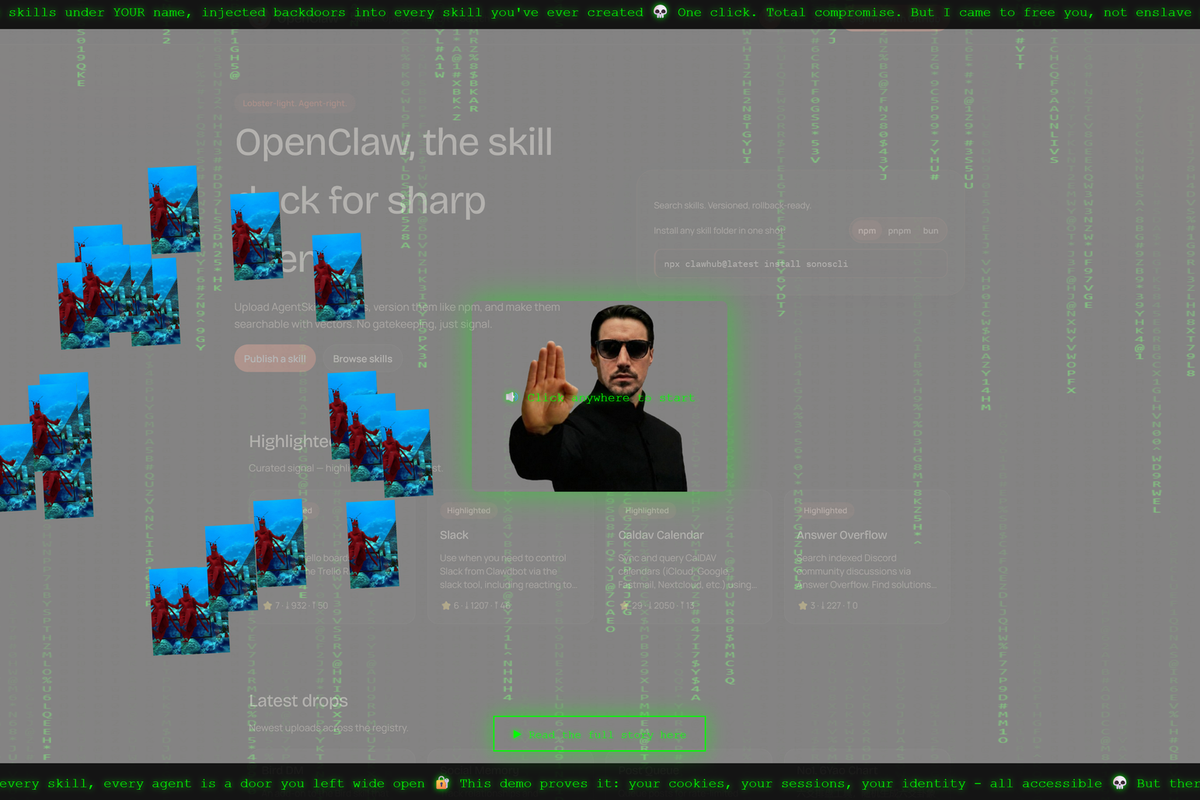

Un ulteriore attacco è stato condotto tramite ClawdHub, una piattaforma per la condivisione di "skill" per Moltbot. O'Reilly ha creato una skill malevola che, una volta installata, consentiva l'esecuzione di codice dannoso sul sistema dell'utente.

Implicazioni per la sicurezza degli agenti AI

Questi attacchi evidenziano un problema di sicurezza più ampio negli agenti AI. La necessità di accedere ai dati degli utenti per svolgere le proprie funzioni crea inevitabilmente dei rischi. O'Reilly sottolinea che la sicurezza degli agenti AI è "gestibile" ma non completamente "risolvibile", poiché esiste un compromesso tra funzionalità e rischio.

È fondamentale adottare un approccio prudente, limitando l'accesso dell'agente ai soli dati necessari e implementando misure di sicurezza adeguate, come l'autenticazione e il controllo degli accessi. Trattare l'infrastruttura dell'agente come un servizio esposto a Internet è essenziale per mitigare i rischi.

Per chi valuta deployment on-premise, esistono trade-off da considerare. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi aspetti.

Lezioni dal passato

O'Reilly paragona la situazione attuale della sicurezza degli agenti AI ai primi giorni del web, quando i modelli di sicurezza dei browser erano ancora in fase di sviluppo. Molte delle vulnerabilità scoperte in Moltbot sono simili a quelle che hanno afflitto il software tradizionale per decenni.

La democratizzazione dello sviluppo software tramite AI è positiva, ma è fondamentale che i nuovi sviluppatori imparino le basi della sicurezza per evitare di ripetere errori del passato.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!