Nvidia accelera il fine vita di alcuni processori Jetson AI per carenza di memoria

Nvidia ha annunciato l'accelerazione del fine vita (End-of-Life, EOL) per alcuni dei suoi processori Jetson AI. La decisione, che ha colto di sorpresa molti operatori del settore, è direttamente collegata a carenze nella catena di approvvigionamento, in particolare per quanto riguarda i moduli di memoria DDR4. Questo sviluppo sottolinea le continue sfide che l'industria tecnicica deve affrontare in termini di disponibilità di componenti critici.

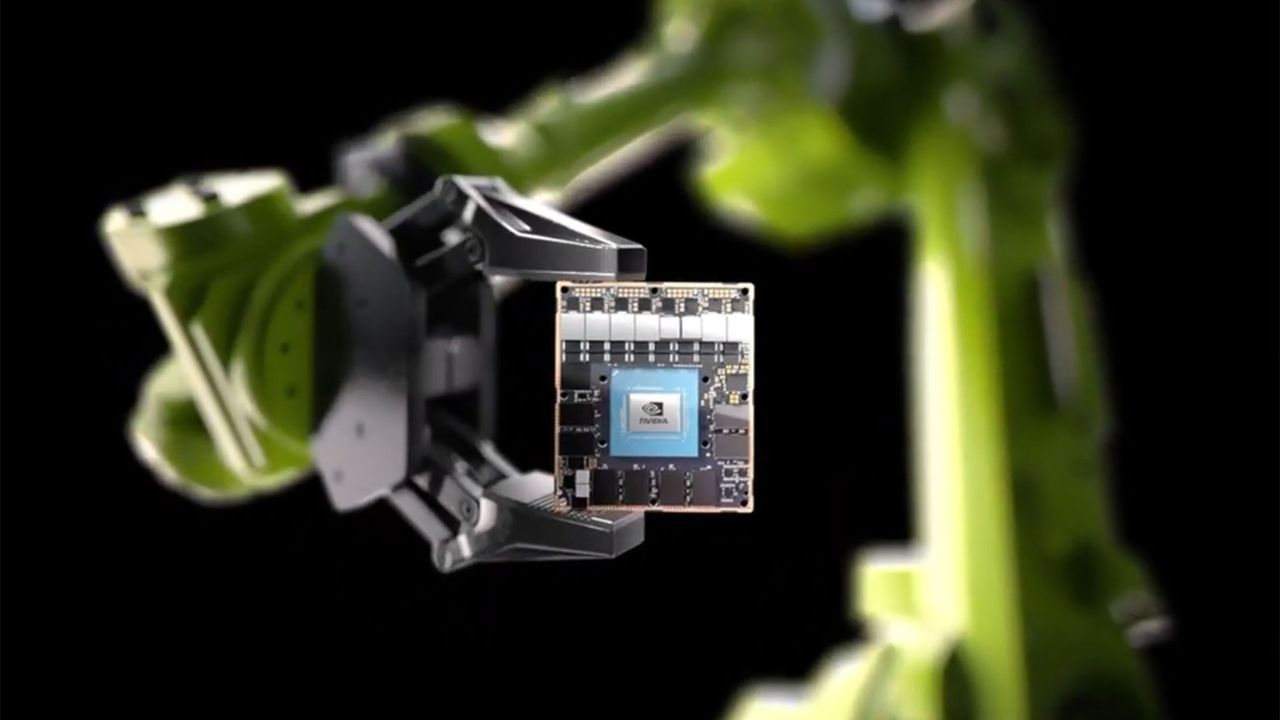

I processori Jetson sono una componente fondamentale per lo sviluppo e il deployment di applicazioni di intelligenza artificiale all'edge, spaziando dalla robotica ai sistemi di visione artificiale, fino ai dispositivi IoT intelligenti. La loro capacità di eseguire carichi di lavoro di inference AI direttamente sul dispositivo, anziché nel cloud, li rende ideali per scenari che richiedono bassa latenza, elevata sicurezza e sovranità dei dati. L'annuncio di Nvidia impatta direttamente i team di ingegneri e i decision-maker che hanno basato le loro architetture su queste piattaforme.

Il ruolo della memoria e le implicazioni tecniche

La memoria DDR4, sebbene ancora ampiamente utilizzata, rappresenta una tecnicia più matura rispetto alle più recenti DDR5 o alle memorie HBM (High Bandwidth Memory) impiegate nelle GPU di fascia alta. Nei sistemi Jetson, la memoria svolge un ruolo cruciale per l'efficienza dei carichi di lavoro AI, influenzando direttamente il throughput e la capacità di gestire modelli complessi. La carenza di questi moduli DDR4 non solo limita la produzione di nuove unità, ma rende anche insostenibile il mantenimento del supporto per le piattaforme esistenti che ne fanno uso.

Per gli architetti di sistema e i responsabili DevOps, la scelta della memoria è un fattore determinante. La VRAM (Video RAM) integrata nelle GPU, o la RAM di sistema condivisa, è essenziale per caricare i modelli, gestire i dati intermedi e supportare le operazioni di inference. Un'accelerazione del fine vita di componenti basati su una specifica tecnicia di memoria può costringere le aziende a rivedere le proprie pipeline di sviluppo e i piani di deployment, con potenziali impatti sui costi e sui tempi di realizzazione dei progetti.

Contesto e implicazioni per il deployment on-premise

Questa situazione evidenzia una vulnerabilità intrinseca nella pianificazione a lungo termine dei deployment hardware, specialmente per le soluzioni self-hosted e on-premise. Le aziende che investono in infrastrutture AI locali, magari in ambienti air-gapped per motivi di sicurezza o compliance, fanno affidamento sulla stabilità e sulla longevità del supporto hardware. L'obsolescenza accelerata di componenti chiave può tradursi in un aumento inatteso del TCO, richiedendo investimenti anticipati in aggiornamenti o la ricerca di piattaforme alternative.

Per CTO e Infrastructure Architects, la gestione del ciclo di vita dei componenti diventa una priorità strategica. La dipendenza da una catena di approvvigionamento globale, soggetta a fluttuazioni e carenze, richiede una pianificazione robusta e la considerazione di strategie di mitigazione del rischio. Questo include la valutazione di fornitori multipli, la standardizzazione su architetture più flessibili o l'adozione di soluzioni che permettano una maggiore agilità nel passaggio tra diverse generazioni di silicio. La sovranità dei dati e la necessità di mantenere il controllo sull'infrastruttura rendono queste decisioni ancora più critiche, poiché la sostituzione forzata di hardware può comportare interruzioni significative.

Prospettive future e strategie di mitigazione

L'annuncio di Nvidia, sebbene specifico per i Jetson basati su DDR4, serve da monito per l'intero ecosistema dell'AI. La volatilità del mercato dei semiconduttori e le sfide della supply chain continueranno a influenzare le decisioni di deployment. Per le organizzazioni che valutano alternative self-hosted vs cloud per carichi di lavoro AI/LLM, è fondamentale integrare nel proprio framework analitico una valutazione approfondita della longevità del supporto hardware e della resilienza della catena di approvvigionamento.

Le strategie di mitigazione possono includere l'adozione di piattaforme con un roadmap di prodotto chiaro e a lungo termine, la diversificazione dei fornitori o l'investimento in soluzioni software-defined che possano astrarre l'hardware sottostante, facilitando la transizione tra diverse generazioni di silicio. La capacità di adattarsi rapidamente ai cambiamenti del mercato hardware sarà un fattore distintivo per le aziende che puntano a mantenere un vantaggio competitivo nel deployment di soluzioni AI all'avanguardia.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!