Nvidia e Nanya: una partnership strategica per i rack AI

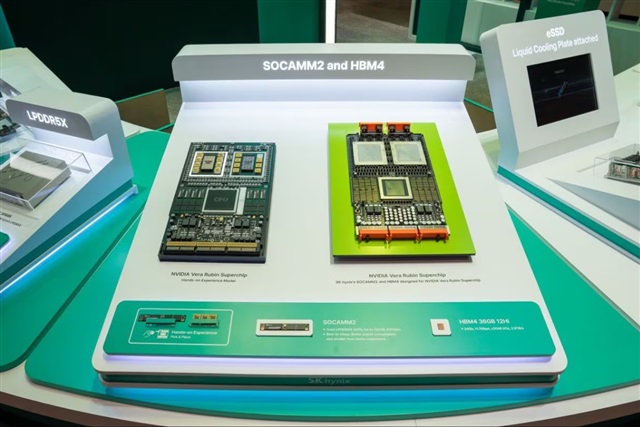

Nvidia, leader indiscusso nel settore delle GPU per l'intelligenza artificiale, ha stretto una collaborazione con Nanya Technology per l'integrazione di soluzioni di memoria avanzate nei suoi rack AI. Questa partnership mira a soddisfare la crescente domanda di capacità di calcolo e, in particolare, di memoria ad alta densità, essenziale per l'addestramento e l'inference di Large Language Models (LLM) e altri carichi di lavoro AI complessi. L'adozione di memoria LPDDR (Low Power Double Data Rate) da parte di Nanya per questi sistemi evidenzia una chiara direzione verso l'efficienza energetica e la compattazione.

La densità di memoria offerta da questa integrazione è notevole, con una capacità per singolo rack che, secondo le stime, equivale a quella di ben 4.500 smartphone. Questo paragone, sebbene analogico, fornisce una chiara indicazione della scala e della quantità di dati che questi rack sono progettati per gestire, un fattore critico per le aziende che sviluppano e implementano soluzioni AI su larga scala.

Il ruolo della memoria LPDDR nei sistemi AI di nuova generazione

La memoria LPDDR è tradizionalmente associata a dispositivi mobili per la sua efficienza energetica e il fattore di forma compatto. La sua integrazione nei rack AI di Nvidia suggerisce un'evoluzione nelle architetture hardware, dove l'ottimizzazione dei consumi e dello spazio diventa sempre più rilevante. Sebbene le GPU di fascia alta si affidino tipicamente a memorie HBM (High Bandwidth Memory) per la loro elevatissima larghezza di banda, l'LPDDR può giocare un ruolo cruciale come memoria di sistema ausiliaria o in configurazioni specifiche dove la densità e l'efficienza sono prioritarie.

Per i carichi di lavoro LLM, la capacità di memoria è un vincolo fondamentale. Modelli sempre più grandi richiedono gigabyte, se non terabyte, di memoria per essere caricati e per gestire finestre di contesto estese. Una maggiore densità di memoria per rack consente di ospitare modelli più grandi o più istanze di modelli, migliorando il throughput complessivo e riducendo la latenza per le applicazioni di inference. Questo è particolarmente vero in scenari dove la parallelizzazione dei dati e dei modelli è essenziale per scalare le operazioni AI.

Implicazioni per i deployment on-premise e il TCO

Per le organizzazioni che valutano deployment on-premise di infrastrutture AI, la scelta della memoria ha un impatto diretto sul Total Cost of Ownership (TCO). Soluzioni come l'LPDDR, che offrono alta densità ed efficienza energetica, possono contribuire a ridurre i costi operativi legati al consumo energetico e al raffreddamento. In un contesto di data center, dove ogni watt e ogni unità di spazio contano, l'ottimizzazione della memoria si traduce in un minor ingombro fisico e in una maggiore sostenibilità ambientale ed economica.

La possibilità di concentrare una maggiore capacità di memoria in un singolo rack offre anche vantaggi in termini di scalabilità e gestione dell'infrastruttura. Le aziende possono raggiungere i requisiti di performance desiderati con un numero inferiore di unità fisiche, semplificando il deployment, la manutenzione e l'espansione. Per chi valuta deployment self-hosted o in ambienti air-gapped, dove la sovranità dei dati e il controllo sull'hardware sono prioritari, l'efficienza e la densità diventano fattori decisivi nella selezione della tecnicia. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off complessi.

Prospettive future e la corsa alla memoria AI

La partnership tra Nvidia e Nanya riflette una tendenza più ampia nel settore dell'AI: la continua ricerca di soluzioni di memoria innovative per supportare l'evoluzione dei modelli e delle applicazioni. Con LLM che crescono esponenzialmente in termini di parametri e requisiti di contesto, la memoria non è più solo un componente passivo, ma un elemento strategico che definisce i limiti delle capacità di calcolo. La capacità di fornire memoria ad alta densità e a basso consumo sarà un fattore critico per i fornitori di hardware AI.

Questa mossa di Nvidia sottolinea come la catena di fornitura e le collaborazioni tecniciche siano fondamentali per affrontare le sfide dell'AI su scala enterprise. L'equilibrio tra performance, efficienza e costo continuerà a guidare le innovazioni nel silicio e nell'architettura dei sistemi, con l'obiettivo di rendere l'AI sempre più accessibile e potente per una vasta gamma di settori industriali.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!