La crescente dipendenza di Nvidia dalle catene di fornitura asiatiche

Nvidia, attore dominante nel panorama dell'intelligenza artificiale, si trova ad affrontare una crescente esposizione alle catene di fornitura asiatiche per i componenti essenziali alla sua produzione. Secondo recenti analisi, ben il 90% dei costi di produzione dell'azienda è ora legato a queste filiere, un incremento notevole rispetto al 65% registrato in precedenza. Questa evoluzione evidenzia una concentrazione sempre maggiore delle operazioni di produzione e assemblaggio in specifiche regioni geografiche, con implicazioni significative per la stabilità dei costi e la disponibilità dei prodotti.

Questa dipendenza non è solo una questione finanziaria, ma tocca aspetti strategici cruciali per l'industria tecnicica globale. La volatilità geopolitica, le interruzioni logistiche e le fluttuazioni economiche in queste aree possono avere un impatto diretto sulla capacità di Nvidia di soddisfare la domanda, influenzando a cascata l'intero ecosistema dell'AI. Per le aziende che pianificano deployment di Large Language Models (LLM) o altre soluzioni AI, comprendere questi fattori è fondamentale per valutare il Total Cost of Ownership (TCO) e la resilienza delle proprie infrastrutture.

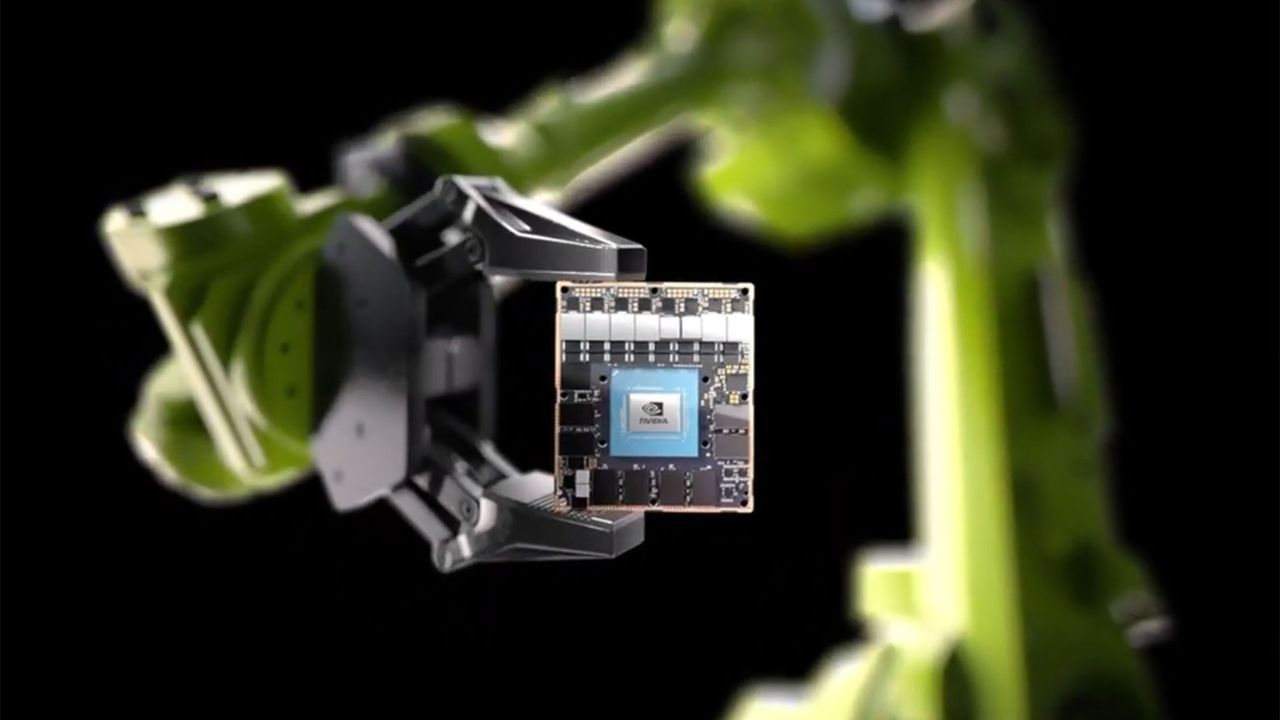

L'impatto dell'AI fisica e la piattaforma Jetson

Il contesto dell'AI fisica, che include applicazioni di robotica, veicoli autonomi e dispositivi IoT intelligenti, è destinato a intensificare ulteriormente questa esposizione. L'AI fisica richiede hardware specializzato per l'inference direttamente sul campo, spesso in ambienti edge. Prodotti come Nvidia Jetson, una piattaforma di computing ad alte prestazioni per l'AI embedded e l'edge, sono al centro di questa trasformazione. Questi sistemi compatti e potenti consentono l'elaborazione dei dati in loco, riducendo la latenza e garantendo una maggiore sovranità dei dati, aspetti cruciali per settori come la manifattura, la logistica e la sanità.

La crescente domanda di soluzioni AI edge, alimentata dalla necessità di elaborare dati in tempo reale e di operare in ambienti disconnessi o air-gapped, rende la disponibilità di piattaforme come Jetson ancora più critica. Le interruzioni nelle catene di fornitura possono ritardare l'innovazione e l'adozione di queste tecnicie, con ripercussioni dirette sulle strategie di digitalizzazione delle imprese. La capacità di un'azienda di sviluppare e rilasciare soluzioni AI fisiche dipende strettamente dalla capacità di approvvigionamento dei componenti hardware necessari.

Considerazioni per i deployment on-premise e edge

Per CTO, DevOps lead e architetti infrastrutturali che valutano deployment on-premise o edge, la dipendenza dalle catene di fornitura di un vendor come Nvidia diventa un fattore chiave nella pianificazione. La resilienza della supply chain influisce direttamente sulla capacità di scalare le operazioni, sulla prevedibilità dei costi e sulla gestione del rischio. Un'elevata esposizione può tradursi in maggiore volatilità dei prezzi per l'hardware, tempi di consegna più lunghi e potenziali carenze di componenti, tutti elementi che possono compromettere il TCO a lungo termine di un'infrastruttura AI self-hosted.

La scelta di architetture on-premise o ibride è spesso motivata dalla ricerca di maggiore controllo, sicurezza e sovranità dei dati. Tuttavia, questi benefici devono essere bilanciati con i rischi legati all'approvvigionamento hardware. La valutazione di alternative, la diversificazione dei fornitori o la progettazione di sistemi con maggiore flessibilità hardware diventano strategie essenziali. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off, aiutando le aziende a prendere decisioni informate sui deployment di LLM e AI in contesti on-premise, considerando non solo le specifiche tecniche ma anche i vincoli di mercato e di fornitura.

Prospettive future e resilienza strategica

L'aumento dell'esposizione di Nvidia alle catene di fornitura asiatiche sottolinea una tendenza più ampia nel settore tecnicico, dove la globalizzazione della produzione si scontra con la crescente necessità di resilienza e sicurezza. Per le aziende che investono in infrastrutture AI, è imperativo adottare una visione strategica che vada oltre le sole specifiche tecniche, includendo un'analisi approfondita dei rischi della supply chain. Questo approccio consente di mitigare potenziali interruzioni e di garantire la continuità operativa dei carichi di lavoro AI critici.

La capacità di anticipare e gestire questi rischi sarà un differenziatore chiave per le imprese che mirano a costruire e mantenere un vantaggio competitivo nell'era dell'AI. La pianificazione di deployment on-premise o edge deve quindi considerare non solo le performance e i costi immediati, ma anche la robustezza dell'intera catena di valore, dalla produzione dei chip al rilascio finale del sistema. La resilienza della supply chain diventa così un pilastro fondamentale per la sostenibilità e l'efficacia delle strategie AI a lungo termine.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!