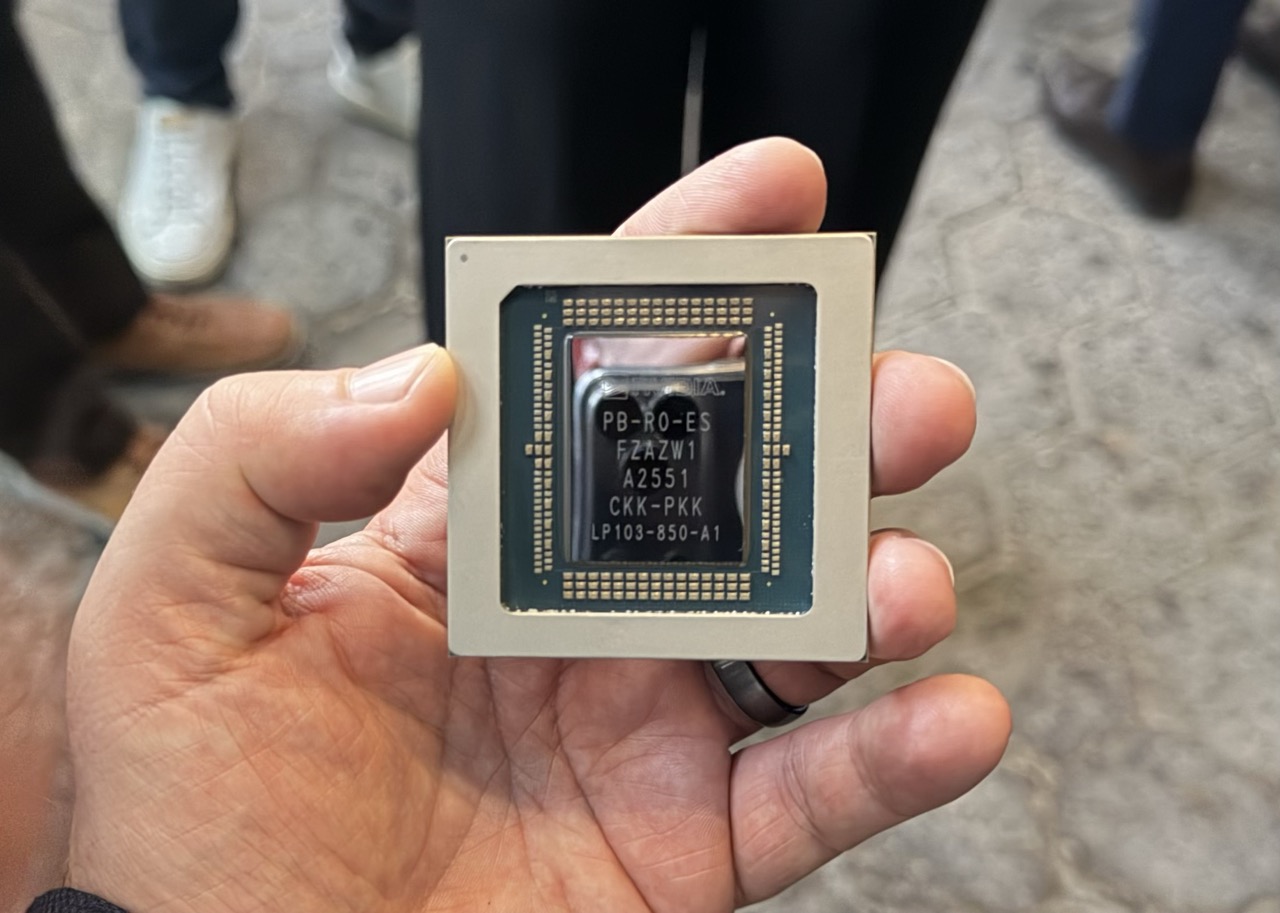

NVIDIA sta per integrare le LPU (Language Processing Units) di Groq, acquisita di recente, nella sua prossima architettura rackscale Vera Rubin. Questa integrazione segna un'importante evoluzione, estendendo le capacità di inference AI oltre le tradizionali GPU.

Vera Rubin: un nuovo approccio all'inference

La piattaforma Vera Rubin è progettata per ottimizzare l'inference AI, con un focus particolare sulla riduzione della latenza. L'aggiunta delle LPU di Groq mira a migliorare le prestazioni in scenari dove la velocità di risposta è critica. Per chi valuta deployment on-premise, esistono trade-off da considerare attentamente; AI-RADAR offre framework analitici su /llm-onpremise per valutare questi aspetti.

Implicazioni per il mercato

L'integrazione di diverse tipologie di processori (GPU e LPU) in un'unica piattaforma potrebbe rappresentare un cambio di paradigma nel modo in cui vengono progettate le infrastrutture per l'inference AI. Resta da vedere come questa mossa influenzerà la competizione nel settore e quali vantaggi concreti porterà agli utenti finali in termini di TCO e performance.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!