Nvidia Vera Rubin: la roadmap si chiarisce per il 2026

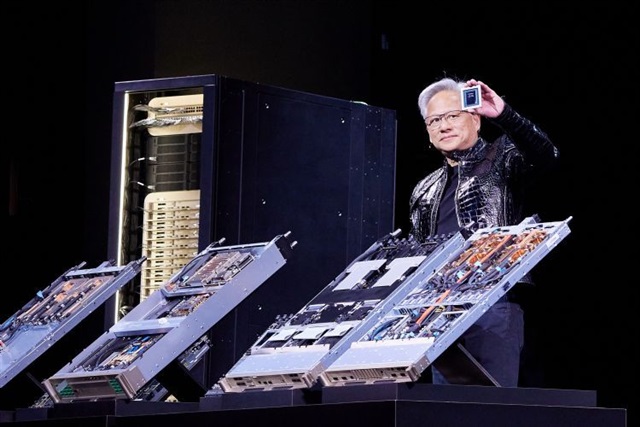

Nvidia, attore dominante nel panorama dell'hardware per l'intelligenza artificiale, avrebbe risolto le problematiche che affliggevano la sua prossima piattaforma, nome in codice Vera Rubin. Secondo quanto riportato da DIGITIMES, la filiera produttiva sta ora puntando a un'accelerazione delle consegne nel terzo trimestre del 2026. Questa notizia è di particolare rilevanza per le aziende e le organizzazioni che dipendono dalle soluzioni Nvidia per i loro carichi di lavoro AI, in quanto fornisce una maggiore chiarezza sulla disponibilità futura di hardware di nuova generazione.

La tempistica di rilascio e la capacità produttiva di nuove GPU sono fattori critici per la pianificazione strategica, specialmente per chi valuta deployment on-premise di Large Language Models (LLM) e altre applicazioni di intelligenza artificiale. La disponibilità di silicio avanzato influenza direttamente la capacità di implementare soluzioni AI con prestazioni elevate, efficienza energetica ottimizzata e un controllo granulare sui dati.

Il contesto tecnicico e le aspettative

La piattaforma Vera Rubin è attesa come la successiva evoluzione dopo le architetture Hopper (H100) e Blackwell (B100/B200), rappresentando il prossimo salto generazionale nelle GPU di Nvidia. Ogni nuova generazione porta con sé miglioramenti significativi in termini di potenza di calcolo, capacità di VRAM e throughput, elementi fondamentali per l'addestramento e l'inference di LLM sempre più complessi. Questi progressi sono essenziali per gestire modelli con miliardi di parametri e finestre di contesto estese, riducendo al contempo la latenza e aumentando il numero di token elaborati per secondo.

Per le infrastrutture self-hosted, l'adozione di hardware di ultima generazione può tradursi in un TCO più favorevole nel lungo periodo, grazie a una maggiore efficienza energetica e a una densità di calcolo superiore per rack unit. La risoluzione dei problemi e la successiva rampa produttiva indicano che Nvidia è in linea con la sua roadmap, fornendo un segnale positivo al mercato e consentendo alle aziende di allineare le proprie strategie di investimento in infrastruttura AI.

Implicazioni per i deployment on-premise e la sovranità dei dati

La disponibilità di nuove generazioni di GPU come Vera Rubin è un fattore determinante per le organizzazioni che privilegiano i deployment on-premise. La possibilità di accedere a hardware all'avanguardia consente di mantenere il controllo completo sui dati e sui modelli, un aspetto cruciale per la sovranità dei dati, la compliance normativa (come il GDPR) e la sicurezza in ambienti air-gapped. Le aziende possono così evitare le dipendenze dai fornitori di servizi cloud, che possono comportare costi operativi variabili e potenziali vincoli sulla localizzazione dei dati.

Per chi valuta deployment on-premise, la certezza sulla roadmap hardware permette una pianificazione più accurata degli investimenti CapEx e OpEx. La scelta tra soluzioni cloud e self-hosted spesso si riduce a un'analisi approfondita del TCO, che include non solo il costo iniziale dell'hardware, ma anche i costi energetici, di raffreddamento, di manutenzione e del personale specializzato. La maggiore efficienza delle nuove GPU può spostare l'ago della bilancia a favore delle soluzioni on-premise per carichi di lavoro intensivi e a lungo termine. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off, fornendo strumenti per decisioni informate.

Prospettive future e pianificazione strategica

L'annuncio della risoluzione dei problemi e la previsione di una rampa produttiva per Vera Rubin nel terzo trimestre del 2026 offrono alle aziende un orizzonte temporale più definito per l'aggiornamento delle proprie infrastrutture AI. Questo permette ai CTO, ai responsabili DevOps e agli architetti di infrastruttura di iniziare a valutare come integrare questa nuova tecnicia nelle loro pipeline esistenti, considerando fattori come l'aggiornamento dei data center, la capacità di alimentazione e raffreddamento, e la compatibilità con i framework software attuali.

Monitorare attentamente la roadmap di Nvidia e le dinamiche della supply chain è fondamentale per anticipare le opportunità e i vincoli. La disponibilità di hardware potente e affidabile è la base per innovare con l'AI, garantendo che le decisioni di deployment supportino gli obiettivi di business a lungo termine, dalla ricerca e sviluppo alla produzione su larga scala. La chiarezza sulla tempistica di Vera Rubin è un passo importante in questa direzione, fornendo un punto di riferimento per le future strategie di investimento in AI.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!