L'iniziativa congiunta per accelerare l'addestramento AI

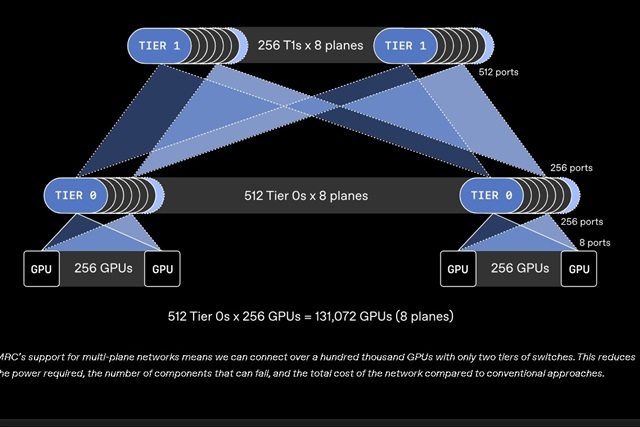

OpenAI, in collaborazione con i principali produttori di silicio, ha annunciato l'introduzione di una nuova iniziativa, denominata MRC, pensata per affrontare e prevenire i rallentamenti che possono compromettere l'efficienza dei processi di addestramento dei modelli di intelligenza artificiale. Questa partnership strategica evidenzia la crescente consapevolezza che l'avanzamento dell'AI non dipende solo dagli algoritmi e dai dati, ma anche dalla capacità dell'infrastruttura sottostante di supportare carichi di lavoro sempre più intensi e complessi.

L'addestramento di Large Language Models (LLM) e di altri modelli AI su larga scala richiede risorse computazionali immense. I rallentamenti possono derivare da colli di bottiglia a vari livelli, dalla larghezza di banda della memoria delle GPU alla latenza nella comunicazione tra i nodi di un cluster. L'obiettivo di MRC è proprio quello di identificare e risolvere queste inefficienze, garantendo che le risorse hardware siano utilizzate al massimo delle loro potenzialità.

Le sfide tecniche dell'addestramento su larga scala

L'addestramento di modelli AI all'avanguardia è un'impresa tecnicamente ardua. Le GPU moderne, pur essendo estremamente potenti, devono gestire volumi di dati e parametri che spesso superano le capacità della VRAM disponibile o la velocità di trasferimento dati tra i vari componenti. Questo porta a situazioni in cui le unità di calcolo rimangono inattive in attesa dei dati, riducendo drasticamente il throughput complessivo e prolungando i tempi di addestramento.

Problematiche come la gestione della memoria, l'ottimizzazione delle pipeline di dati e la sincronizzazione tra migliaia di core di processori sono all'ordine del giorno. Soluzioni che migliorano l'efficienza a livello di chip e di sistema sono fondamentali per sbloccare il potenziale dei modelli di prossima generazione. L'iniziativa MRC si posiziona proprio in questo contesto, cercando di affinare l'interazione tra software e hardware per superare questi limiti strutturali.

Implicazioni per i deployment on-premise

Per le organizzazioni che scelgono deployment self-hosted per i loro carichi di lavoro AI, iniziative come MRC assumono un'importanza ancora maggiore. La capacità di prevenire i rallentamenti nell'addestramento si traduce direttamente in un miglioramento del Total Cost of Ownership (TCO) e in un utilizzo più efficiente delle costose risorse hardware acquisite. In un ambiente on-premise, ogni ciclo di clock della GPU e ogni byte di VRAM contano, poiché l'investimento iniziale in infrastruttura è significativo.

La sovranità dei dati, la compliance normativa e la necessità di operare in ambienti air-gapped sono spesso i motori che spingono verso soluzioni self-hosted. Tuttavia, queste scelte richiedono un'ottimizzazione meticolosa dell'intera pipeline di addestramento e inference. Strumenti e standard che emergono da collaborazioni come quella tra OpenAI e i produttori di chip possono fornire le basi per costruire stack locali più performanti e resilienti, massimizzando il ritorno sull'investimento e garantendo il controllo completo sull'infrastruttura AI. Per chi valuta i trade-off dei deployment on-premise, AI-RADAR offre framework analitici su /llm-onpremise per approfondire queste considerazioni.

Prospettive future e la sinergia hardware-software

La collaborazione tra sviluppatori di modelli AI come OpenAI e i giganti del silicio è un segnale chiaro della direzione che sta prendendo l'industria. L'ottimizzazione non è più un compito esclusivo del software o dell'hardware, ma richiede una sinergia profonda tra i due. Soluzioni come MRC mirano a creare un ecosistema più coeso, dove le innovazioni a livello di chip possono essere pienamente sfruttate dagli algoritmi più avanzati.

Questo approccio integrato è essenziale per superare le barriere attuali e future nell'addestramento di modelli AI sempre più grandi e capaci. Indipendentemente dal fatto che un'azienda scelga di operare nel cloud o con un'infrastruttura bare metal, l'efficienza nell'addestramento rimane un fattore critico per l'innovazione e la competitività. L'iniziativa MRC rappresenta un passo significativo verso un futuro in cui i rallentamenti non saranno più un ostacolo insormontabile per l'evoluzione dell'intelligenza artificiale.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!