La sfida dei costi della memoria nell'era dell'AI

L'espansione esponenziale dei Large Language Models (LLM) e di altre applicazioni di intelligenza artificiale ha portato a un aumento significativo della domanda di risorse hardware, in particolare per quanto riguarda la memoria ad alte prestazioni. La VRAM delle GPU, essenziale per l'addestramento e l'Inference di modelli complessi, rappresenta una delle voci di costo più rilevanti nell'infrastruttura AI. Questo scenario pone le organizzazioni di fronte a scelte strategiche complesse, soprattutto per chi valuta deployment self-hosted o ibridi, dove il Total Cost of Ownership (TCO) è un fattore determinante.

In questo contesto, emerge l'esigenza di soluzioni innovative che permettano di "contrastare" l'escalation dei prezzi della memoria, garantendo al contempo le performance necessarie. Un recente progetto si è proposto proprio questo obiettivo: sfruttare l'intelligenza artificiale stessa come strumento per ottimizzare l'utilizzo e la gestione della memoria, offrendo un approccio replicabile per le aziende.

L'AI come strumento di ottimizzazione della memoria

L'idea centrale di questo progetto è ingegnosa: utilizzare l'AI per risolvere un problema generato dall'AI stessa. Sebbene i dettagli specifici della metodologia non siano stati divulgati, è possibile ipotizzare diverse strategie che un'AI potrebbe impiegare per ottimizzare i costi della memoria. Queste includono tecniche avanzate di Quantization dei modelli, che riducono la precisione numerica dei pesi per diminuire l'ingombro in VRAM senza compromettere eccessivamente l'accuratezza.

Un'altra via potrebbe essere l'implementazione di algoritmi di scheduling intelligenti, capaci di allocare dinamicamente le risorse di memoria in base al carico di lavoro e alle priorità, minimizzando gli sprechi. L'AI potrebbe anche essere utilizzata per identificare e applicare tecniche di compressione dei dati o per ottimizzare le pipeline di elaborazione, garantendo che i dati risiedano in memoria solo quando strettamente necessario. Questi approcci sono cruciali per massimizzare l'efficienza delle costose GPU e della loro VRAM, specialmente in ambienti con risorse limitate o con requisiti di Throughput elevati.

Contesto e implicazioni per i deployment on-premise

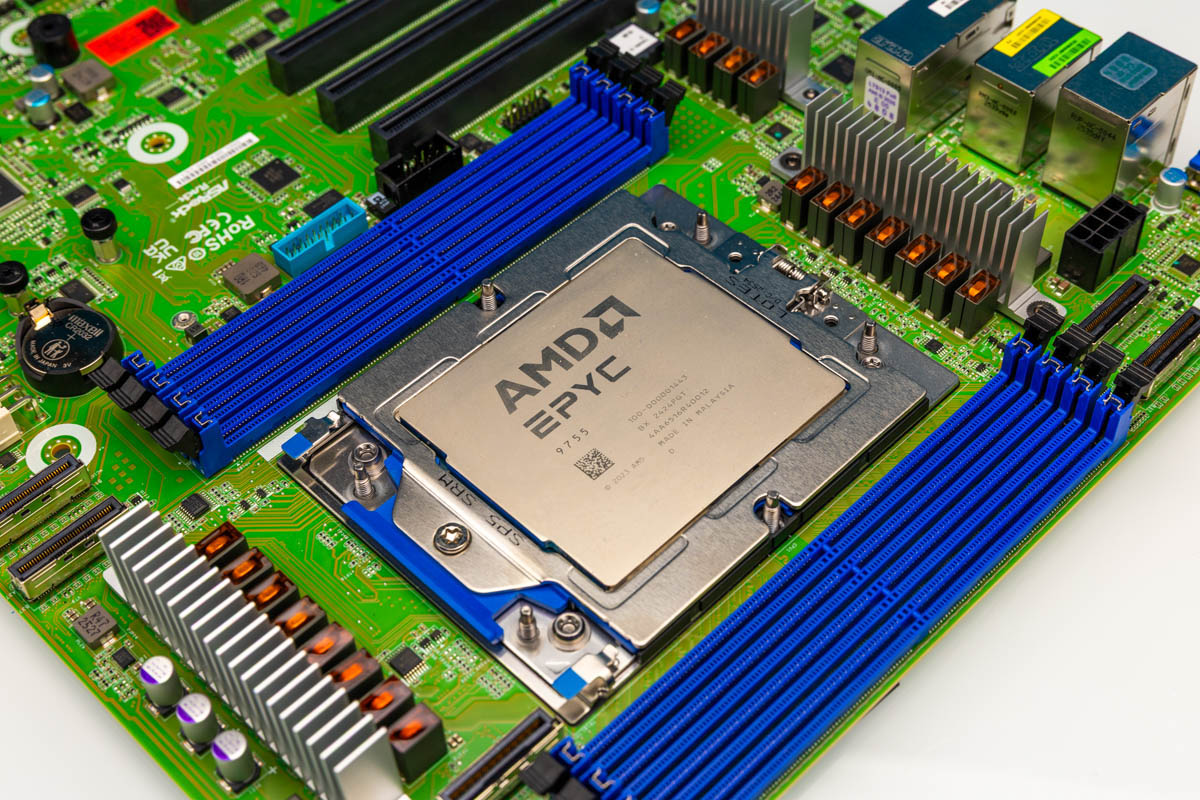

L'iniziativa assume particolare rilevanza per le organizzazioni che privilegiano deployment on-premise o air-gapped. In questi scenari, il controllo diretto sull'hardware e sul software è fondamentale per garantire la sovranità dei dati, la compliance normativa e la sicurezza. Tuttavia, l'investimento iniziale (CapEx) in GPU ad alta VRAM può essere proibitivo. Ottimizzare l'uso della memoria significa estendere la vita utile dell'hardware esistente e ridurre la necessità di acquisti futuri, impattando positivamente sul TCO complessivo.

La capacità di replicare queste metodologie all'interno della propria organizzazione offre un vantaggio competitivo significativo. Permette alle aziende di mantenere il controllo sui propri stack tecnicici, evitando la dipendenza da servizi cloud esterni e le relative fluttuazioni di costo. Per chi valuta i trade-off tra soluzioni self-hosted e cloud, AI-RADAR offre framework analitici su /llm-onpremise per supportare decisioni informate, evidenziando come l'efficienza della memoria sia un pilastro per un'infrastruttura AI sostenibile.

Prospettive future e autonomia tecnicica

Questo approccio, che vede l'AI come parte della soluzione ai propri stessi vincoli infrastrutturali, apre nuove prospettive per l'autonomia tecnicica delle imprese. Riducendo la barriera economica rappresentata dai costi della memoria, un numero maggiore di organizzazioni potrà implementare e gestire i propri carichi di lavoro AI in modo efficiente e controllato.

L'obiettivo finale è democratizzare l'accesso a potenti capacità di intelligenza artificiale, rendendole più accessibili e gestibili anche per realtà con budget e risorse hardware più contenuti. La condivisione di metodologie replicabili è un passo fondamentale verso un ecosistema AI più resiliente e meno dipendente dalle dinamiche di prezzo del mercato hardware, promuovendo l'innovazione e la sovranità tecnicica.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!