L'espansione della costellazione Pelican

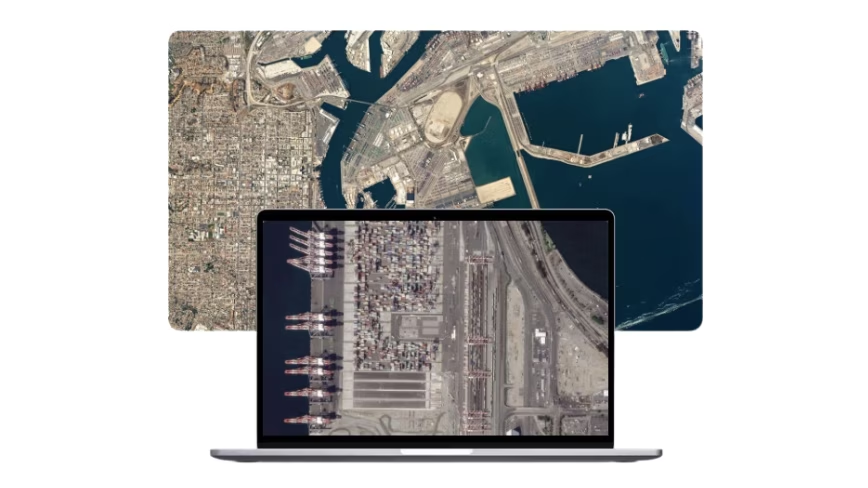

Il 3 maggio, un razzo SpaceX Falcon 9 è decollato dalla Vandenberg Space Force Base, portando in orbita un carico di 45 satelliti. Tra questi, tre nuovi veicoli spaziali di Planet Labs, denominati Pelicans 7, 8 e 9, segnano un'ulteriore espansione della costellazione di nuova generazione dell'azienda. Con questi lanci, la flotta Pelican raggiunge un totale di nove satelliti dedicati all'osservazione terrestre ad alta risoluzione.

Questa espansione rafforza la capacità di Planet Labs di offrire un servizio che va oltre la semplice fornitura di immagini satellitari statiche. L'azienda si concentra sulla vendita di un abbonamento che permette di monitorare i cambiamenti dell'intero pianeta in tempo reale, una proposta che trasforma radicalmente l'approccio all'analisi geospaziale e alla rilevazione di eventi su scala globale.

Le sfide dell'elaborazione di dati geospaziali su larga scala

L'ambizione di monitorare il pianeta in tempo reale genera un flusso continuo di dati di dimensioni colossali. La gestione, l'archiviazione e l'analisi di petabyte di immagini satellitari ad alta risoluzione rappresentano una sfida infrastrutturale significativa per qualsiasi organizzazione. Questo scenario richiede pipeline di dati estremamente robuste e capacità computazionali avanzate per estrarre informazioni utili, come la rilevazione di cambiamenti ambientali, l'identificazione di pattern urbani o il monitoraggio di infrastrutture critiche.

L'applicazione di modelli di intelligenza artificiale, inclusi i Large Language Models (LLM) o modelli di visione artificiale, è fondamentale per trasformare questi dati grezzi in insight azionabili. Tuttavia, l'esecuzione di inference su tali volumi di dati, spesso con requisiti di bassa latenza, impone requisiti stringenti sull'hardware sottostante, dalla VRAM delle GPU alle capacità di throughput della rete e dello storage.

Implicazioni per il deployment infrastrutturale e la sovranità dei dati

Per le aziende e le agenzie governative che si affidano a questi dati per decisioni strategiche, la scelta del deployment infrastrutturale diventa cruciale. L'elaborazione di dati sensibili o proprietari, come quelli derivanti dall'osservazione terrestre, spesso richiede un controllo rigoroso sull'ambiente computazionale. In questo contesto, le soluzioni self-hosted o on-premise, inclusi i deployment bare metal o air-gapped, offrono vantaggi in termini di sovranità dei dati, compliance normativa e sicurezza.

Sebbene il cloud offra scalabilità e flessibilità, il Total Cost of Ownership (TCO) a lungo termine e le preoccupazioni relative alla residenza dei dati possono spingere verso alternative ibride o completamente locali. La valutazione di questi trade-off è complessa e deve considerare non solo i costi diretti, ma anche i requisiti di latenza, la necessità di personalizzare l'hardware per carichi di lavoro specifici e la capacità di mantenere il controllo completo sulla catena di elaborazione dei dati.

Prospettive future e decisioni strategiche

L'evoluzione dei servizi di osservazione terrestre, come quelli offerti da Planet Labs, sottolinea una tendenza crescente verso l'analisi predittiva e il monitoraggio proattivo basato su dati in tempo quasi reale. Questo scenario impone ai decision-maker tecnici, come CTO e architetti di infrastruttura, di riconsiderare le proprie strategie di deployment per i carichi di lavoro AI/LLM.

La capacità di gestire e analizzare efficacemente questi flussi di dati massivi, mantenendo al contempo la sicurezza e la conformità, sarà un fattore distintivo. La scelta tra un'infrastruttura cloud, on-premise o ibrida non è mai banale e richiede un'analisi approfondita dei vincoli specifici del business, delle esigenze di performance e degli obiettivi di controllo sui dati. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off, supportando le organizzazioni nella definizione della strategia più adatta.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!