Spotify e la Nuova Era della Verifica per gli Artisti

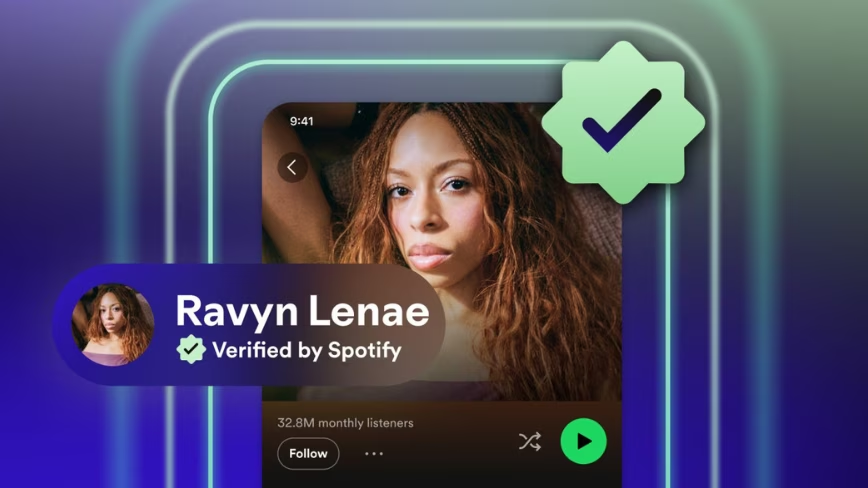

Spotify ha annunciato l'introduzione di un badge di verifica per gli artisti, un'iniziativa che mira a rafforzare l'autenticità e la fiducia all'interno della sua vasta piattaforma musicale. Il badge, rappresentato da un segno di spunta verde, apparirà sui profili degli artisti e accanto ai loro nomi, segnalando agli utenti la loro identità verificata. Questo rollout avverrà nelle prossime settimane, segnando un passo importante nella gestione dell'identità digitale nel settore della musica in streaming.

Per ottenere questo riconoscimento, gli artisti dovranno soddisfare criteri specifici. Tra questi, un coinvolgimento costante con la propria base di ascoltatori, la piena conformità alle politiche della piattaforma e, aspetto cruciale, una presenza identificabile nel mondo reale. Questi requisiti sottolineano l'intento di Spotify di garantire che il badge sia un vero indicatore di autenticità e non un semplice simbolo estetico.

L'Esclusione dell'AI Generativa e le Sue Implicazioni

Un aspetto particolarmente rilevante di questa iniziativa è l'esplicita esclusione delle 'content farm' e dei profili di artisti generati interamente da intelligenza artificiale. Questa decisione di Spotify evidenzia una crescente preoccupazione nel settore digitale riguardo alla provenienza e all'autenticità dei contenuti nell'era dell'AI generativa. Man mano che gli LLM e altri modelli di intelligenza artificiale diventano sempre più sofisticati nella creazione di musica, testi e persino intere identità artistiche, la distinzione tra ciò che è umano e ciò che è artificiale si fa più labile.

Per le aziende e gli operatori IT che gestiscono grandi volumi di dati, questa tendenza solleva interrogativi fondamentali sulla governance dei dati e sulla sovranità. La capacità di verificare l'origine di un contenuto, sia esso musicale, testuale o di altro tipo, diventa essenziale per la compliance, la sicurezza e la costruzione della fiducia. L'esclusione di Spotify riflette una necessità più ampia di stabilire chiari confini e meccanismi di verifica in un ecosistema digitale sempre più permeato dall'AI.

Governance dei Dati e Sovranità nell'Era dell'AI

La decisione di Spotify, sebbene specifica per il settore musicale, risuona con le sfide che molte organizzazioni affrontano nella gestione dei dati generati o influenzati dall'AI. Per i CTO, i responsabili DevOps e gli architetti di infrastruttura, la questione della provenienza dei dati è critica. In ambienti con requisiti stringenti di compliance o in contesti air-gapped, la capacità di tracciare e verificare l'origine di ogni informazione è fondamentale per mantenere la sovranità dei dati e la conformità normativa.

L'implementazione di framework robusti per la governance dei dati, che includano la verifica dell'autenticità e la gestione della provenienza, è un investimento strategico. Questo può implicare lo sviluppo di pipeline di dati self-hosted, l'adozione di soluzioni on-premise per il processing e l'archiviazione, o l'integrazione di sistemi di auditing avanzati. La scelta tra deployment cloud e on-premise, in questo contesto, è spesso guidata dalla necessità di un controllo granulare sui dati e sui processi di verifica, specialmente quando si tratta di contenuti sensibili o di proprietà intellettuale.

Prospettive Future e i Trade-off della Verifica Digitale

L'iniziativa di Spotify è un chiaro segnale di come le piattaforme stiano reagendo alla proliferazione di contenuti generati dall'AI. Tuttavia, la sfida di distinguere l'autentico dall'artificiale è in continua evoluzione. Man mano che i modelli di AI migliorano, anche i metodi di verifica dovranno adattarsi, richiedendo un'innovazione costante sia a livello di piattaforma che di infrastruttura sottostante.

Per le organizzazioni che operano con LLM e carichi di lavoro AI, la gestione di questi trade-off è cruciale. Da un lato, l'efficienza e la scalabilità offerte dalle soluzioni cloud possono essere attraenti. Dall'altro, il controllo, la sicurezza e la sovranità dei dati garantiti da un deployment on-premise o ibrido diventano prioritari quando la provenienza e l'autenticità dei contenuti sono in gioco. AI-RADAR offre framework analitici su /llm-onpremise per valutare questi trade-off, supportando le decisioni strategiche su dove e come gestire i carichi di lavoro AI in modo sicuro e conforme.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!