La Valutazione Volontaria dei Modelli AI negli USA: Un Primo Passo Verso la Governance

Il Dipartimento del Commercio statunitense ha recentemente annunciato un'iniziativa significativa nel panorama della governance dell'intelligenza artificiale. Cinque importanti laboratori di ricerca nel campo dell'AI, tra cui giganti come Google, Microsoft e xAI, hanno accettato di sottoporre i loro modelli più avanzati a una valutazione da parte del governo prima del loro rilascio pubblico. Questa collaborazione, sebbene di natura volontaria e priva di una base legale formale, rappresenta il tentativo più concreto degli Stati Uniti di stabilire una forma di supervisione sui sistemi di intelligenza artificiale.

L'accordo nasce dalla crescente consapevolezza dei potenziali rischi che modelli di AI estremamente potenti possono rappresentare per la sicurezza nazionale. La cosiddetta "crisi Mythos" – un evento non specificato ma che ha evidentemente sollevato preoccupazioni concrete – ha costretto l'amministrazione a confrontarsi con la questione cruciale: come valutare efficacemente un modello di AI prima che diventi accessibile al pubblico, specialmente quando le sue capacità potrebbero avere implicazioni strategiche? La mancanza di un meccanismo formale di valutazione ha spinto verso questa soluzione pragmatica, seppur informale.

Le Sfide della Valutazione dei Large Language Models

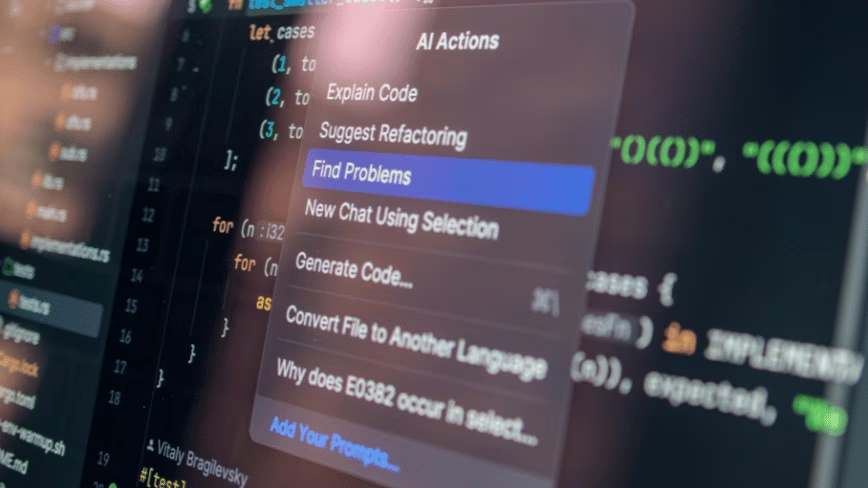

La valutazione dei Large Language Models (LLM) e di altri sistemi AI avanzati presenta complessità intrinseche che vanno oltre i tradizionali benchmark di performance. Questi modelli, soprattutto quelli di ultima generazione, possono esibire comportamenti emergenti imprevedibili, generare contenuti potenzialmente dannosi o manipolativi, o essere suscettibili a vulnerabilità che potrebbero essere sfruttate. Per le organizzazioni che considerano il deployment di LLM in ambienti self-hosted o air-gapped, la capacità di condurre una valutazione interna rigorosa è fondamentale per garantire la compliance, la sicurezza dei dati e la sovranità delle informazioni.

La sfida non risiede solo nell'identificare le capacità del modello, ma anche nel comprenderne i limiti e i potenziali bias. Questo richiede pipeline di test sofisticate, che spesso simulano scenari d'uso reali e mettono alla prova il modello in condizioni estreme. L'attenzione si sposta dalla semplice accuratezza alla robustezza, alla sicurezza e all'etica, aspetti cruciali per qualsiasi deployment enterprise, sia esso on-premise o in cloud. La necessità di comprendere a fondo come un modello si comporta prima del suo rilascio è un requisito condiviso sia dai governi che dalle aziende che operano in settori regolamentati.

Implicazioni per la Sovranità dei Dati e il Deployment On-Premise

L'iniziativa statunitense, pur essendo un accordo governativo, solleva questioni rilevanti per le aziende che gestiscono carichi di lavoro AI. La possibilità che un'entità esterna valuti un modello prima del rilascio evidenzia la crescente importanza della fiducia e della trasparenza. Per le organizzazioni che privilegiano la sovranità dei dati e il controllo completo sull'infrastruttura, come quelle che optano per soluzioni self-hosted o bare metal, la capacità di replicare e superare tali processi di valutazione internamente diventa un fattore critico.

La decisione di deploy un LLM on-premise è spesso guidata dalla necessità di mantenere i dati sensibili all'interno dei propri confini infrastrutturali, rispettando normative come il GDPR o requisiti specifici di settori come la finanza o la sanità. In questo contesto, la valutazione pre-deployment non riguarda solo la sicurezza funzionale, ma anche la conformità normativa e la resistenza a potenziali attacchi o manipolazioni. La comprensione dei trade-off tra l'adozione rapida di modelli innovativi e la necessità di una valutazione approfondita è essenziale per i CTO e gli architetti di infrastruttura. AI-RADAR, ad esempio, offre framework analitici su /llm-onpremise per supportare la valutazione di questi trade-off in contesti di deployment on-premise.

Prospettive Future della Governance AI

Questa mossa del Dipartimento del Commercio, sebbene non vincolante legalmente, segna un precedente importante. Dimostra la volontà delle grandi aziende tecniciche di collaborare con le istituzioni per affrontare le preoccupazioni legate all'AI, anche in assenza di una legislazione specifica. Questo approccio "soft law" potrebbe fungere da ponte verso future normative più strutturate, man mano che la comprensione delle capacità e dei rischi dell'AI evolve.

La discussione sulla governance dell'AI è globale e complessa, con dibattiti che spaziano dalla regolamentazione etica alla sicurezza nazionale. L'iniziativa statunitense sottolinea come la collaborazione tra settore pubblico e privato possa essere un meccanismo per mitigare i rischi, pur mantenendo un certo grado di flessibilità. Per le imprese, ciò significa che la capacità di dimostrare la sicurezza e l'affidabilità dei propri sistemi AI, sia che vengano sviluppati internamente o adottati da terze parti, diventerà sempre più un requisito fondamentale, indipendentemente dal contesto di deployment.

💬 Commenti (0)

🔒 Accedi o registrati per commentare gli articoli.

Nessun commento ancora. Sii il primo a commentare!