AMD e il potenziale dell'AI locale: un "computer" per l'inference domestica

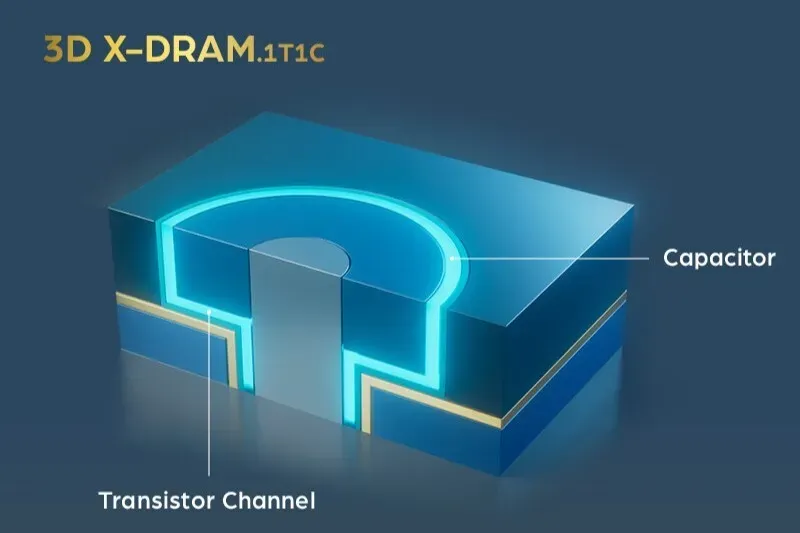

La crescente capacità dell'hardware consumer, con attori come AMD, sta rendendo sempre più accessibile l'esecuzione di carichi di lavoro AI, inclusi i Large Language Models, direttamente su sistemi locali. Questo sviluppo apre nuove prospettive per l...