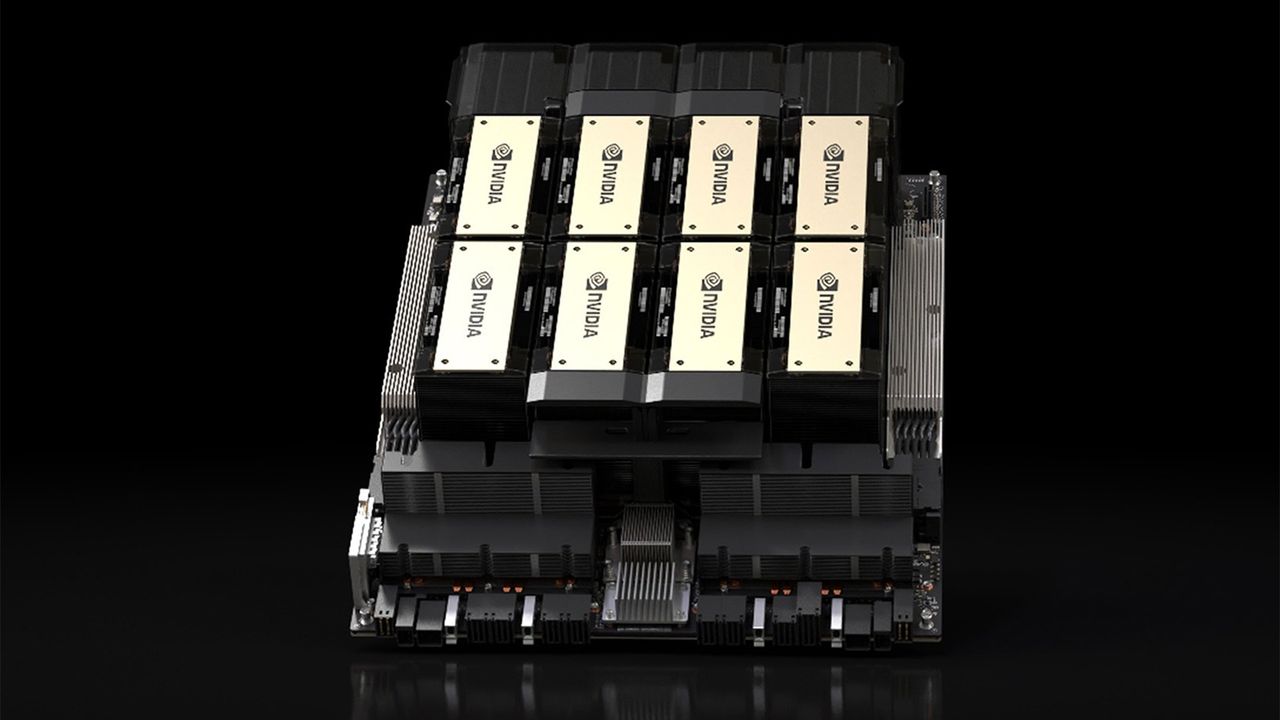

Cina: prototipo GPU AI a 2nm, incertezza sulla produzione

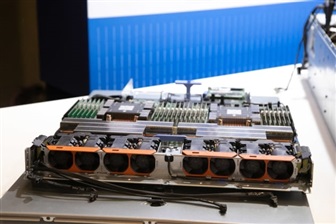

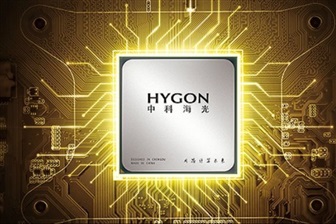

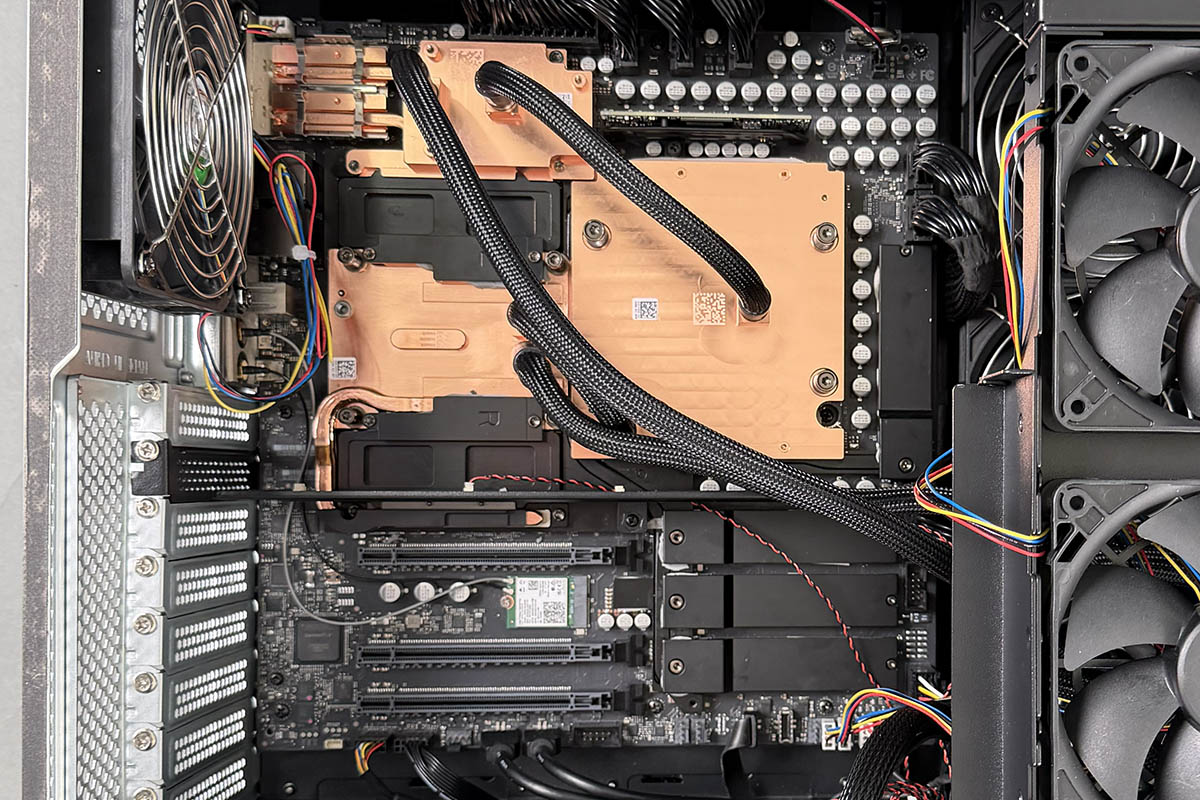

La Cina ha annunciato lo sviluppo di un prototipo di GPU per intelligenza artificiale basato su un processo produttivo a 2 nanometri. Sebbene il raggiungimento di questa soglia tecnicica rappresenti un traguardo significativo, lo stato della produzio...