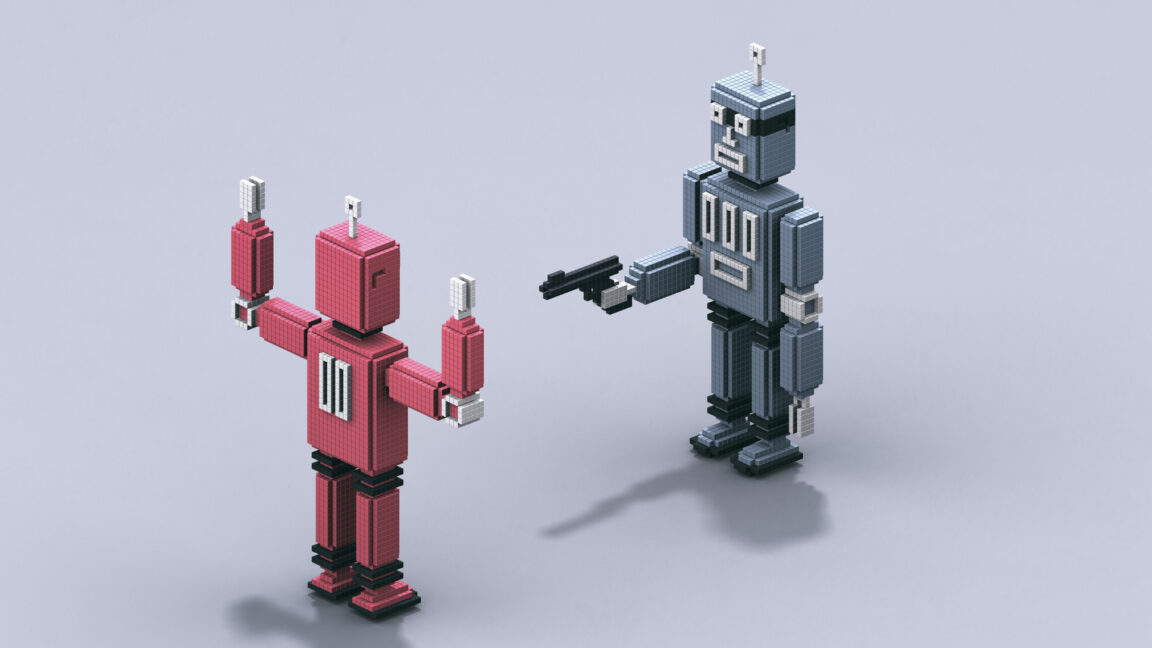

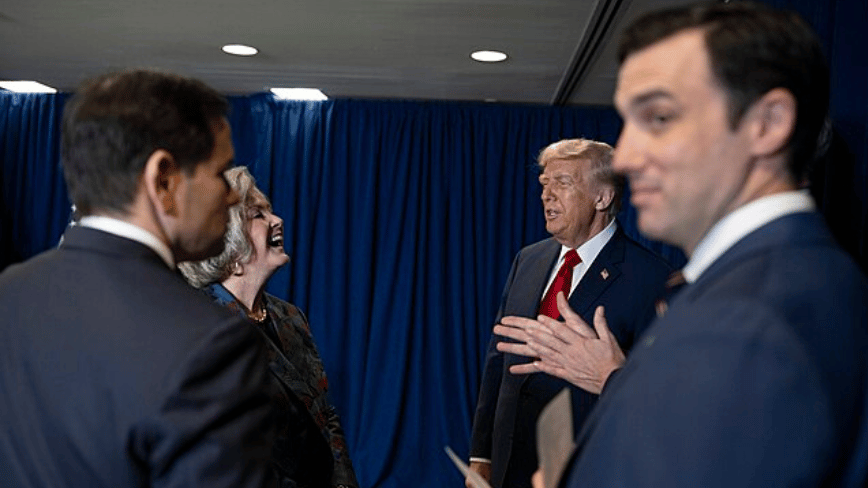

OpenAI: al via le deliberazioni della giuria nel processo sul suo status non-profit

Si sono concluse le tre settimane di testimonianze nel processo che vede contrapposti Elon Musk e Sam Altman, incentrato sullo status non-profit di OpenAI. Le argomentazioni conclusive si sono svolte giovedì, con Elon Musk assente perché impegnato a ...