TSMC: il futuro della robotica si sviluppa nel silicio, non nelle acrobazie

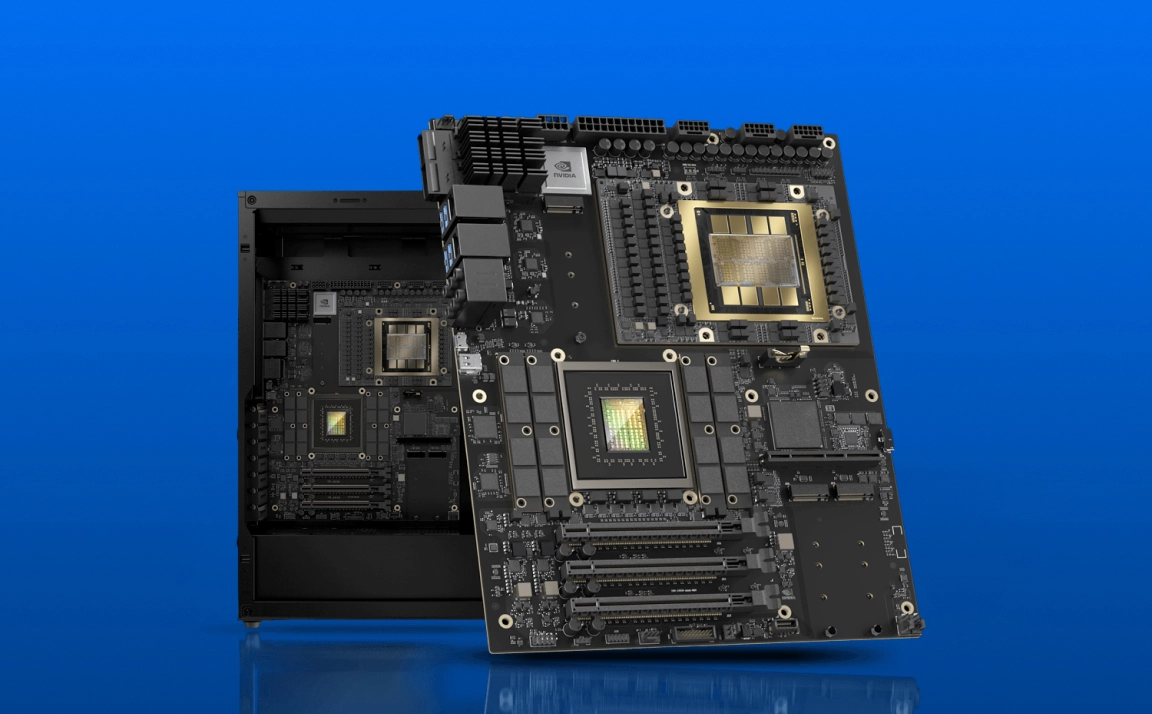

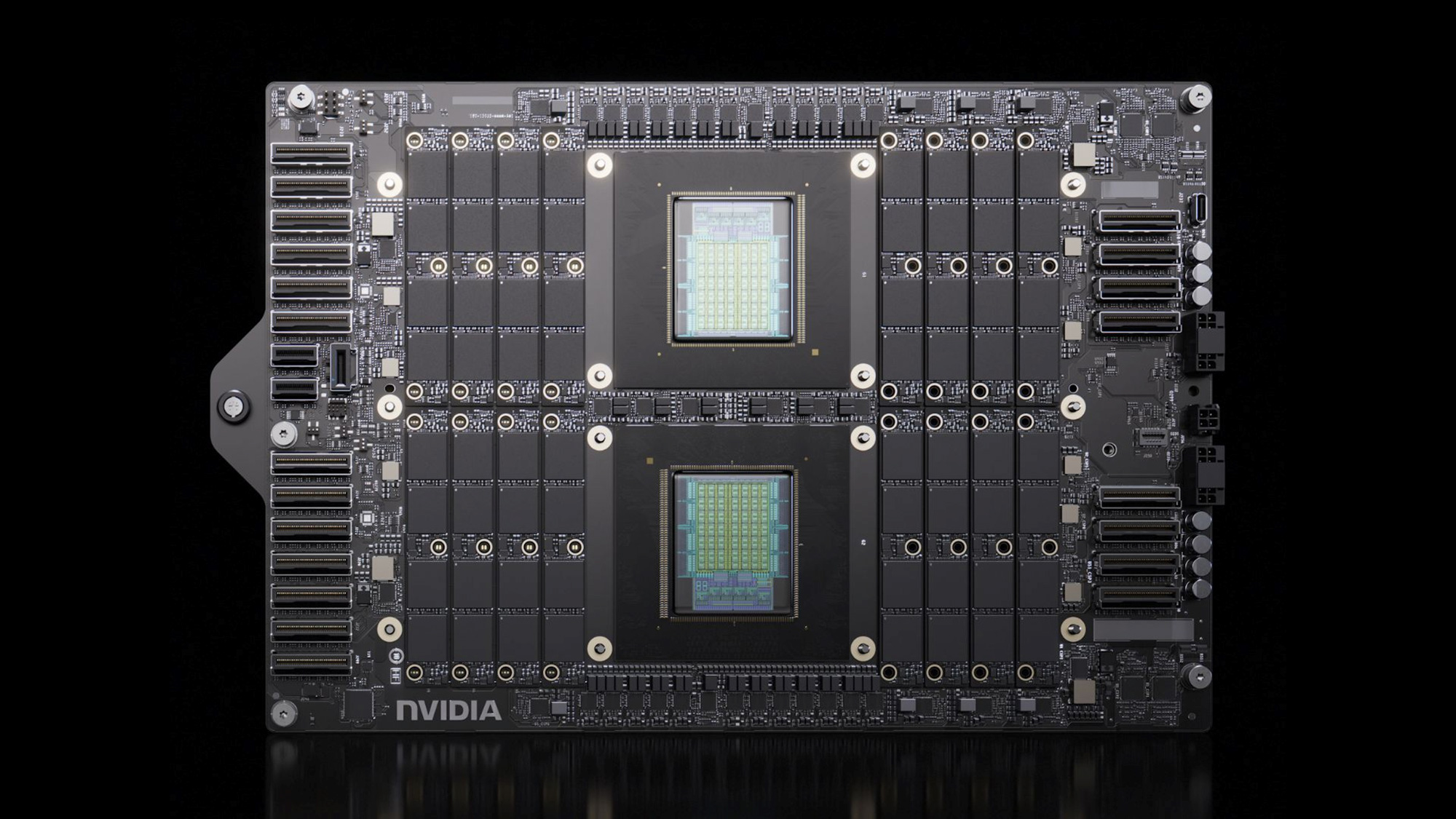

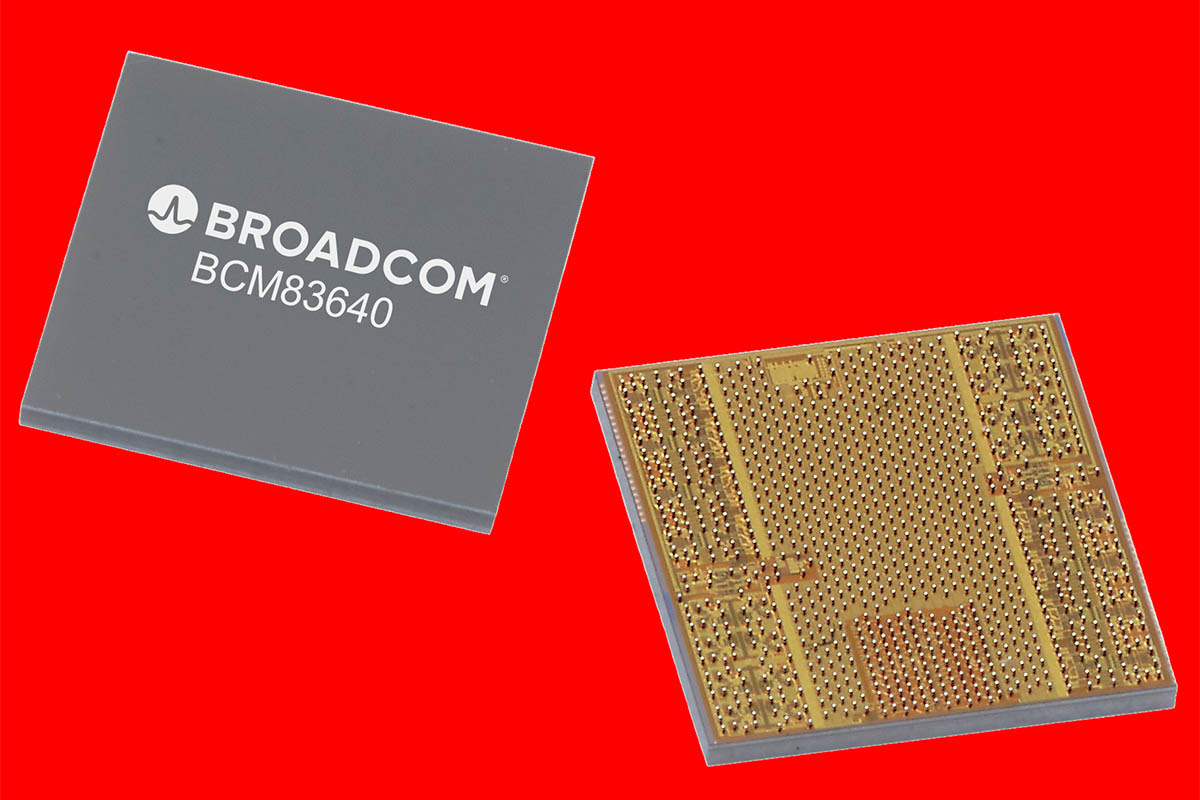

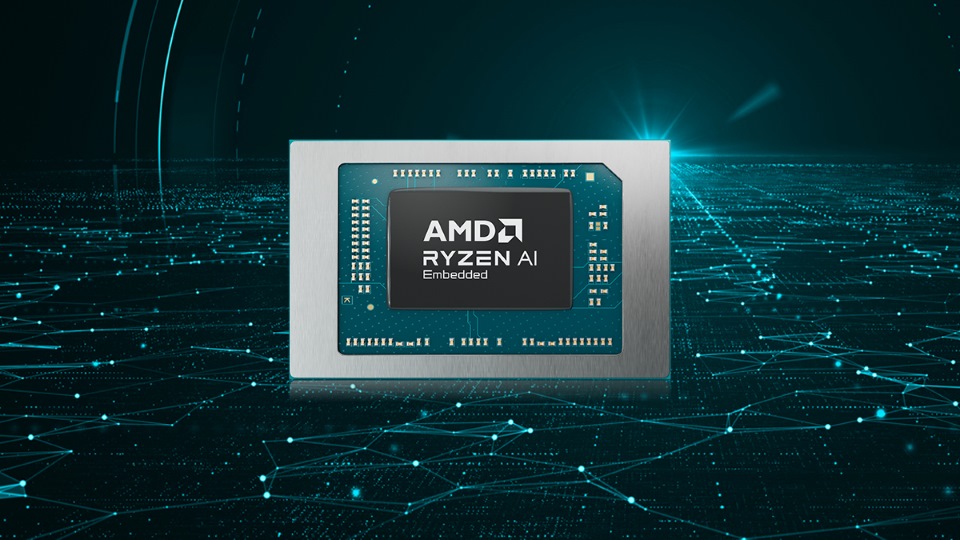

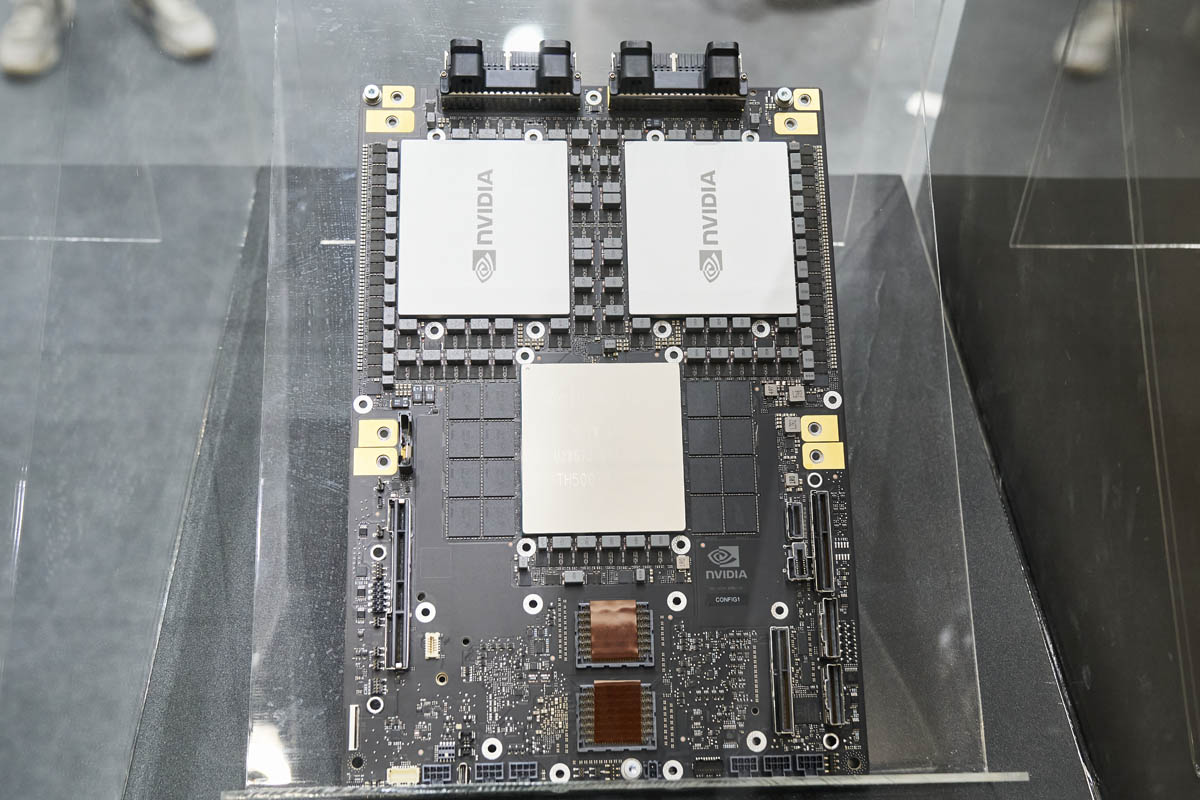

Il presidente di TSMC, C.C. Wei, sottolinea come l'innovazione nella robotica sia intrinsecamente legata ai progressi nel campo dei semiconduttori. L'articolo evidenzia l'importanza del silicio come fondamento per lo sviluppo di sistemi robotici avan...