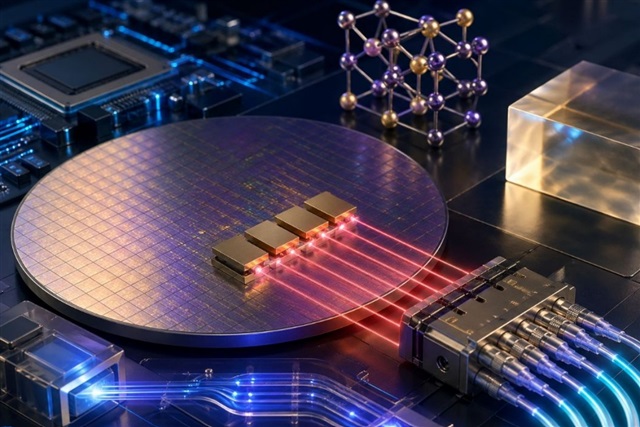

AMD Strix Halo: 192GB di Memoria per LLM On-Premise, un Nuovo Orizzonte?

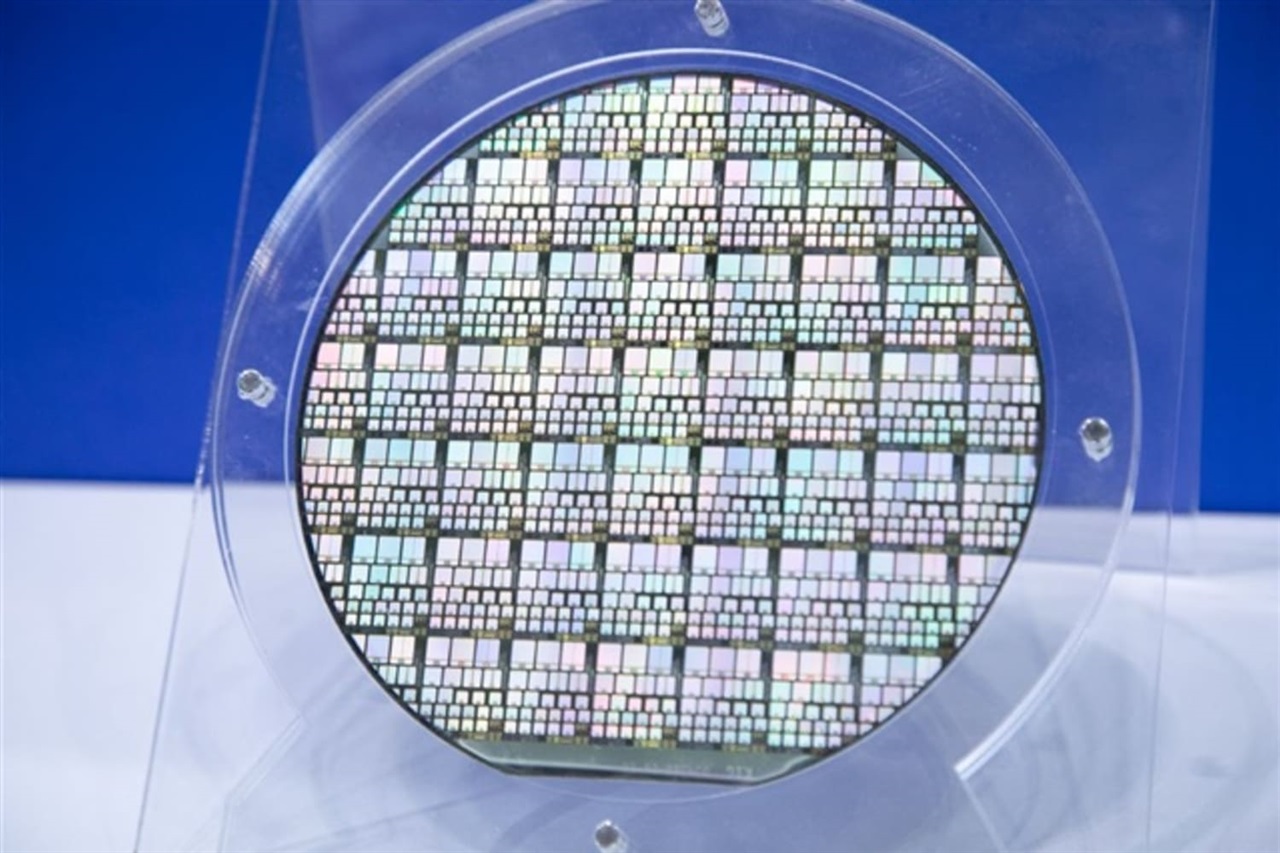

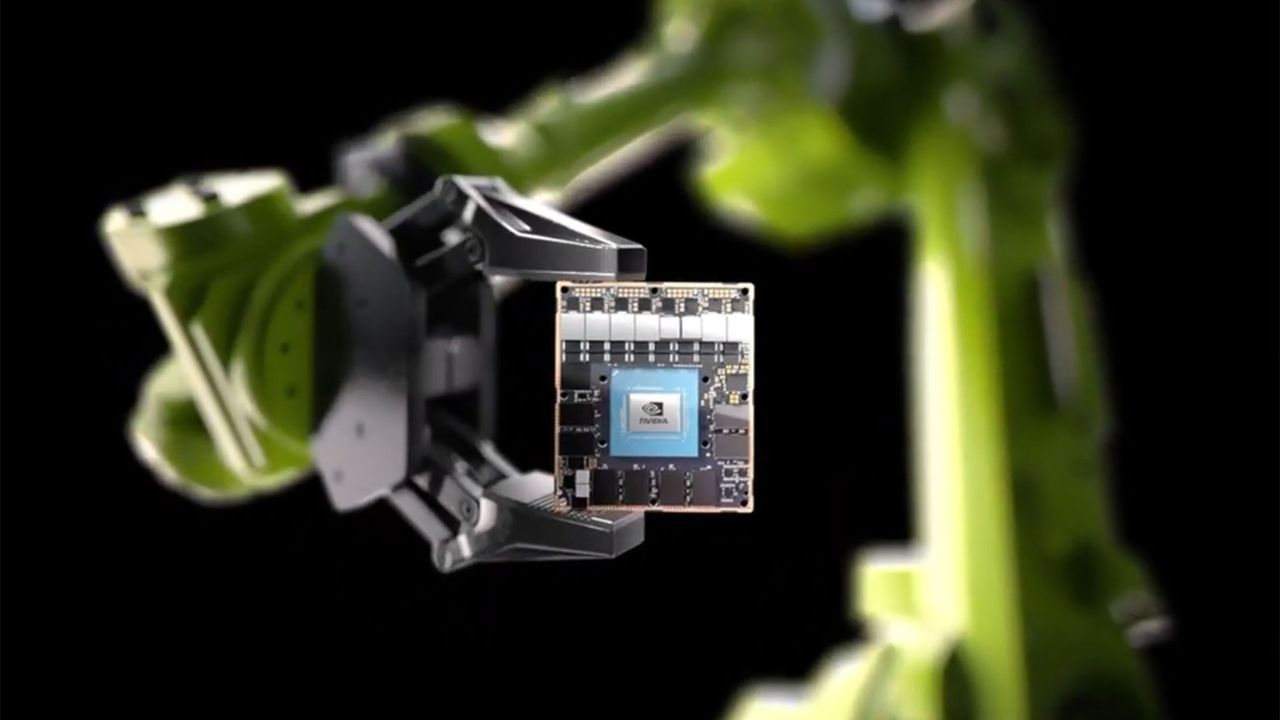

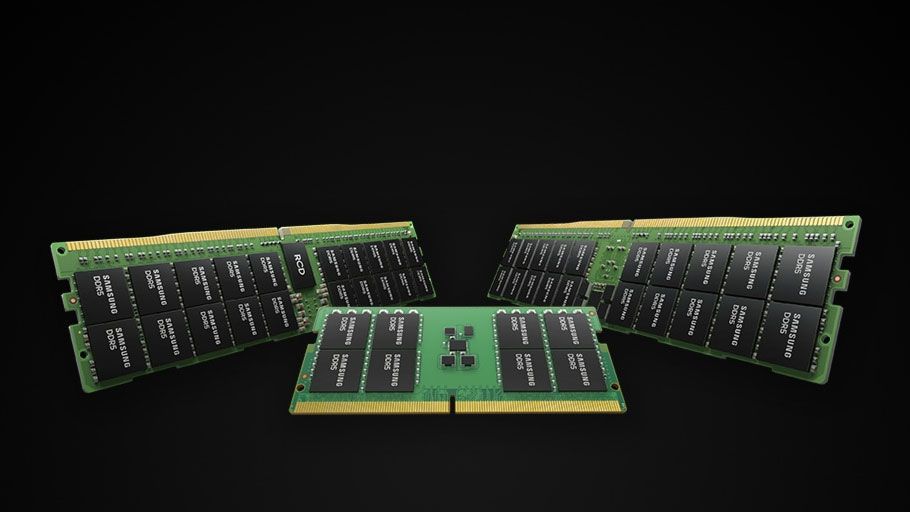

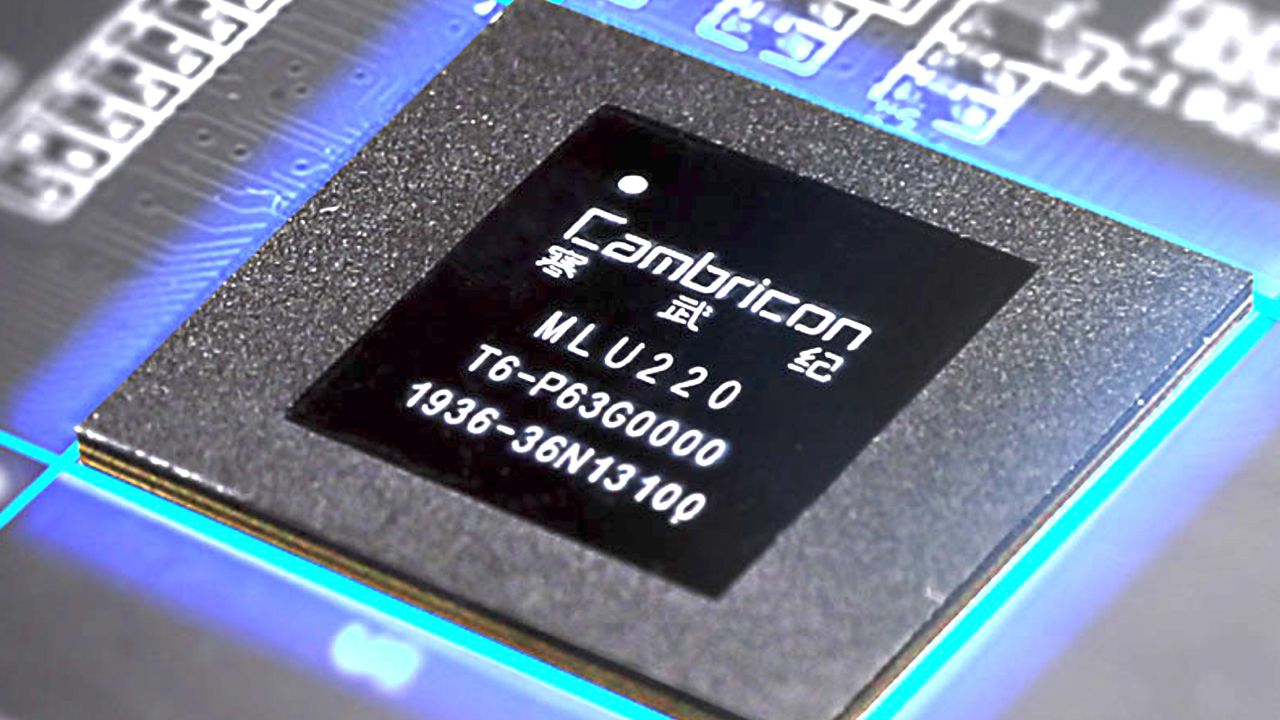

Le recenti indiscrezioni suggeriscono che il prossimo APU AMD Strix Halo, noto come "Gorgon Halo 495 Max" o "Ryzen AI Max Pro 495", potrebbe integrare 192GB di memoria. Questa capacità, abbinata a una iGPU Radeon 8065S, rappresenterebbe un significat...