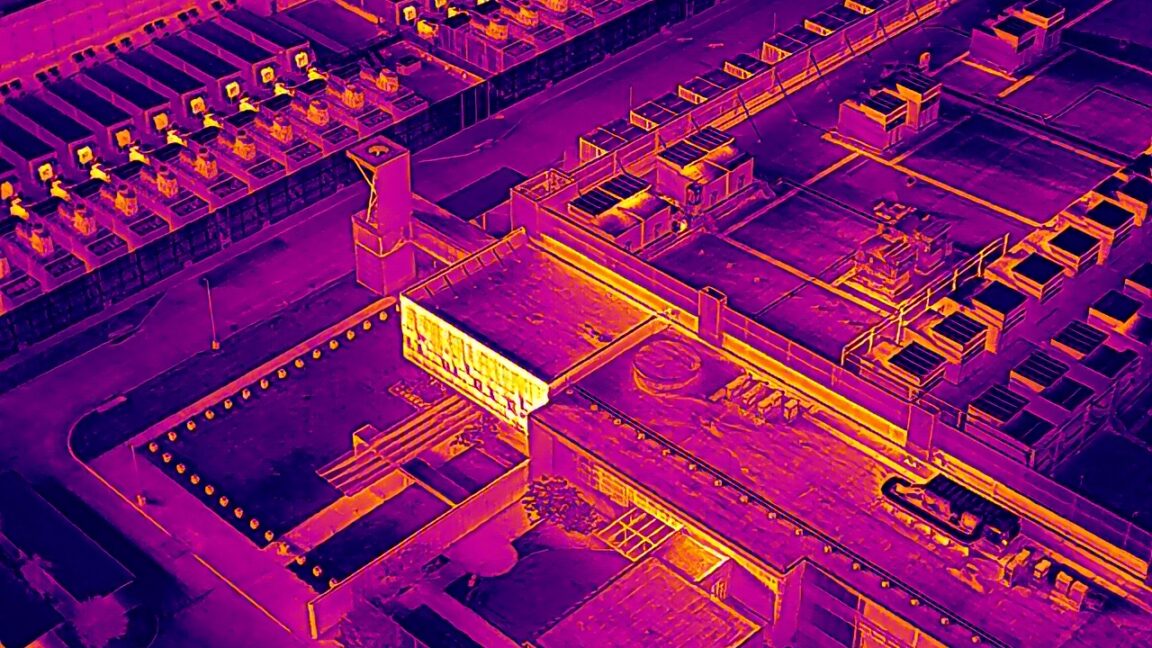

TSMC e la catena di fornitura CoPoS: turbolenze legali e impatto sull'hardware AI

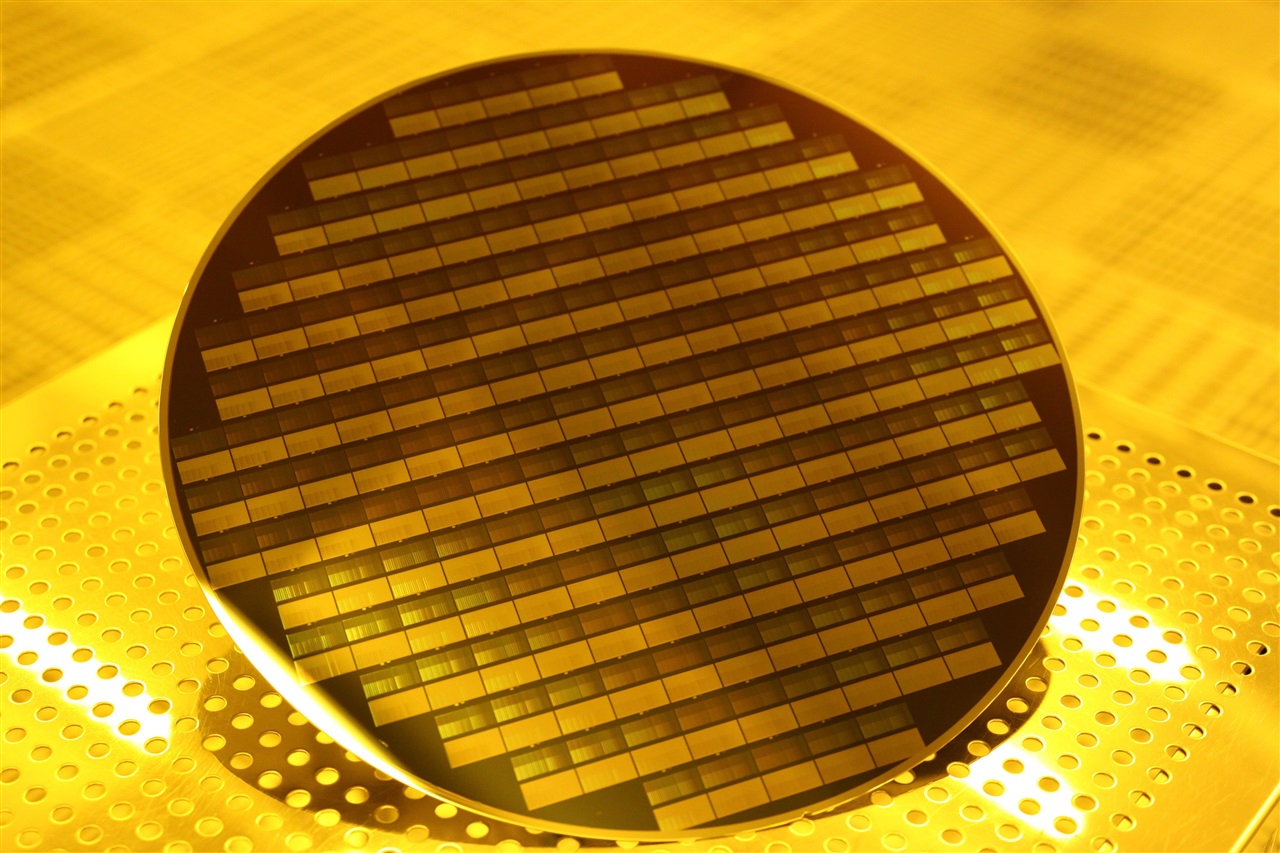

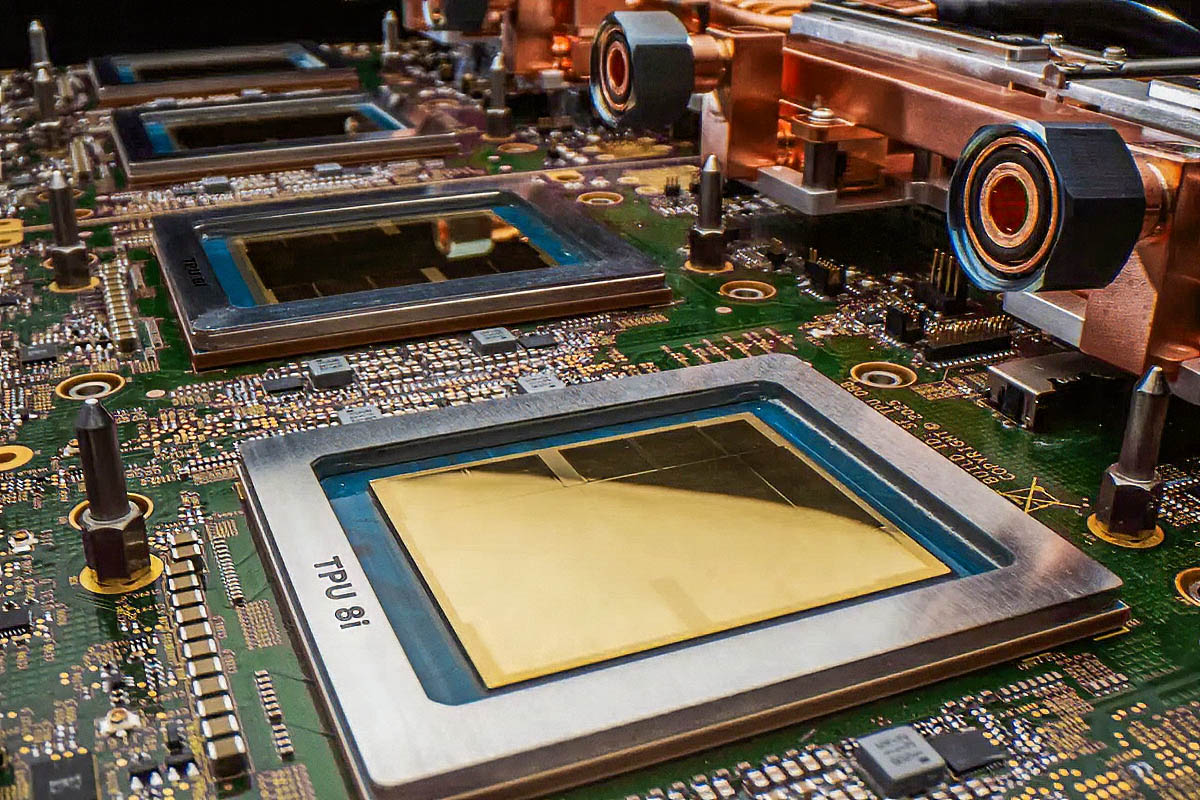

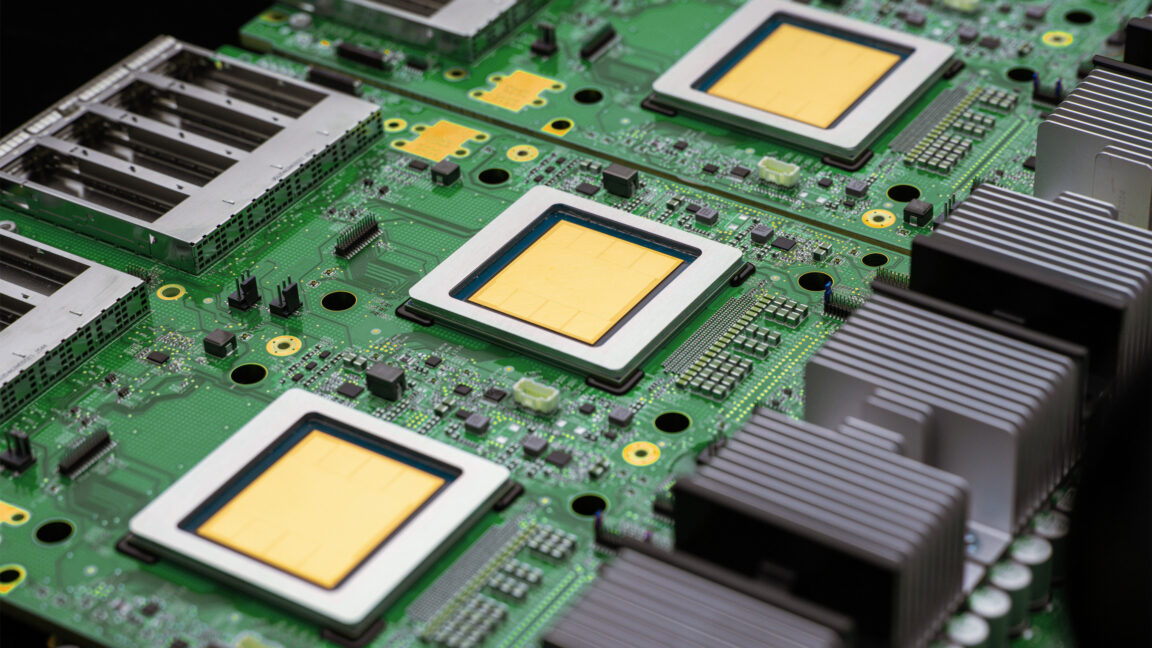

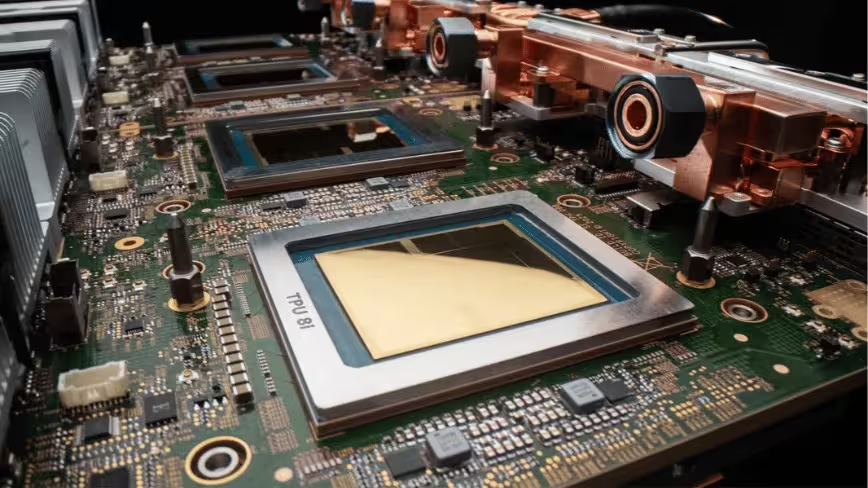

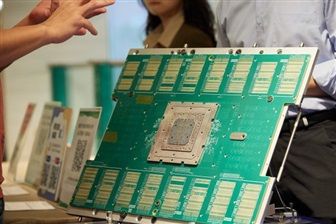

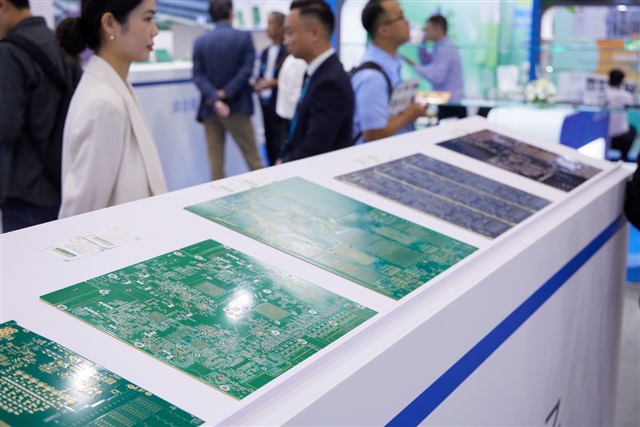

Ordini di apparecchiature CoPoS per TSMC subiscono un rimescolamento a causa di problemi legali che coinvolgono un fornitore taiwanese. Questa situazione evidenzia le vulnerabilità nella catena di fornitura per il packaging avanzato, cruciale per i c...