L'AI rivoluziona il testing dei semiconduttori: la visione del CEO di AEM

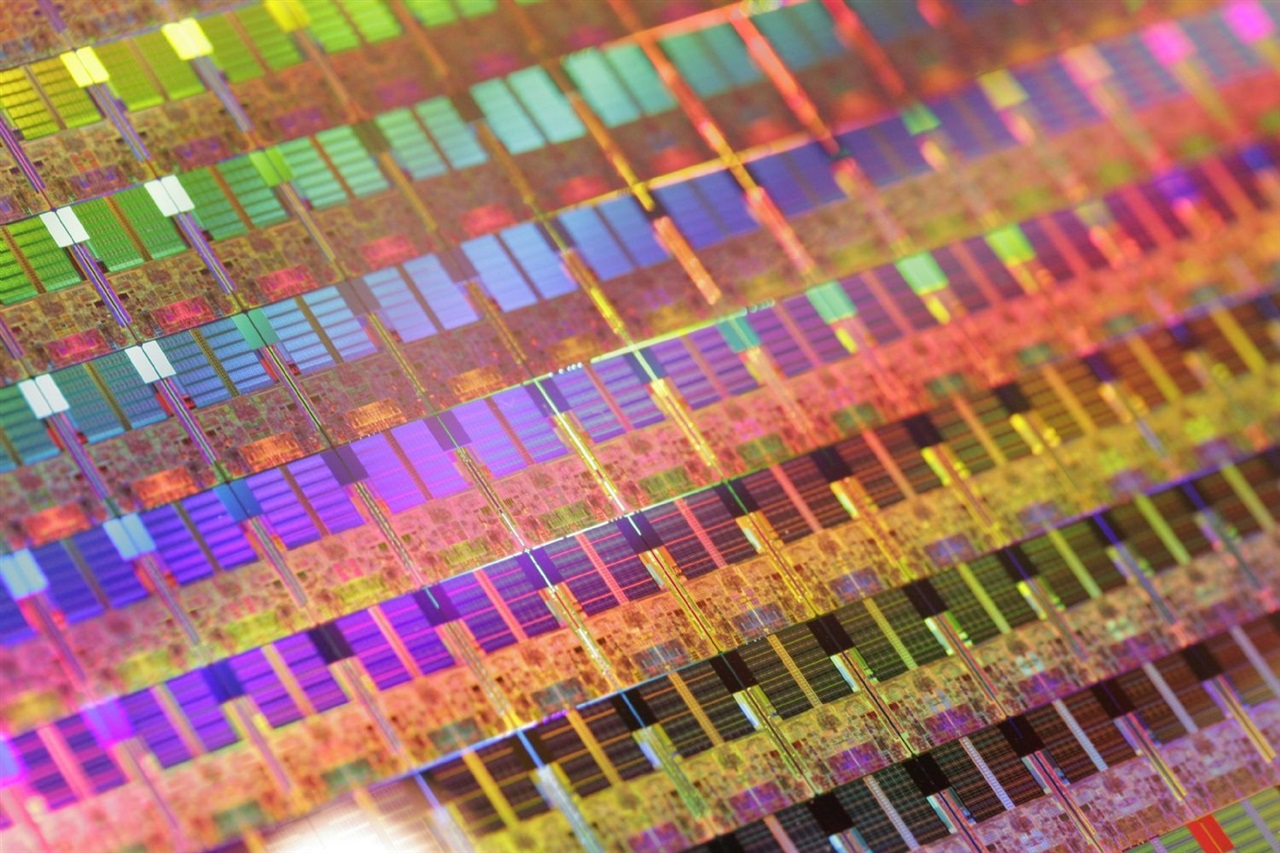

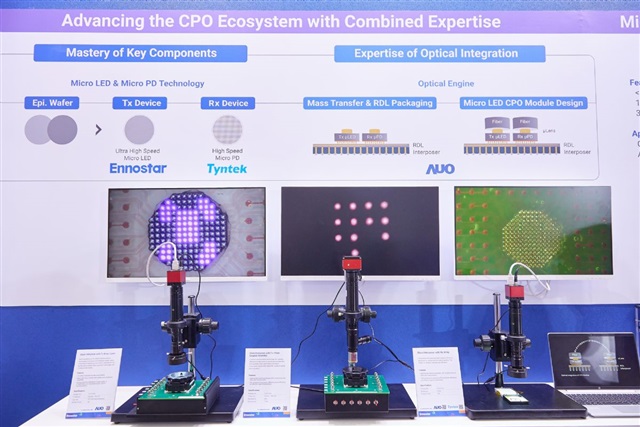

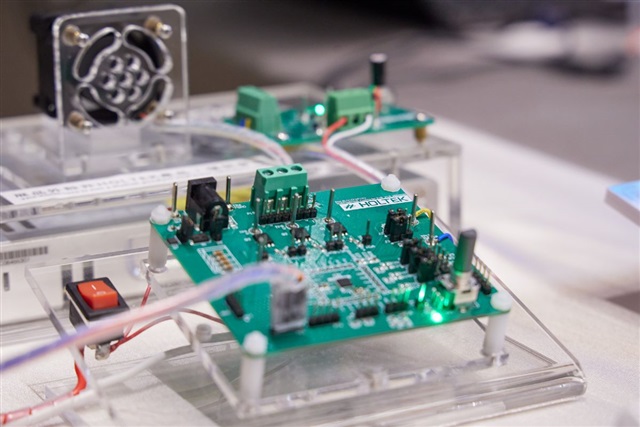

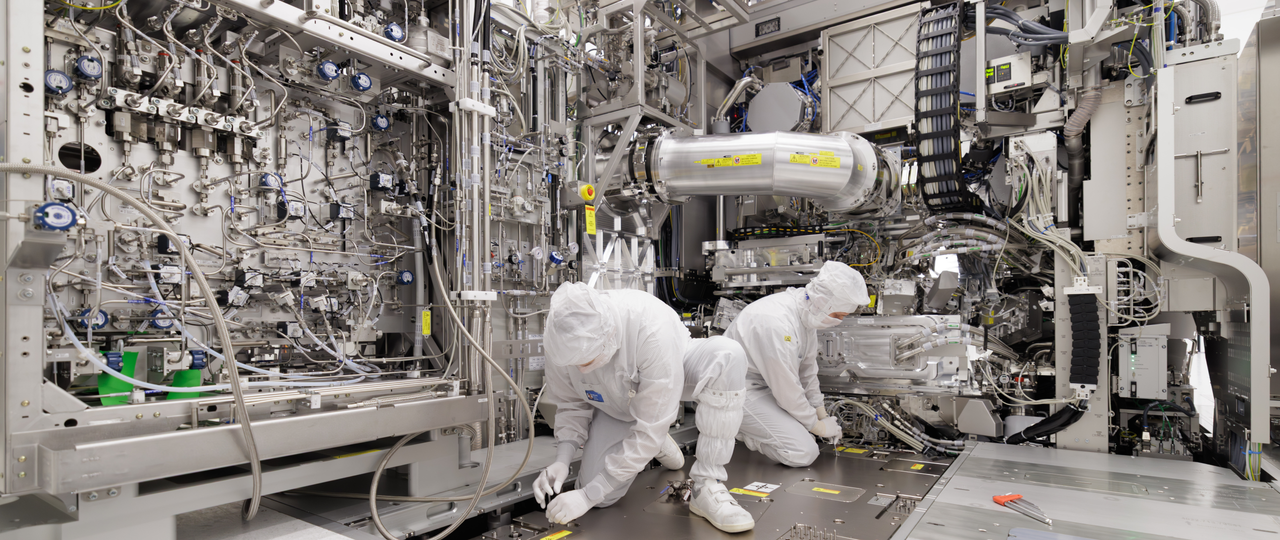

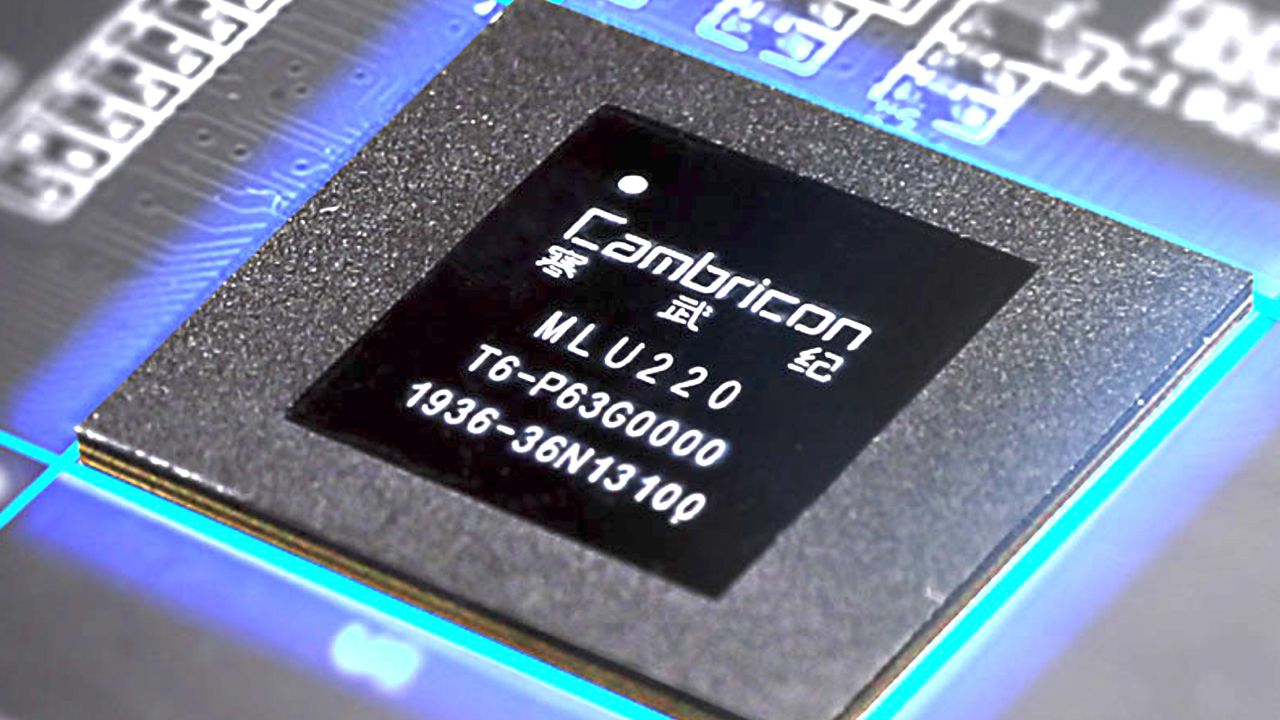

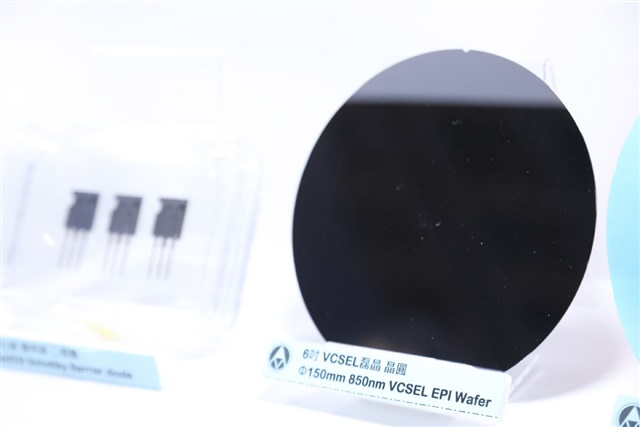

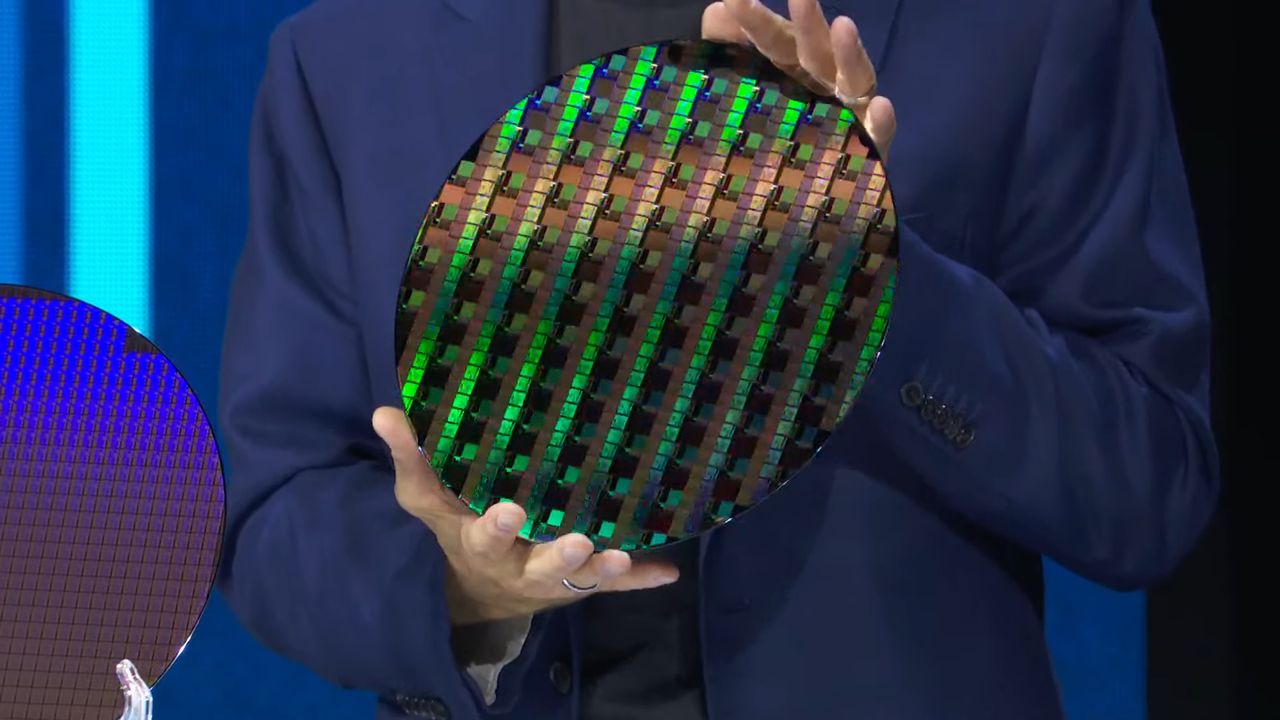

Il CEO di AEM evidenzia come l'intelligenza artificiale stia trasformando radicalmente il settore del testing dei semiconduttori. Questa evoluzione impone nuove sfide e opportunità per l'industria, spingendo verso l'adozione di soluzioni più efficien...