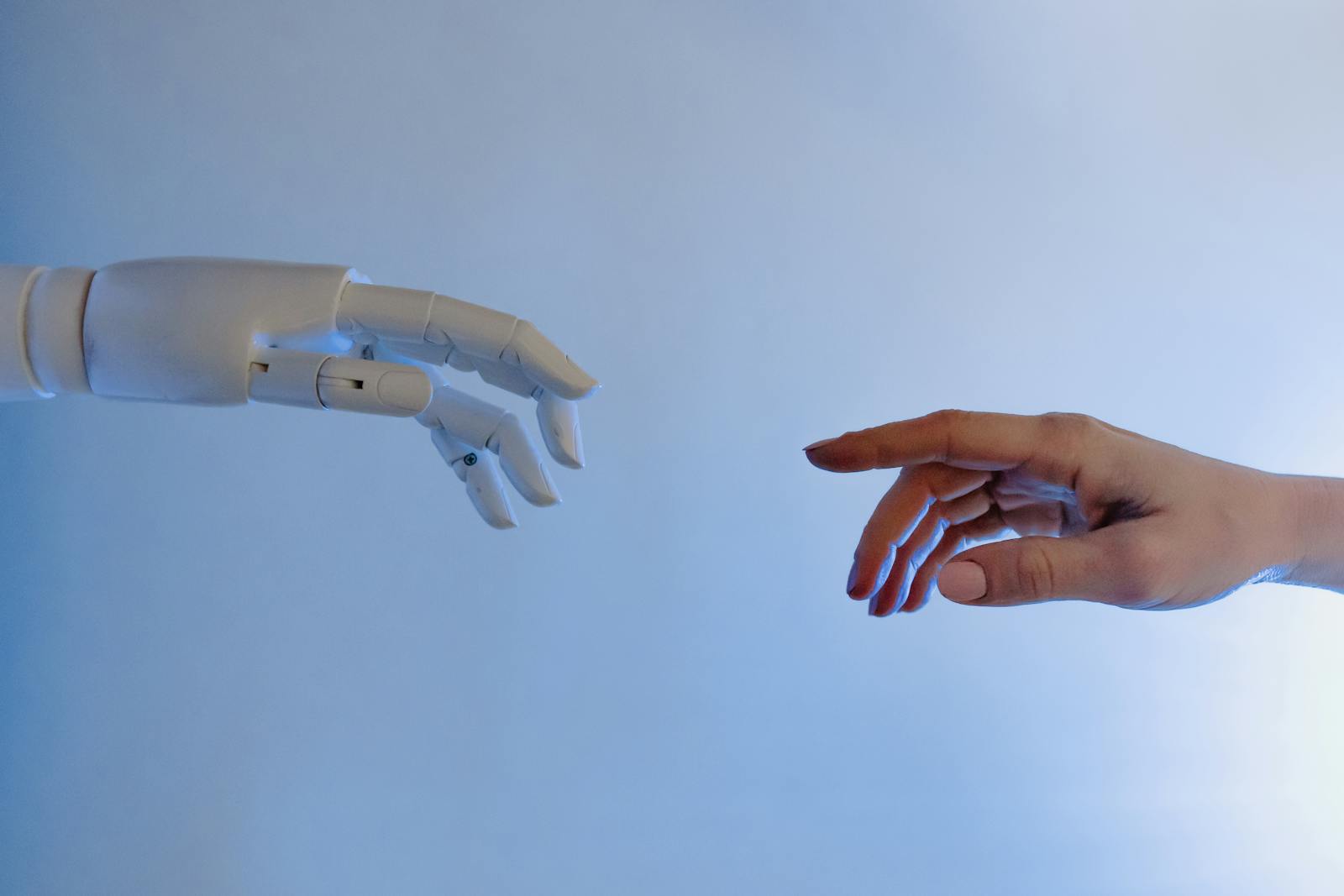

Sam Altman: addestrare un essere umano richiede molta energia

Sam Altman, CEO di OpenAI, sottolinea come anche l'addestramento degli esseri umani richieda un notevole dispendio energetico. Il commento si inserisce nel dibattito sull'impatto ambientale dell'intelligenza artificiale e dei modelli linguistici di g...