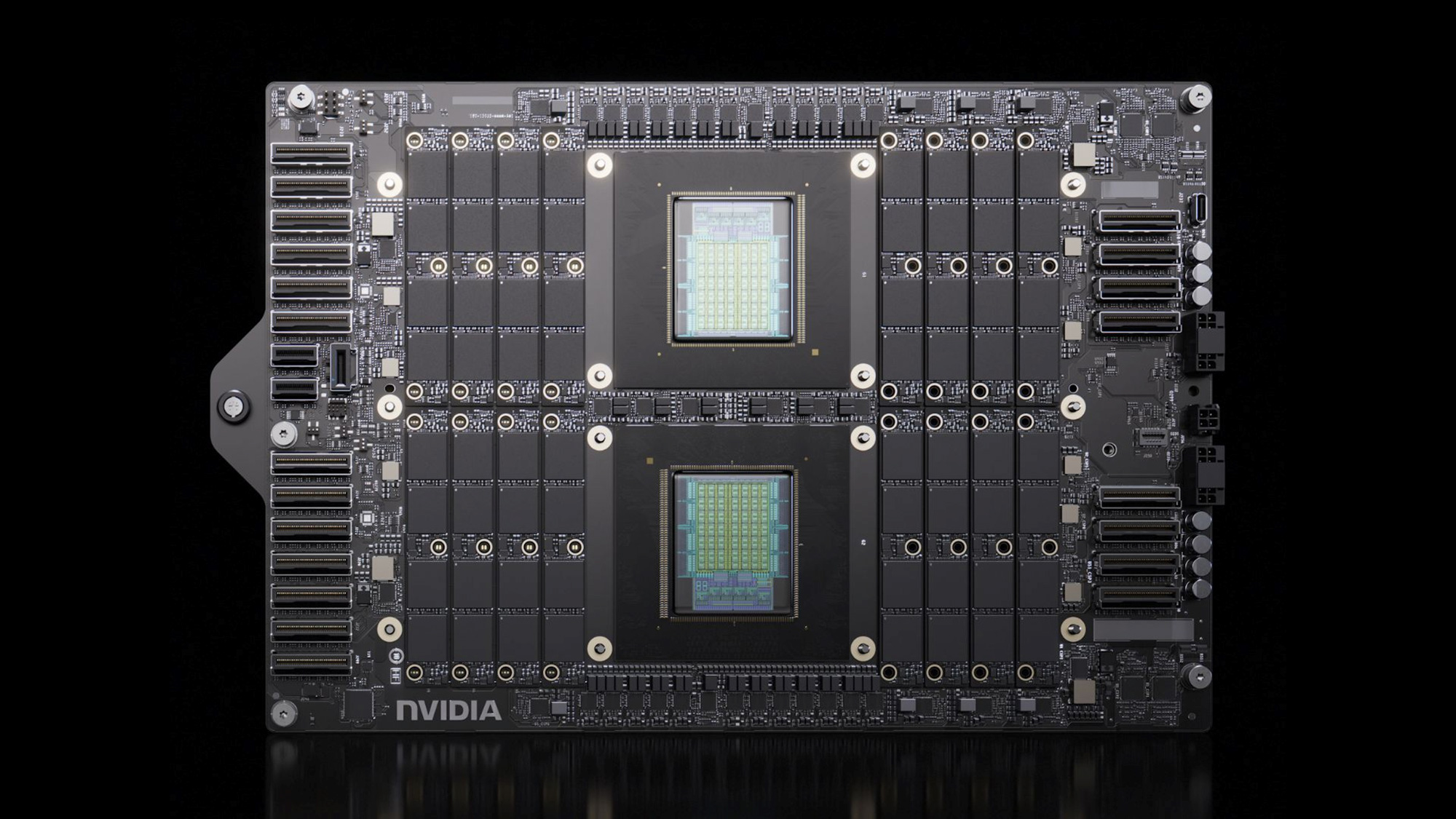

SK Hynix punta a fabbriche autonome entro il 2030

Il produttore di memorie SK Hynix ha annunciato l'obiettivo di realizzare fabbriche di semiconduttori completamente autonome entro il 2030. Questa iniziativa mira a rispondere alle crescenti sfide produttive poste dall'intelligenza artificiale e dall...