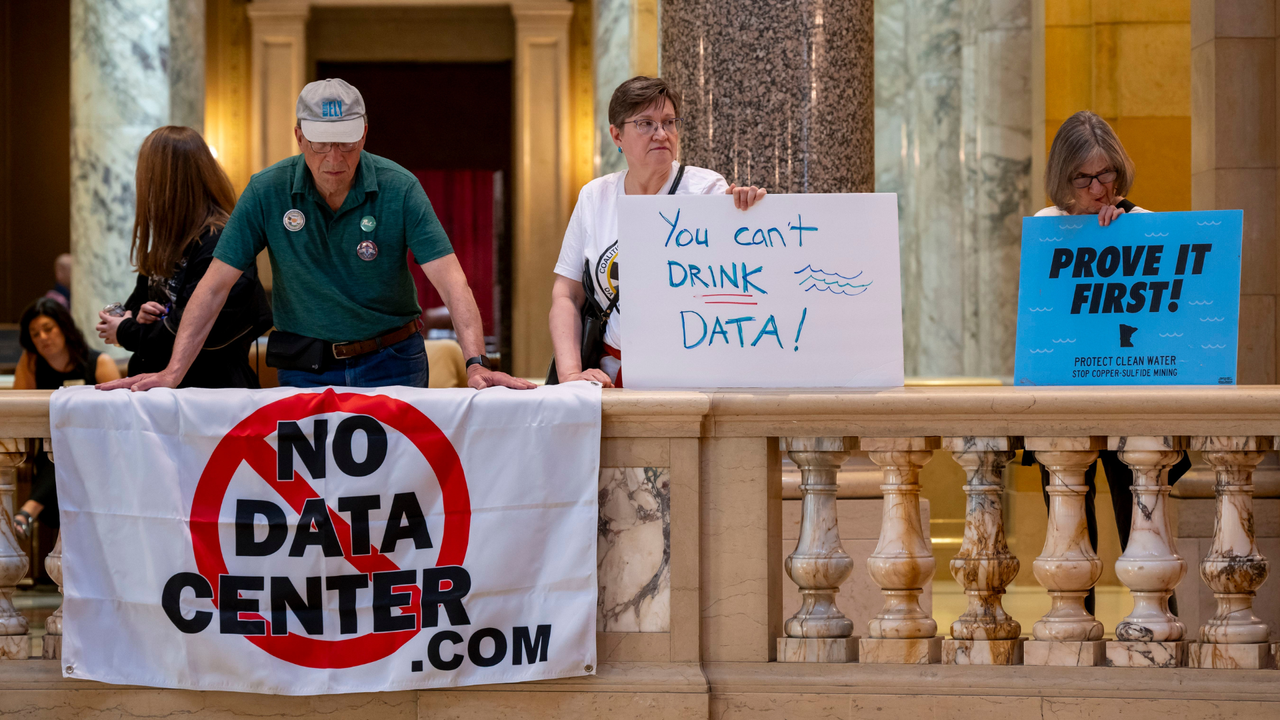

Crisi energetica e RE100: Taiwan rischia gli ordini tech globali

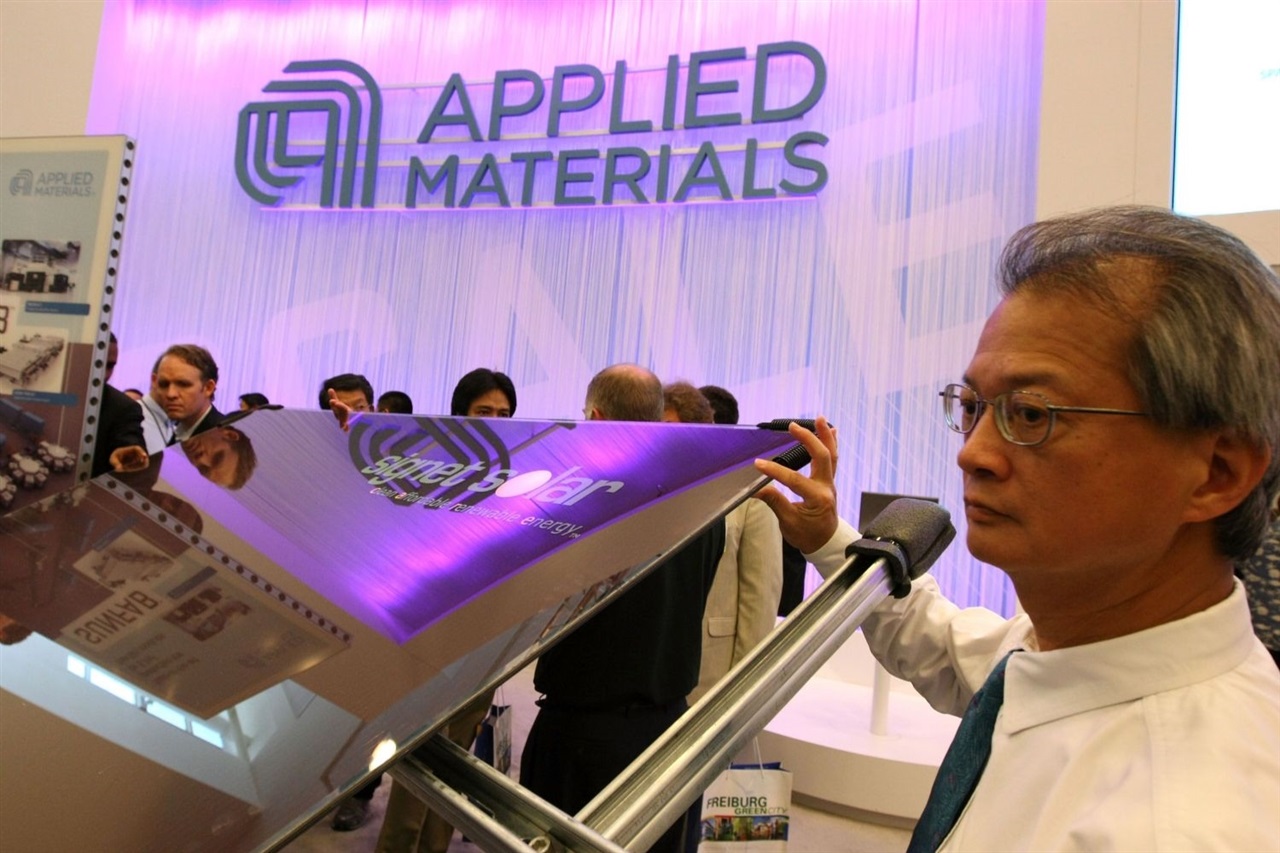

Ping Cheng, presidente di Delta Electronics, ha lanciato un allarme sui potenziali ritardi nell'adesione di Taiwan all'iniziativa RE100. La carenza di energia verde potrebbe compromettere la capacità dell'isola di soddisfare gli impegni di sostenibil...