Dinamiche Geopolitiche e Autonomia Digitale: Il Ruolo del Self-Hosted AI

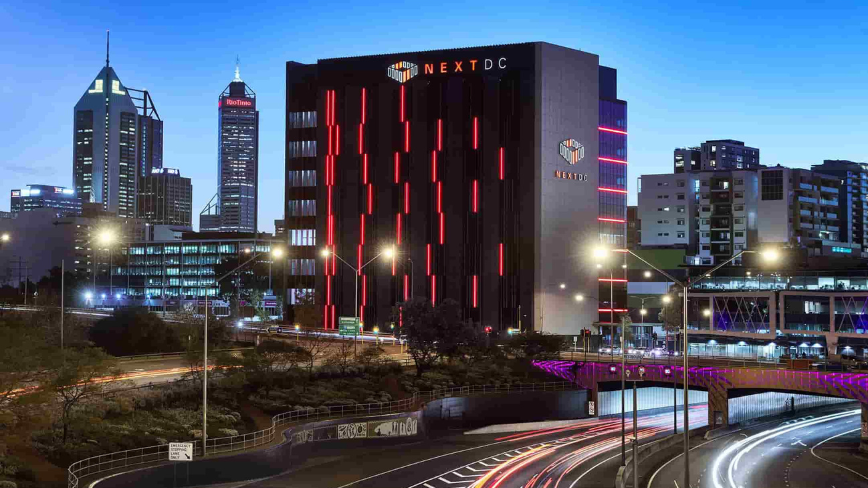

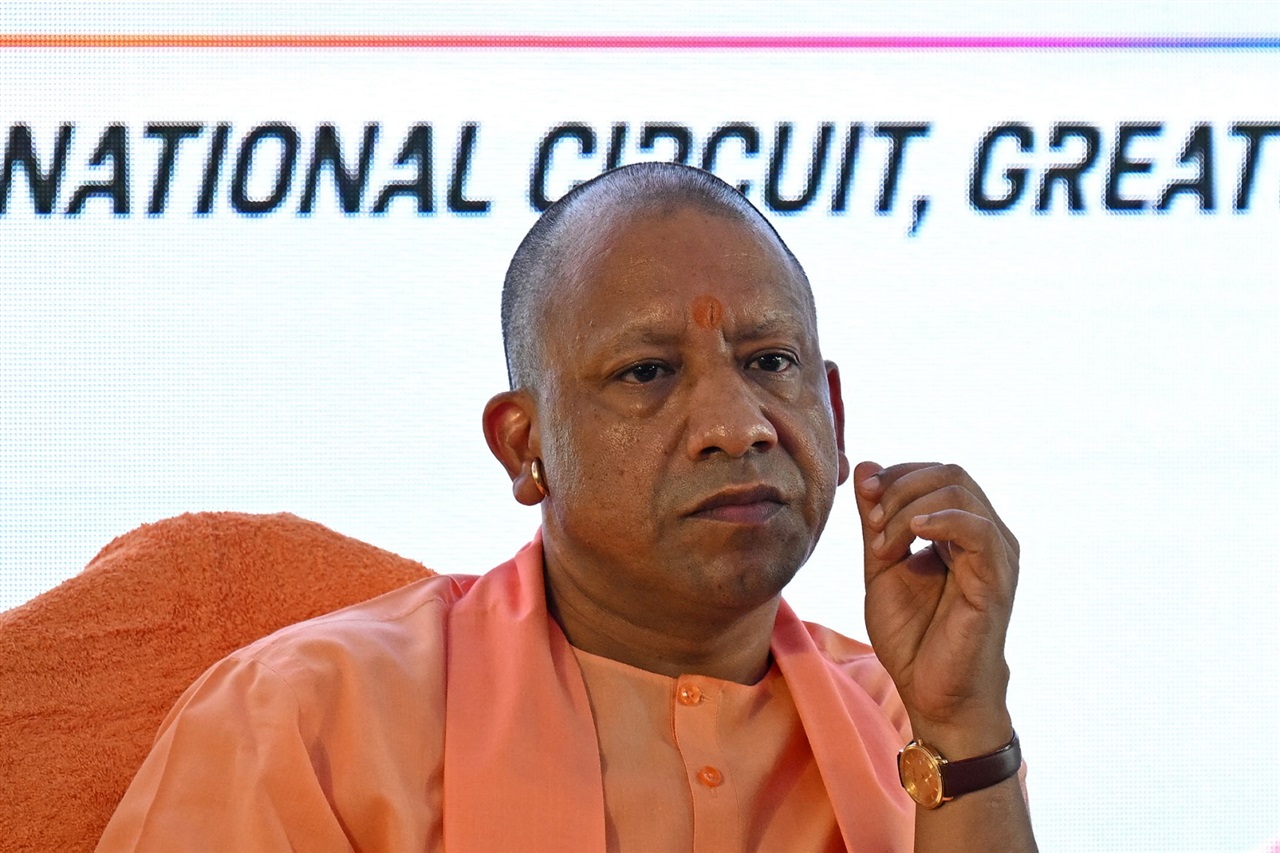

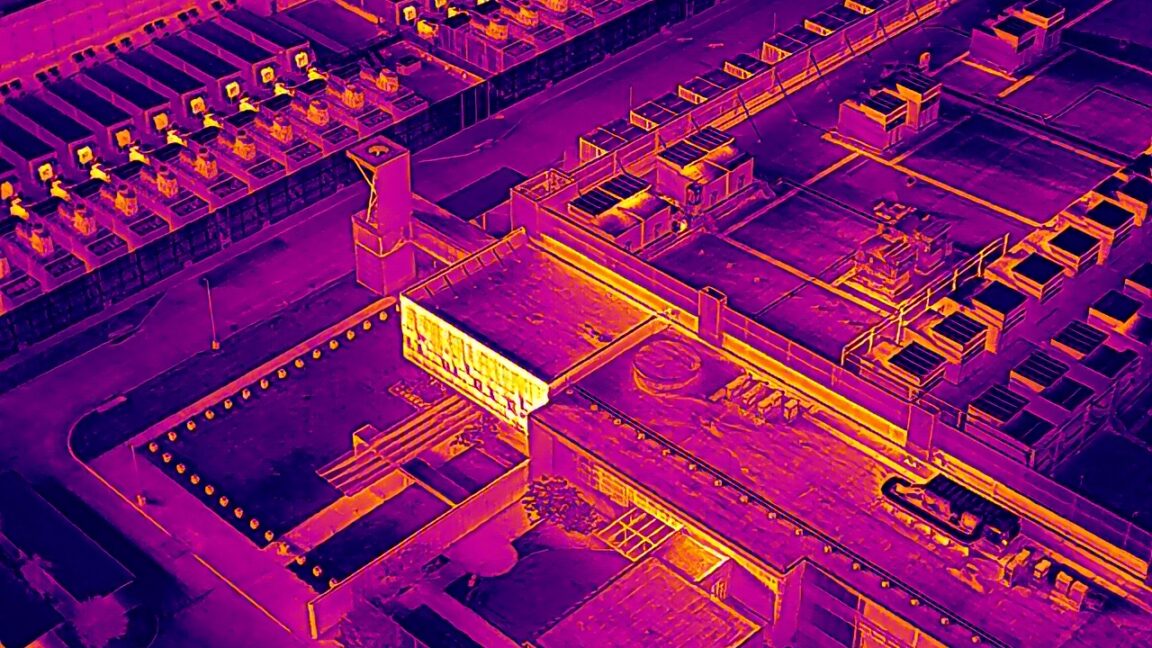

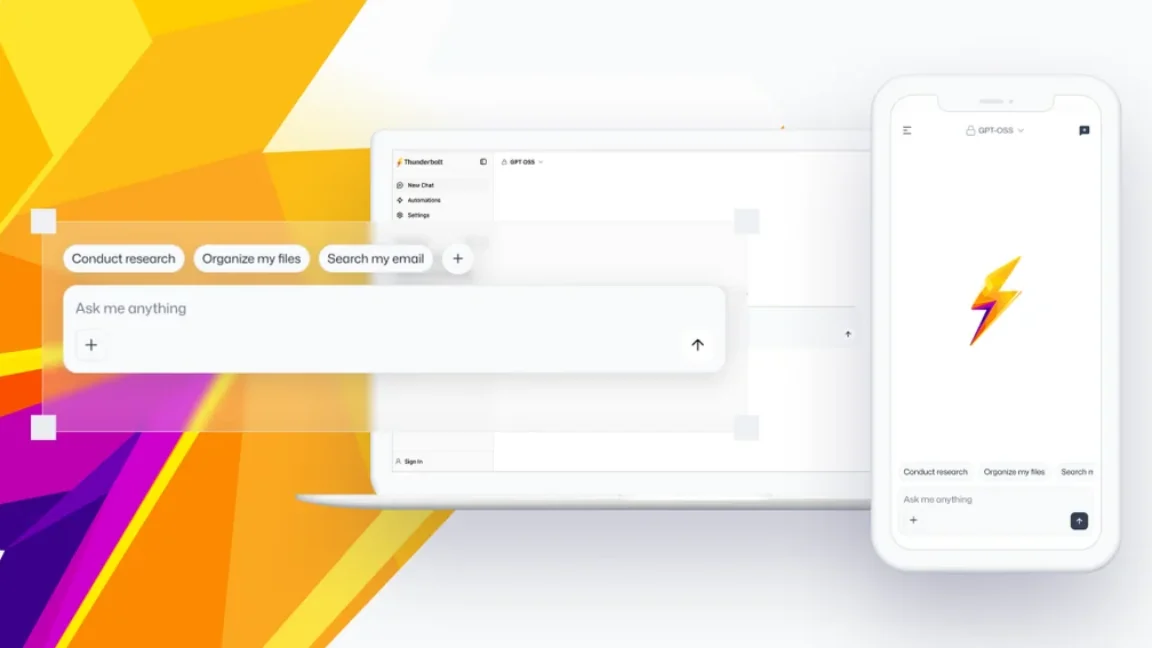

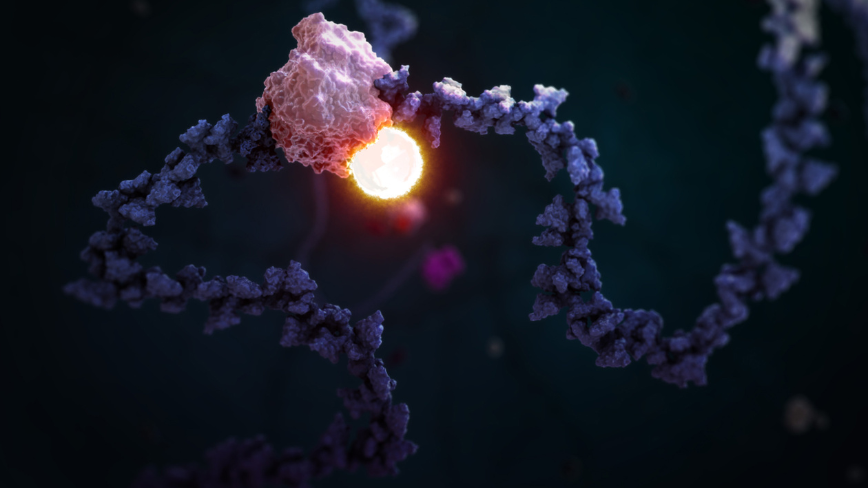

Le recenti misure geopolitiche e l'affermazione di obiettivi economici indipendenti, come riportato da DIGITIMES, sottolineano l'importanza della sovranità e del controllo. Questo contesto si riflette nel settore tecnicico, dove le aziende valutano s...