AMD ROCm 7.13: il nuovo SDK estende il supporto a Instinct MI350P e APU Ryzen AI

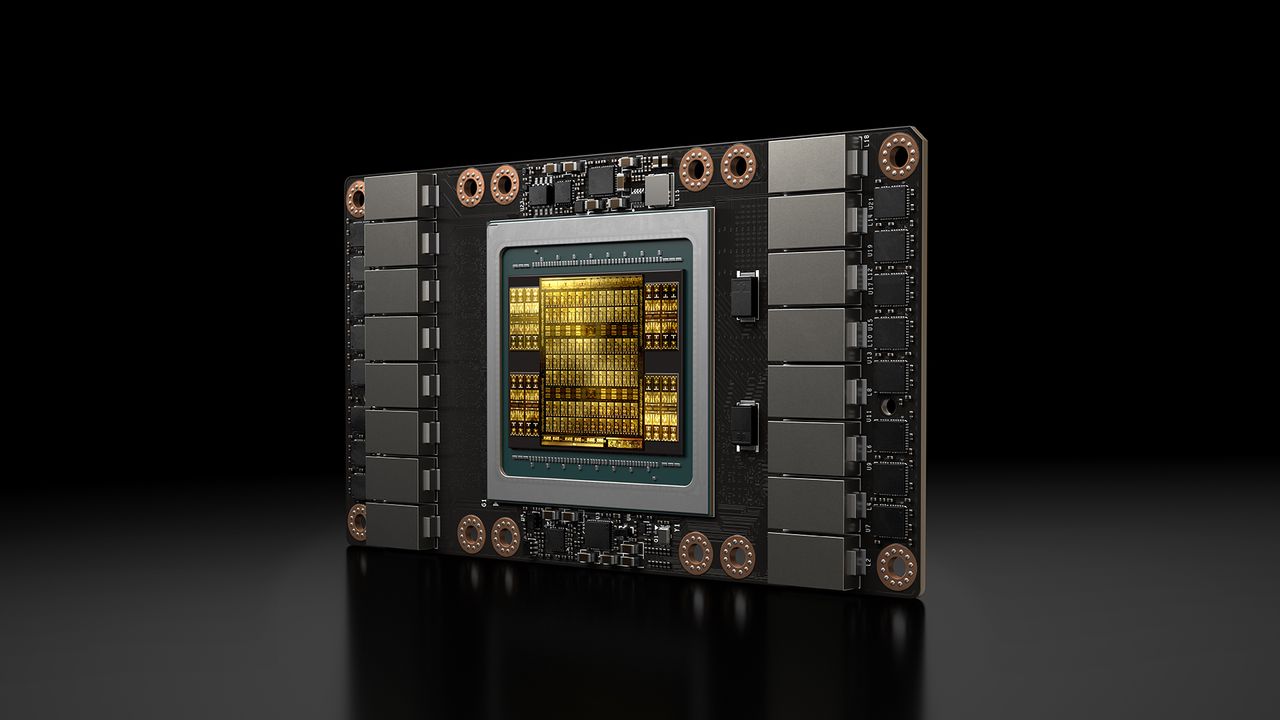

AMD ha rilasciato ROCm 7.13, l'ultima anteprima del suo SDK Core, che introduce il supporto per le GPU Instinct MI350P e per un numero maggiore di APU Ryzen AI. Questo aggiornamento è cruciale per gli sviluppatori e le aziende che utilizzano l'hardwa...