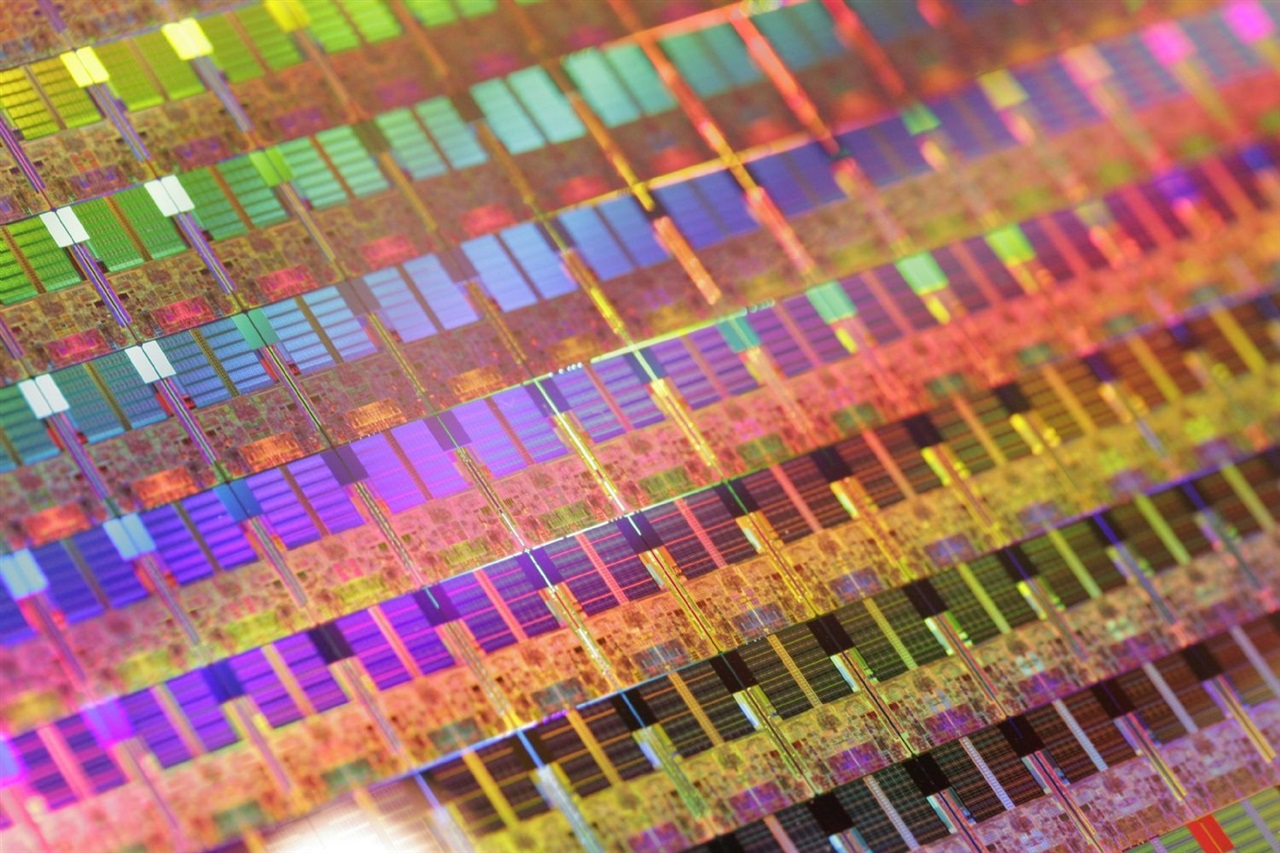

Il sogno indiano dei chip: Lam Research guarda oltre le fabbriche

Lam Research, tramite il suo Managing Director Rangesh Raghavan, sottolinea l'importanza di un approccio olistico per il "sogno indiano dei chip", che vada oltre la semplice costruzione di fabbriche. L'azienda evidenzia la necessità di sviluppare un ...