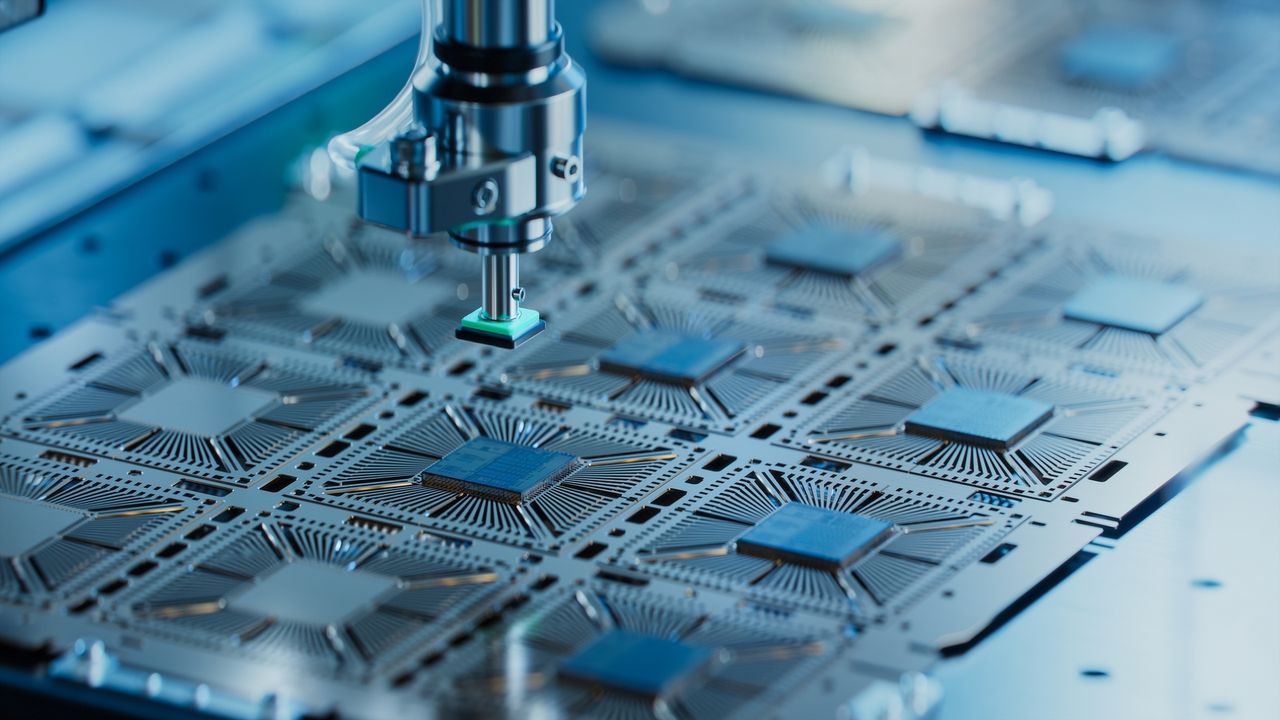

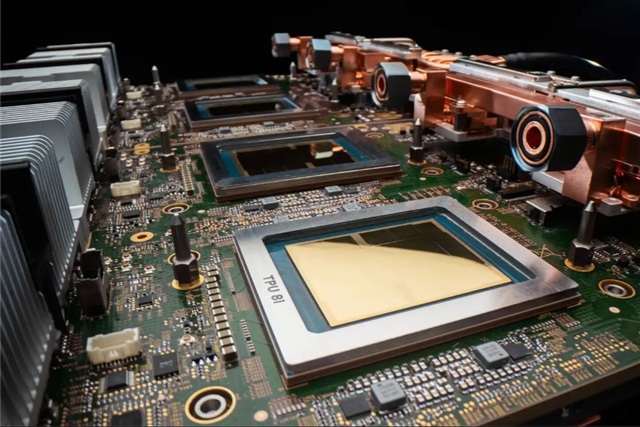

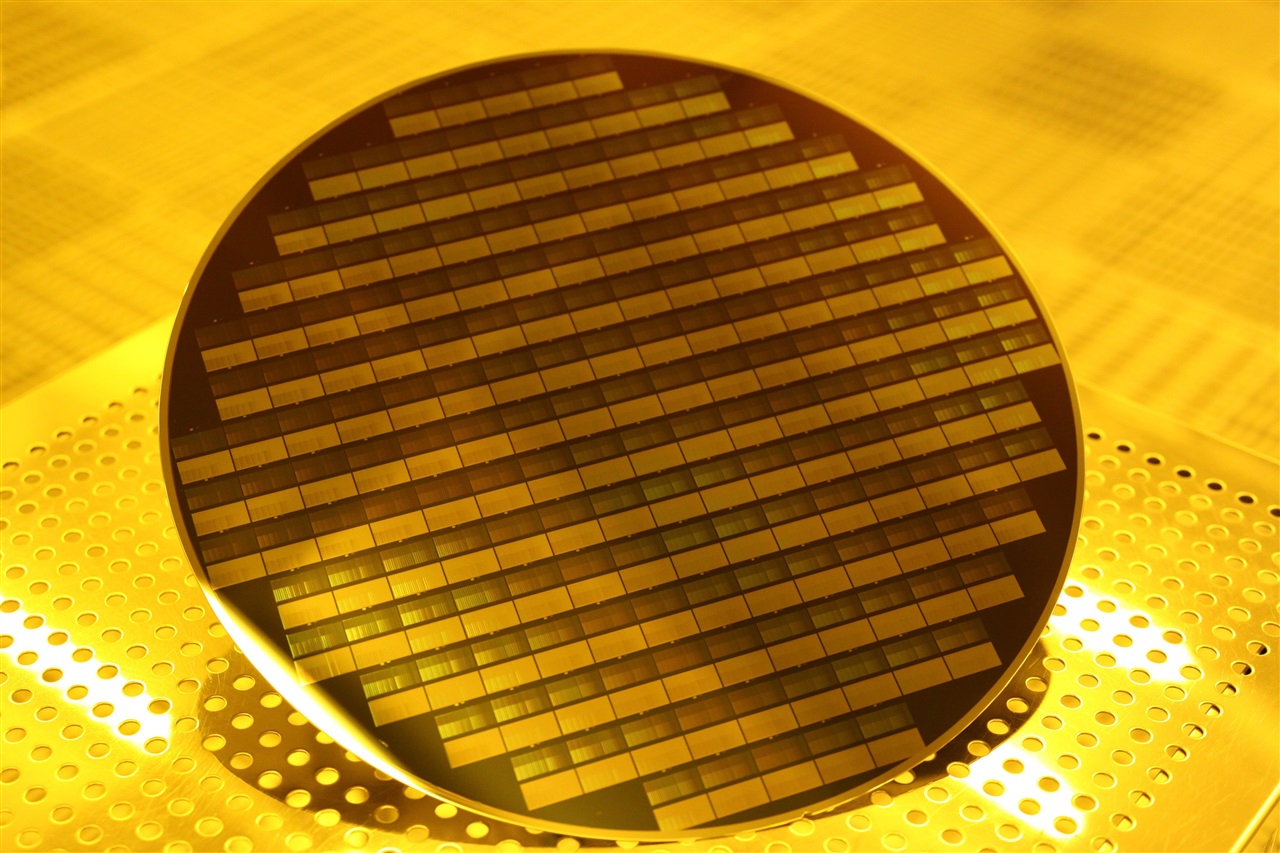

Taiwan: Esportazioni oltre gli 800 miliardi di dollari entro il 2026 grazie all'AI

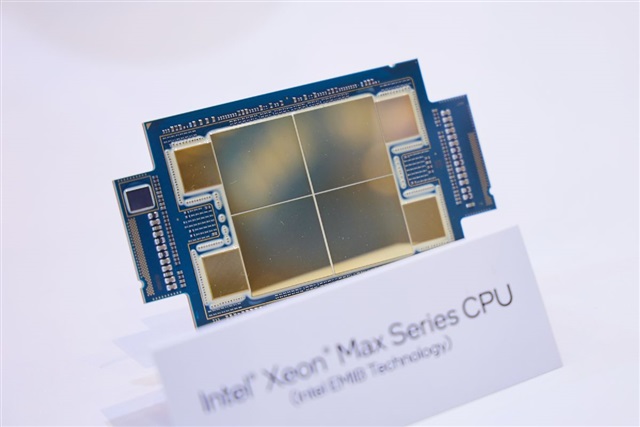

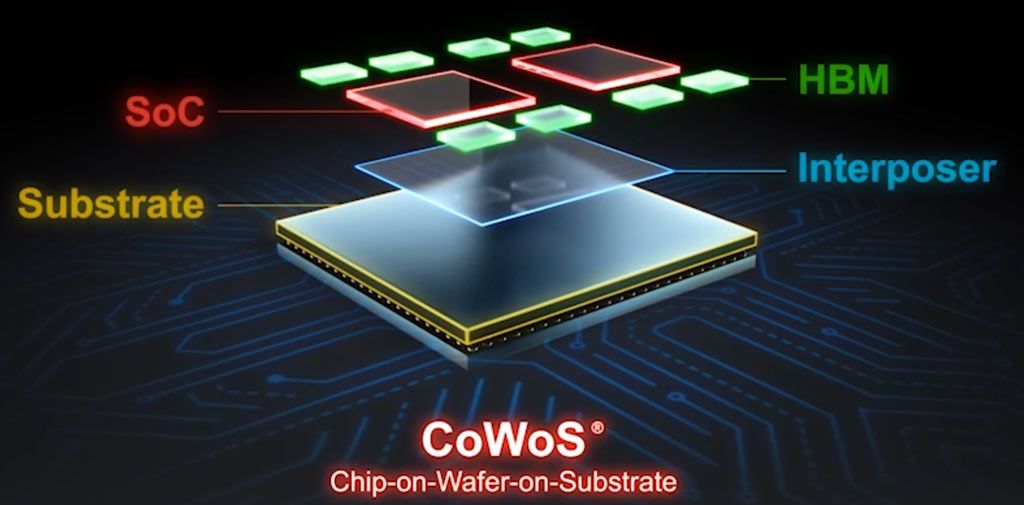

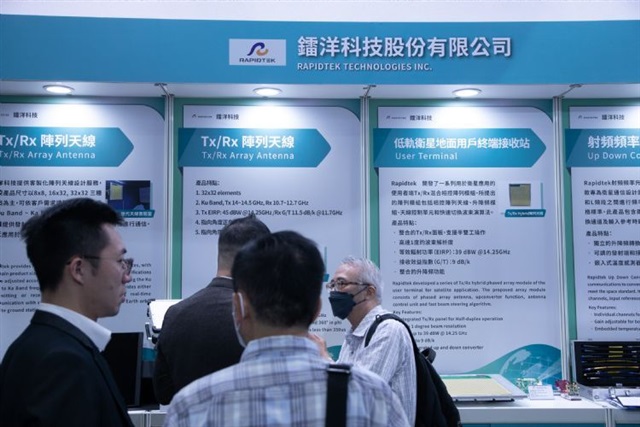

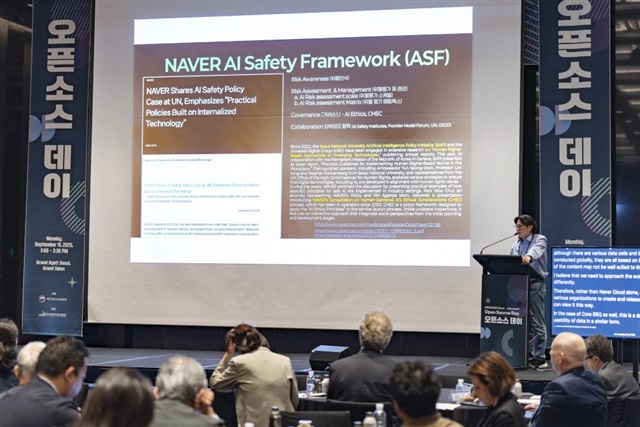

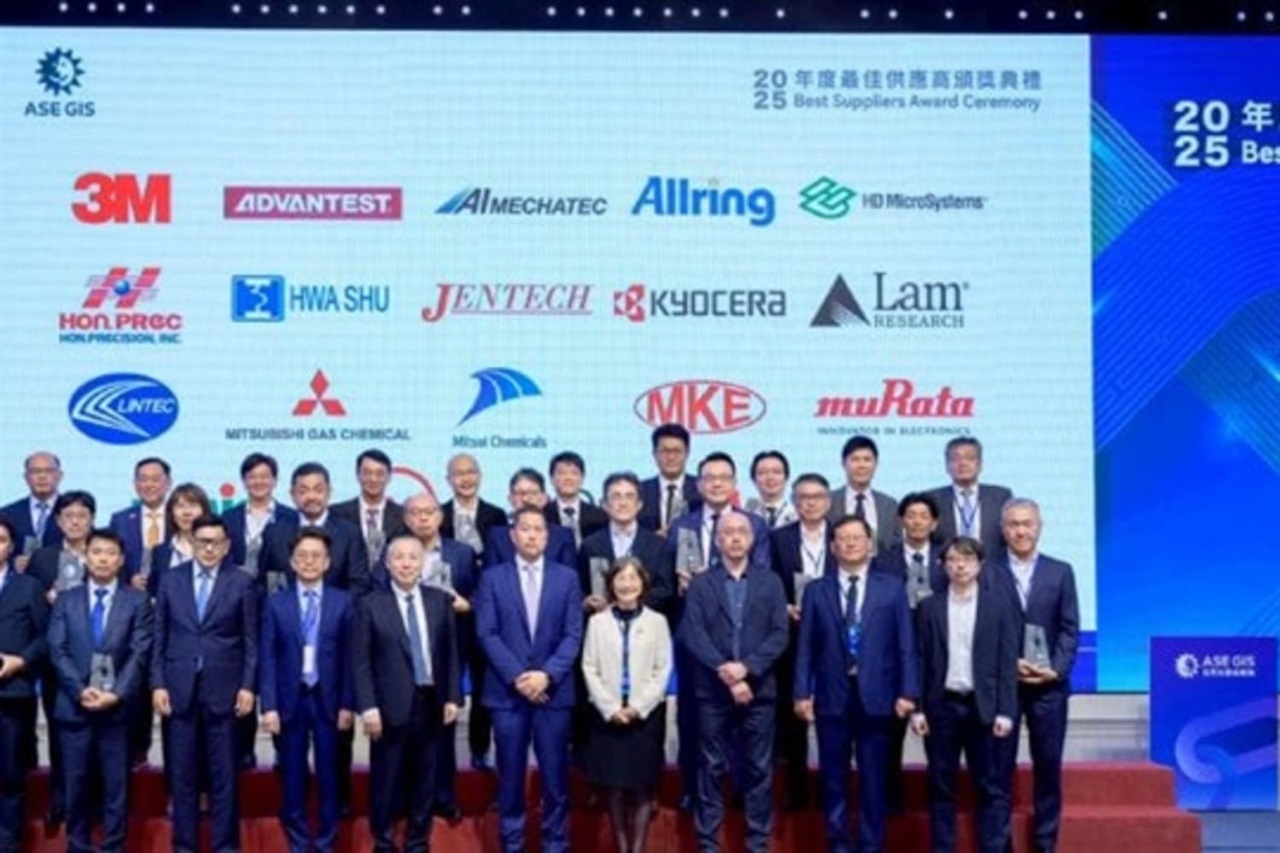

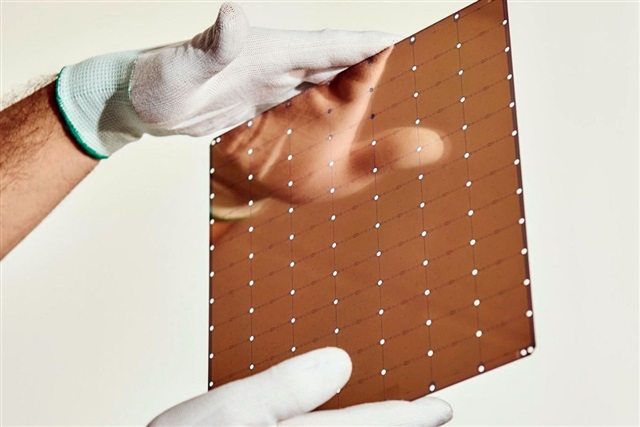

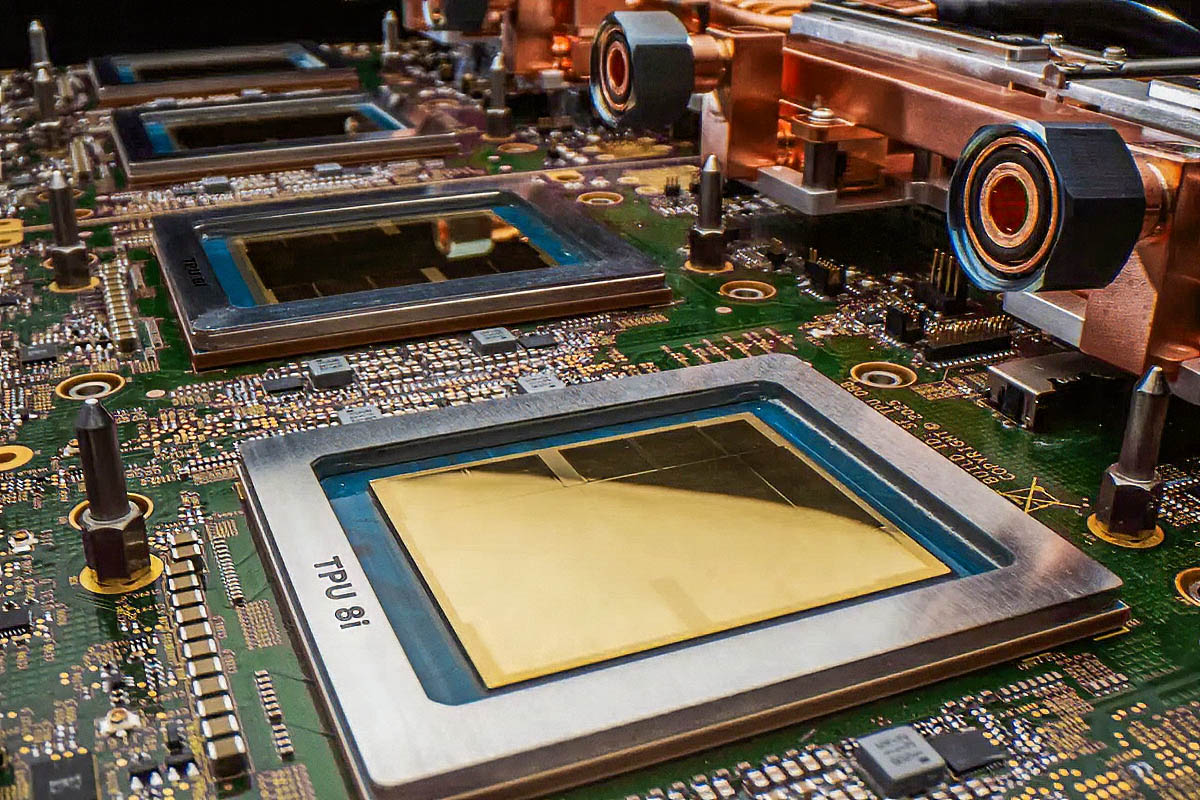

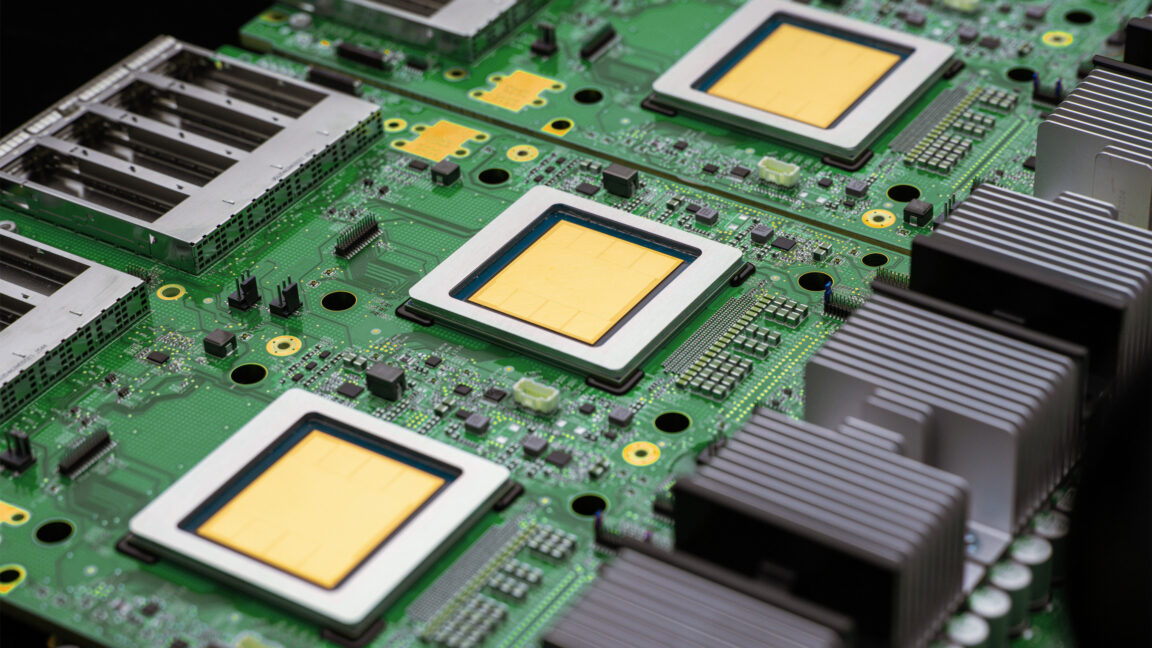

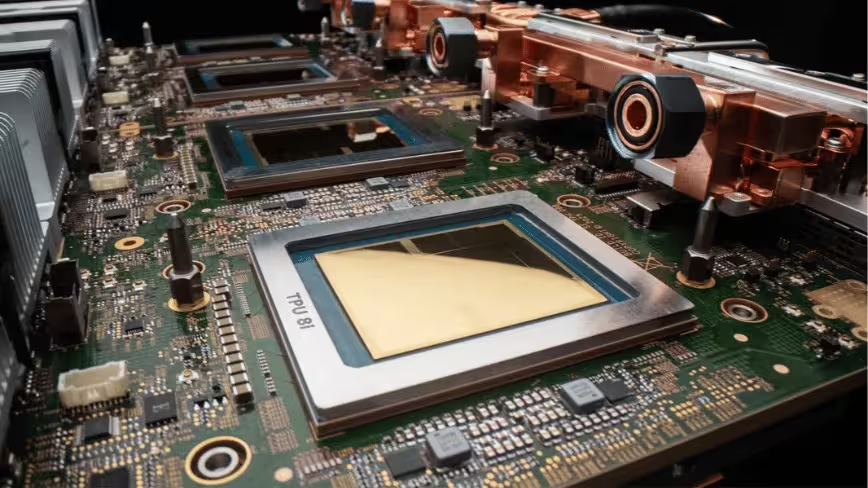

Le esportazioni di Taiwan sono proiettate a superare gli 800 miliardi di dollari entro il 2026, spinte dalla crescente domanda globale di tecnicie legate all'intelligenza artificiale. Il settore dell'elettronica, in particolare, sta vivendo un'impenn...