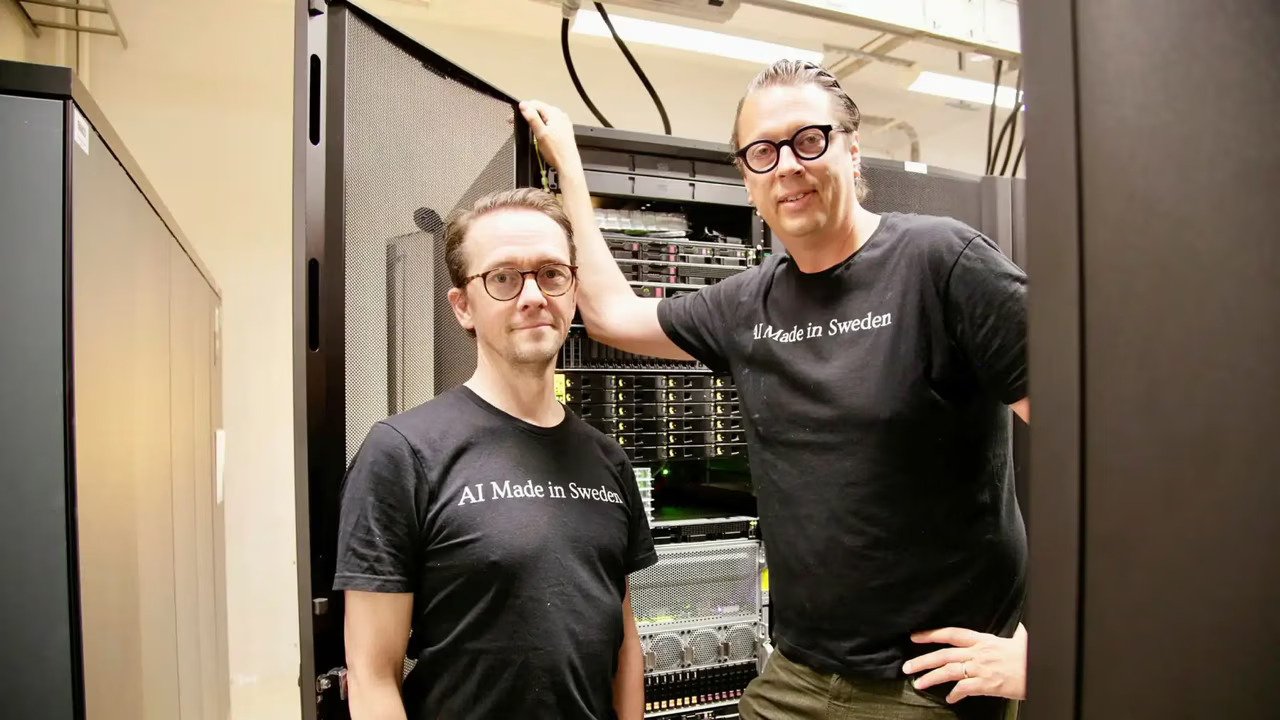

Google: l'AI rivitalizza la ricerca, non la soppianta

Secondo Digitimes, i recenti progressi di Google nell'integrazione dell'intelligenza artificiale nel motore di ricerca dimostrano come l'AI stia potenziando, e non sostituendo, le funzionalità di ricerca esistenti. L'azienda sta ottenendo significati...