Phison aiDAPTIV e Dimensity 9500: spinta all'AI sull'edge

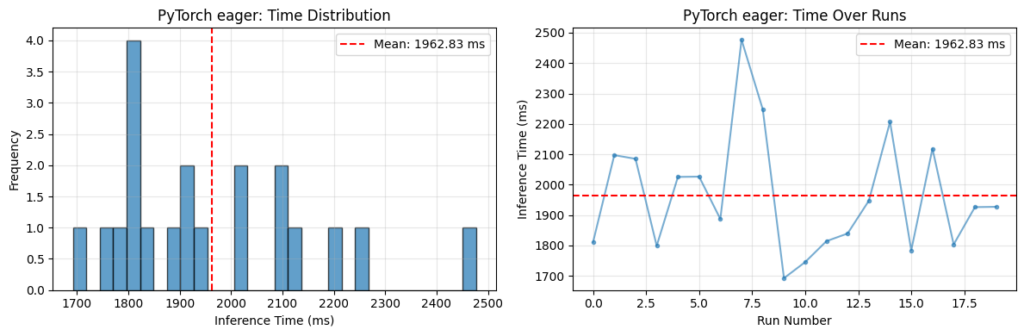

Phison ha presentato aiDAPTIV, una soluzione progettata per accelerare il deployment di carichi di lavoro AI direttamente sull'edge. L'integrazione con il processore Dimensity 9500 di MediaTek evidenzia un focus sull'ottimizzazione delle performance ...