Attacco Glassworm: codice malevolo in 151 repo GitHub e VS Code

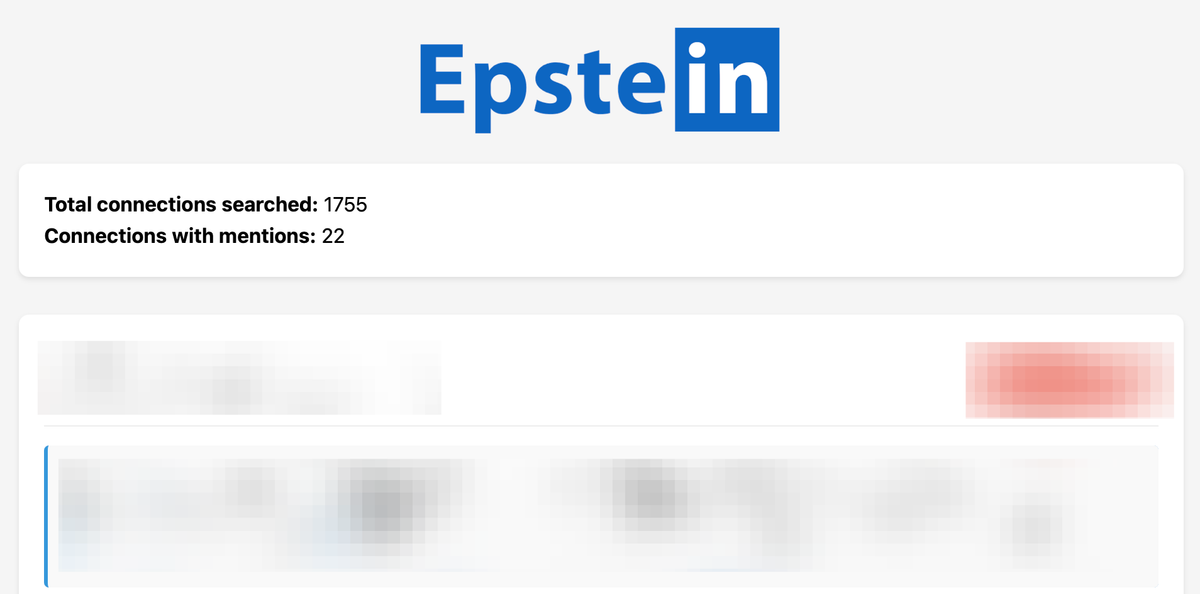

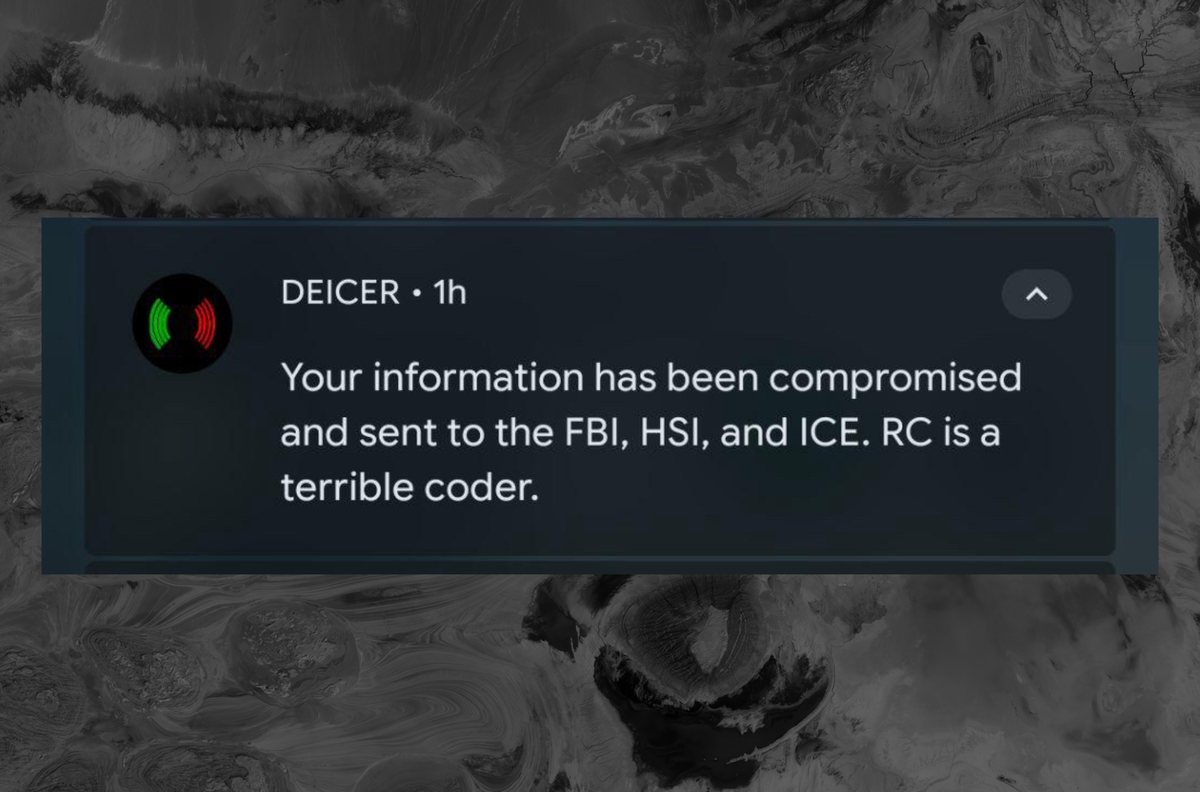

Un attacco denominato Glassworm ha compromesso 151 repository GitHub e istanze di VS Code, sfruttando la blockchain per sottrarre token, credenziali e segreti. La minaccia evidenzia i rischi crescenti per la sicurezza nella supply chain del software ...