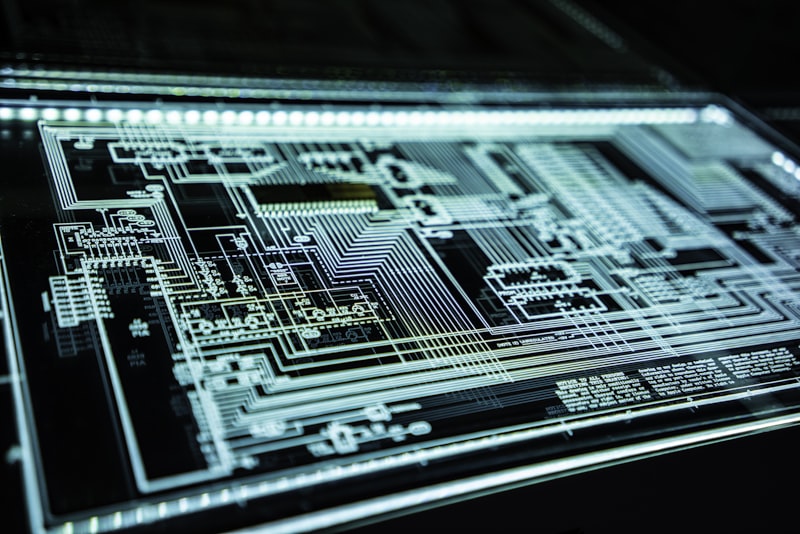

Alibaba Cloud promuove Qwen con pubblicità a Singapore

Alibaba Cloud intensifica la promozione del suo modello linguistico di grandi dimensioni (LLM) Qwen. Avvistata pubblicità all'aeroporto di Changi, Singapore, segnalando un aumento degli investimenti nel marketing del modello.