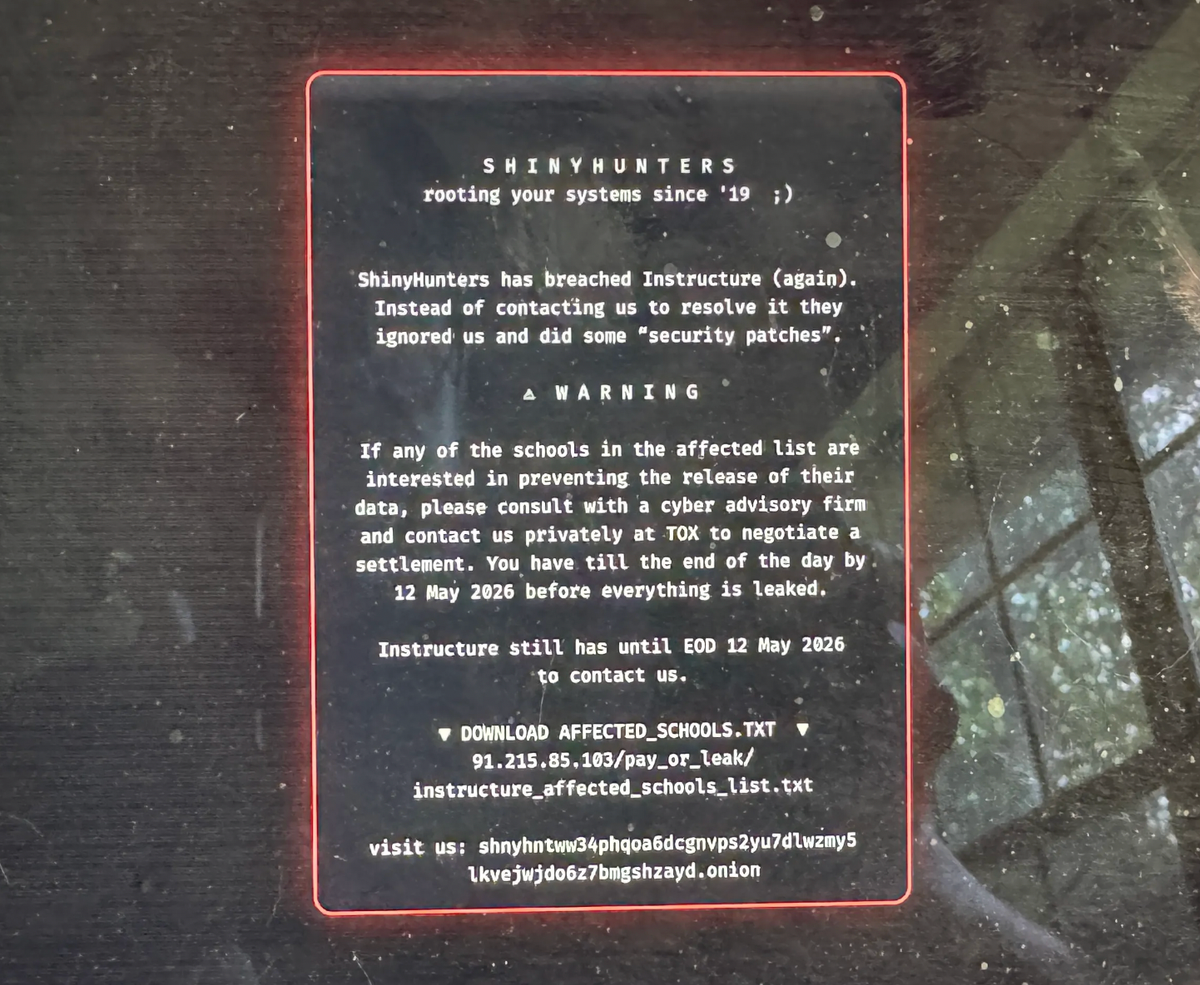

OpenAI: nessun dato utente compromesso nell'attacco alla supply chain npm di TanStack

OpenAI ha dichiarato che nessun dato utente è stato compromesso a seguito di un attacco alla supply chain che ha interessato i pacchetti npm di TanStack. L'incidente ha coinvolto due laptop aziendali e credenziali, ma la pubblicazione dei pacchetti m...