OpenClaw: scoperta vulnerabilità nella catena di consegne di malware

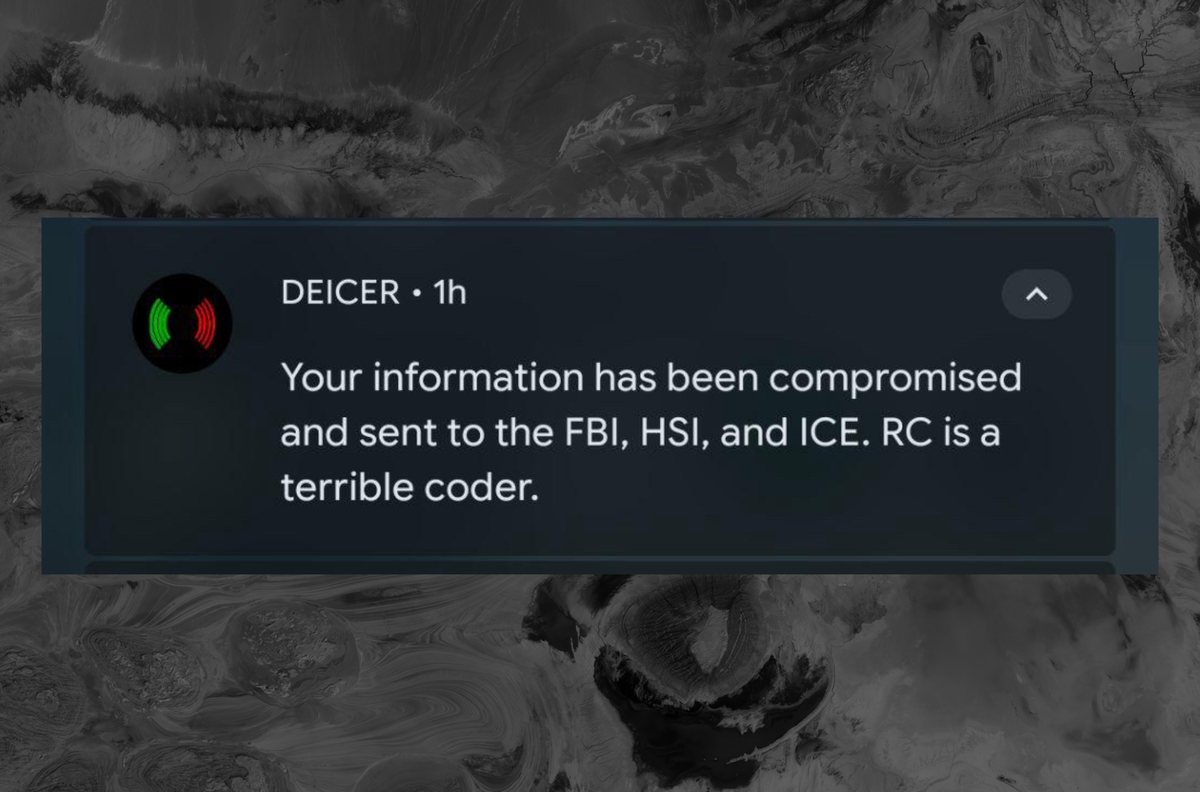

Un ricercatore di 1Password ha scoperto che una skill OpenClaw molto scaricata era in realtà una catena di consegne di malware. La skill, che prometteva l'integrazione con Twitter, guidava gli utenti a eseguire comandi offuscati che installavano malw...