Qwen3.6-27B e Coder-Next: un confronto sul campo per i Large Language Models

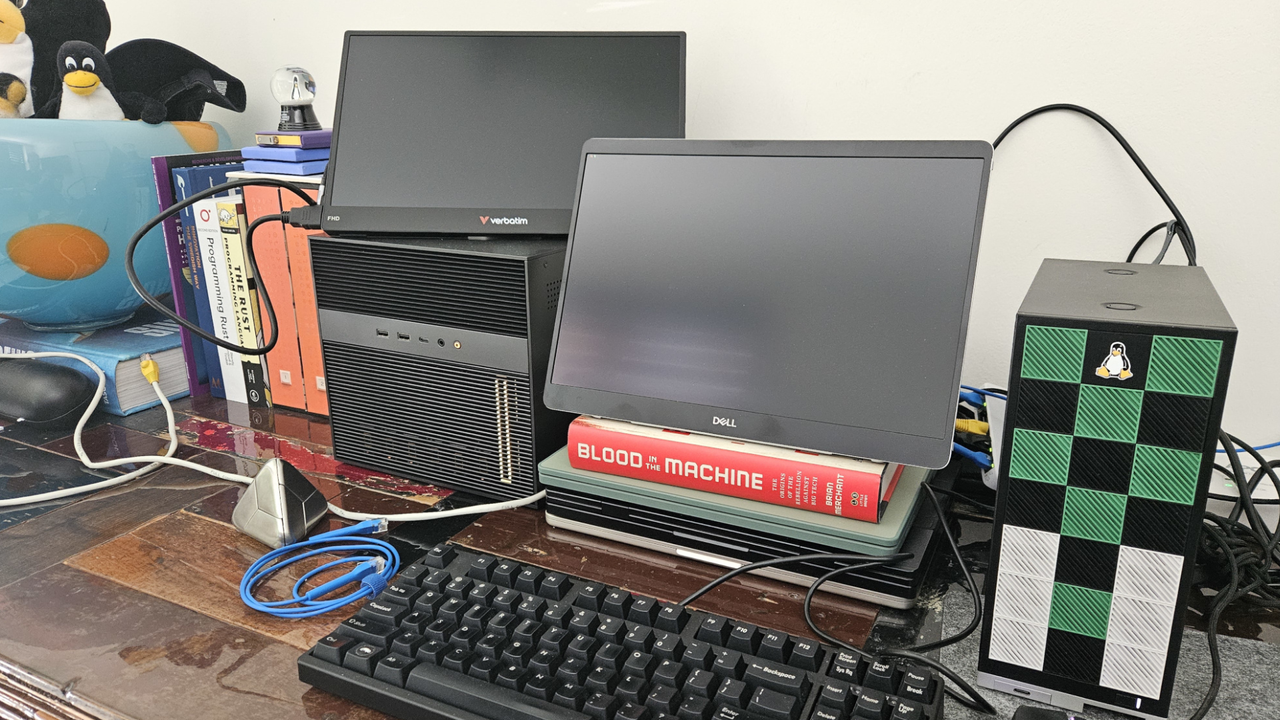

Un'analisi approfondita ha messo a confronto i Large Language Models Qwen3.6-27B e Coder-Next su hardware RTX PRO 6000 Blackwell. I test, condotti con una metodologia non convenzionale, hanno rivelato che la scelta del modello ottimale dipende fortem...