Mercedes-Benz Taiwan adotta la piattaforma Nvidia Alpamayo per la nuova CLA

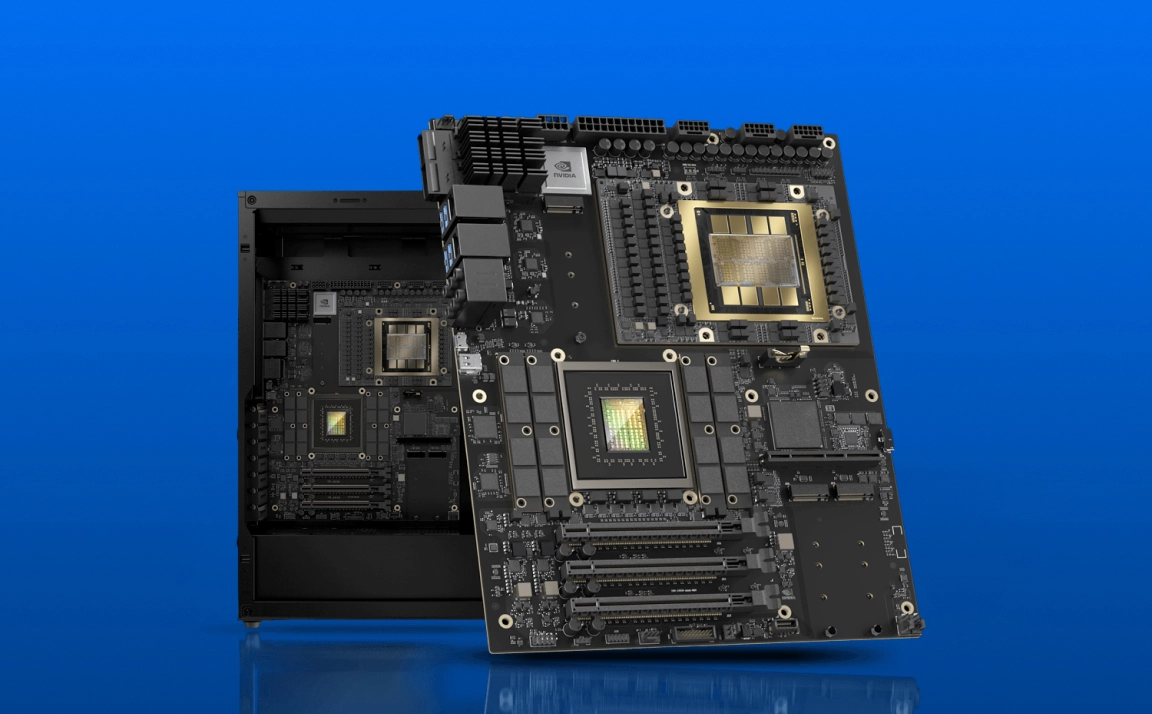

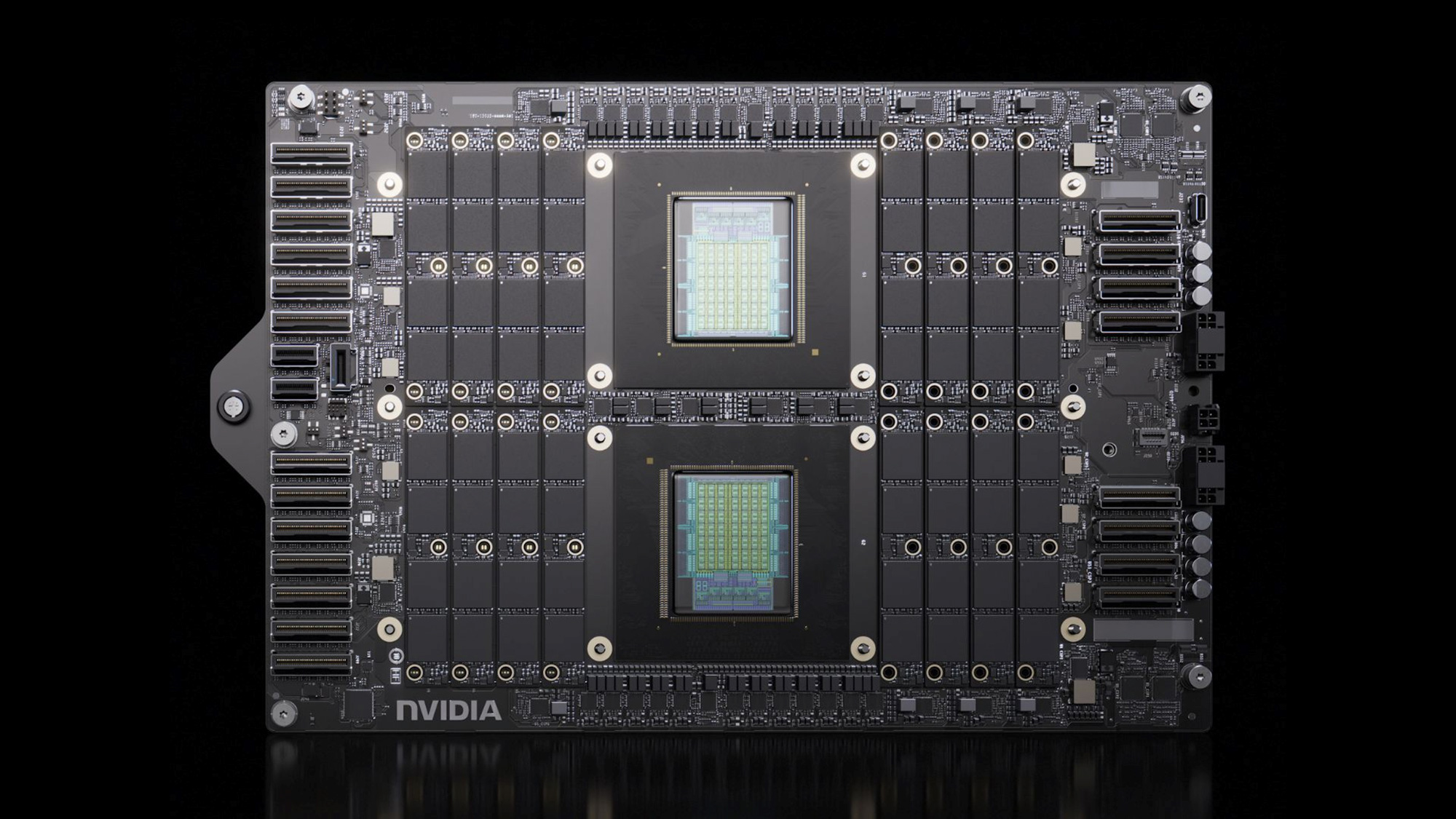

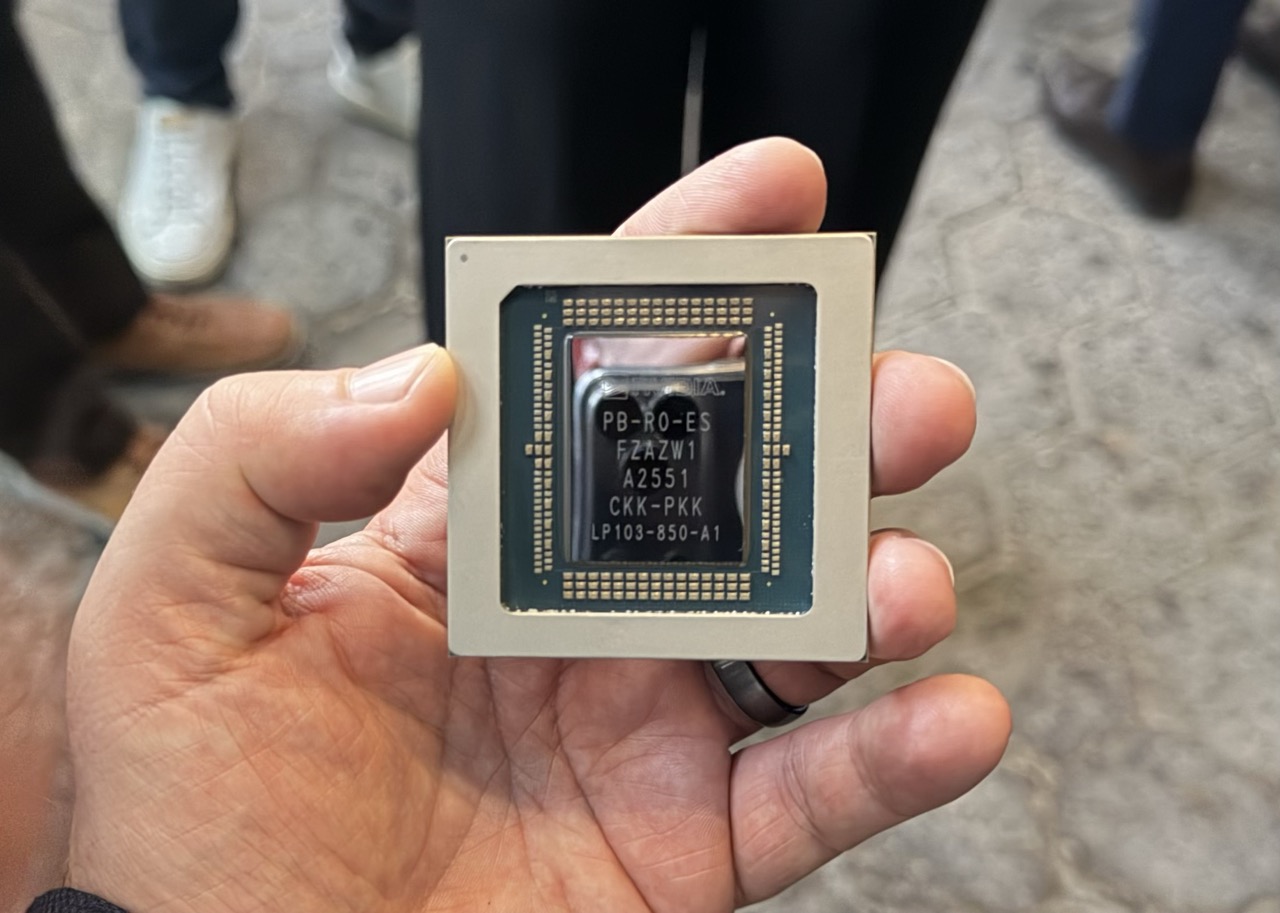

Mercedes-Benz Taiwan ha annunciato l'integrazione della piattaforma Nvidia Alpamayo nella sua nuova CLA. Questa mossa strategica sottolinea l'impegno dell'azienda verso l'innovazione tecnicica nel settore automobilistico e prepara il terreno per una ...